SES School, Studie en Onderwijs

Wiskunde in de brugklas, Frans voor het examen of een studie Personeel en Arbeid? Moeilijke formulieren van DUO? Iets weten over studiefinanciering of studentenverenigingen? Dit is het forum voor leerkrachten, scholieren en studenten, van brugklas tot uni

Aha! Ik snap hetquote:Op maandag 9 juli 2012 23:44 schreef oompaloompa het volgende:

Probleem ontdekt en omdat andere mensen hier misschien ook tegenaan kunnen lopen post ik het hier maar.

Als je een multivariate / manova doet, vallen in principe cases met 1 of meer missing values gewoon af. Omdat je dataset zo veel missings heeft, houdt je uiteindelijk minder dan de helft over. Wat nog cru-er is, is dat van 1 conditie je helemaal niemand meer overhoudt. Daarom kun je geen contrasten meer doen.

Nu zijn er 2 opties:

1 je imputeert de missings.

2 je doet allemaal losse univariates

En die losse univariates had ik al gedaan. Nog één vraagje erover. Maakt dat dan veel uit dat ik nu univariates doe? En moet / kan ik dat dan gewoon verantwoorden in mijn discussie of hoeft dat allemaal niet?

"It's good to be open-minded, but not so open that your brains fall out."

Met allemaal losse toetsen vergroot je de kans op een type 1 fout. En ik zou het inderdaad wel vermelden.quote:Op maandag 9 juli 2012 23:47 schreef automatic_ het volgende:

[..]

Aha! Ik snap het

En die losse univariates had ik al gedaan. Nog één vraagje erover. Maakt dat dan veel uit dat ik nu univariates doe? En moet / kan ik dat dan gewoon verantwoorden in mijn discussie of hoeft dat allemaal niet?

Oh God, dat hebben we ook nog jaquote:Op maandag 9 juli 2012 23:51 schreef Sandertje23 het volgende:

[..]

Met allemaal losse toetsen vergroot je de kans op een type 1 fout. En ik zou het inderdaad wel vermelden.

"It's good to be open-minded, but not so open that your brains fall out."

Ah ok, fijn dat je je tabel toegevoegd hebt.quote:Op maandag 9 juli 2012 23:44 schreef VacaLoca het volgende:

[..]

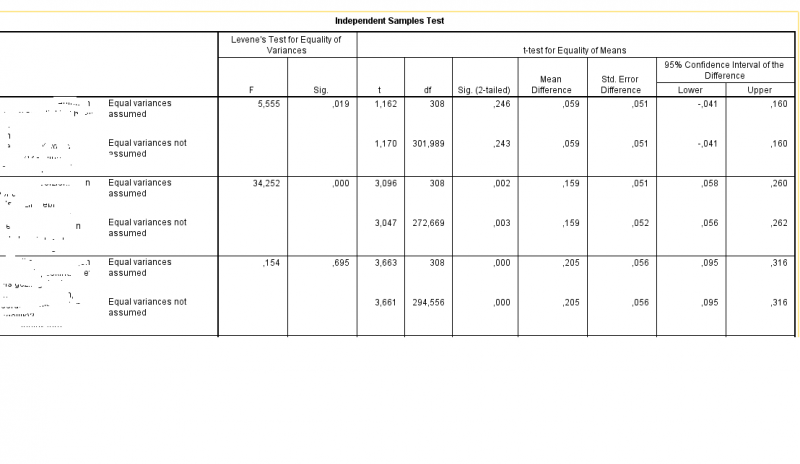

Thanks, stukje 'meand +/- 1.96*sd omvat 0' is helaas nog even onbekende taal voor mij. Ik heb met studie geen statistiek gehad, en probeer nu zelf snel te leren zo goed en zo kwaad als het kan. Heb even uitdraai gemaakt.

[ afbeelding ]

Nu had ik daarover al wel gelezen in SPSS Survival Guide:

While there are tests that you can use to evaluate skewness and kurtosis values, these are too sensitive with large samples. Tabachnick and Fidell (2007, p. 81) recommend inspecting the shape of the distribution (e.g. using a histogram).

Nu zien zij 200+ als een large sample las ik elders in het boek... terwijl ik n=126 heb

Verderop in het boek adviseren ze iig een Normal Q-Q plot als alternatief.

[..]

Maar wanneer zouden mensen ervaren met statistiek het nog 'reasonable' noemen is dan mijn vraag betreffende bv de Q-Q plot die ik liet zien.

Iemand anders een goede website voor basis tot gemiddeld niveau analyses voor surveys? Werken met likert schalen, multiple choise etc. Ik heb alle data-invoer goed zover ik weet, maar niet overzichtelijk wélke analyses het meest relevant zijn voor een dergelijke enquete. Heb helaas zeer beperkt de tijd me goed in te lezen.

Met skewness en kurtosis kun je een beetje fdoen zoals je ook normale andere toetsen doet.

Als ik kijk naar je skewness (even verzonnen, pas zo de nummers aan) dan zie je dat het gemiddelde .500 is (of zo). Dat betekent dat je gemiddelde .5 afligt van de 0 waar het zou moeten zijn als je geen skewness hebt ("scheve normaalverdeling"). Is dat significant anders? Darvoor gebruik je de standaardverdeling van de skewness (laten we zeggen dat die .2 is even) en die doe je keer 1.96. Nu heb je de 95% confidence interval van je 0.5 mean. Als je die erbij optelt & aftrekt heb je dus een confidence interval van 0.1 -- 0.9. Het gemiddelde waar je op hoopt, 0.0, ligt daar niet tussen. Dit betekent dat je significante skewness hebt en je data dus niet normaal verdeeld is.

Hiervoor zijn een aantal oplossingen.

1. negeren en gewoon doorgaan. Je resultaten zijn minder betrouwbaar, maar als je resultaten heel erg sterk zijn maakt dat niet heel erg veel uit.

2. Je data hercoderen waardoor ze normaal verdeeld raken. Bijvoorbeeld door een log0transformatie of er de wortel van te nemen.

3. Een nonparametrische toets er op toepassen. Deze zijn wat conservatiever maar hebben, bij data die in de buurt van een normaalverdeling liggen minder power.

Als handige guide kan ik Pallant aanraden.

Ja gewoon in je discussie zeggen; vanwege missing values niet mogelijk multivariate te doen dus daarom 4 univariates. Zolang je eerlijk rapporteert is er geen probleem. Als je hypothese per los construct had is er ook geen type-1 probleem, als je alleen overall effect voorspeld had en op ene wel vindt en op andere niet, heb je wel een probleem qua zowel type 1 als type 2 :pquote:Op maandag 9 juli 2012 23:47 schreef automatic_ het volgende:

[..]

Aha! Ik snap het

En die losse univariates had ik al gedaan. Nog één vraagje erover. Maakt dat dan veel uit dat ik nu univariates doe? En moet / kan ik dat dan gewoon verantwoorden in mijn discussie of hoeft dat allemaal niet?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Thank you very muchquote:Op maandag 9 juli 2012 23:53 schreef oompaloompa het volgende:

[..]

Ah ok, fijn dat je je tabel toegevoegd hebt.

Met skewness en kurtosis kun je een beetje fdoen zoals je ook normale andere toetsen doet.

Als ik kijk naar je skewness (even verzonnen, pas zo de nummers aan) dan zie je dat het gemiddelde .500 is (of zo). Dat betekent dat je gemiddelde .5 afligt van de 0 waar het zou moeten zijn als je geen skewness hebt ("scheve normaalverdeling"). Is dat significant anders? Darvoor gebruik je de standaardverdeling van de skewness (laten we zeggen dat die .2 is even) en die doe je keer 1.96. Nu heb je de 95% confidence interval van je 0.5 mean. Als je die erbij optelt & aftrekt heb je dus een confidence interval van 0.1 -- 0.9. Het gemiddelde waar je op hoopt, 0.0, ligt daar niet tussen. Dit betekent dat je significante skewness hebt en je data dus niet normaal verdeeld is.

Hiervoor zijn een aantal oplossingen.

1. negeren en gewoon doorgaan. Je resultaten zijn minder betrouwbaar, maar als je resultaten heel erg sterk zijn maakt dat niet heel erg veel uit.

2. Je data hercoderen waardoor ze normaal verdeeld raken. Bijvoorbeeld door een log0transformatie of er de wortel van te nemen.

3. Een nonparametrische toets er op toepassen. Deze zijn wat conservatiever maar hebben, bij data die in de buurt van een normaalverdeling liggen minder power.

Als handige guide kan ik Pallant aanraden.

[..]

Ja gewoon in je discussie zeggen; vanwege missing values niet mogelijk multivariate te doen dus daarom 4 univariates. Zolang je eerlijk rapporteert is er geen probleem. Als je hypothese per los construct had is er ook geen type-1 probleem, als je alleen overall effect voorspeld had en op ene wel vindt en op andere niet, heb je wel een probleem qua zowel type 1 als type 2 :p

Nog één vraag voor ik weer zelf de boeken in zal duiken: wat doen jullie met enquetes met antwoorden ahv een likert schaal. Behandelen jullie het als numerieke data (1 t/m 5) met Scale dus als measurement type, en daar de passende analyses op loslaten. Of als categorische data met Ordinal als measurement type?

(bonusvraag: als je 5-schalige likert hebt maar tevens een 'geen mening/niet van toepassing' optie, kan je het dan nog wel als ordinal behandelen? Want de optie geen mening/nvt ligt dan niet in lijn met de likert data.

Yeap, als je helemaal een goede indruk wilt maken, interpreteer je nog even op welke wijze dat minder nauwkeurig is. Kan ik je wel mee helpen. In principe komt het er op neer dat je de spreiding aan de ene kant overschat en aan de andere kant onderschat. Afhankelijk van de vergelijking is je toets dus óf te strikt (= goed voor je, zelfs met een te strenge test nog verschil) of een tikkie te zwak (dan moet je uitleggen dat je significantiewaarde waarschijnlijk iets hoger is dan wat spss rapporteert)quote:Op dinsdag 10 juli 2012 00:04 schreef VacaLoca het volgende:

[..]

Thank you very muchHet is voor HBO, dus ze zijn wat makkelijker impressed denk ik; dus met dat in achterhoofd zou ik denk ik goed voor optie 1 kunnen gaan en kort uitleggen dat de betrouwbaarheid iets lager ligt omdat de normality niet helemaal voldoet aan de eisen, toch?

Nog één vraag voor ik weer zelf de boeken in zal duiken: wat doen jullie met enquetes met antwoorden ahv een likert schaal. Behandelen jullie het als numerieke data (1 t/m 5) met Scale dus als measurement type, en daar de passende analyses op loslaten. Of als categorische data met Ordinal als measurement type?

(bonusvraag: als je 5-schalige likert hebt maar tevens een 'geen mening/niet van toepassing' optie, kan je het dan nog wel als ordinal behandelen? Want de optie geen mening/nvt ligt dan niet in lijn met de likert data.

Likertschaal is officieel ordinaal maar kun je als scale benaderen (zijn wat simulatiepapers over)

bonusvraag: nee

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Officieel ordinaal... gezien HBO verhaal ms daar maar aan houden dan? Daar is dan ook de meeste theorie voor beschikbaar voor analyses van gemiddeld niveau dunkt me?

Moet ik die vragen met likertschaal en de geen mening/nvt recoden zodat alleen likert overblijft? De geen mening/nvt bijvoorbeeld een 'Missing' value geven?

Dit even aannemende dat als men likertschaal vragen in zn enquete heeft, je de beste analyses kan doen met Ordinal en niet met Nominal.

Moet ik die vragen met likertschaal en de geen mening/nvt recoden zodat alleen likert overblijft? De geen mening/nvt bijvoorbeeld een 'Missing' value geven?

Dit even aannemende dat als men likertschaal vragen in zn enquete heeft, je de beste analyses kan doen met Ordinal en niet met Nominal.

Ik zou het gewoon als scale doen, doet iedereen. dan voor bonuspunten nog even slim doen en zeggen "is officieel ordinaal, maar (bron) heeft aangetoond dat ook dan scale toegepast kan worden.

bron kan b.v.http://xa.yimg.com/kq/gro(...)9%25E2%2580%2599.pdf zijn. (dubbelcheck het even, heb alleen net ter plekke abstract bekeken)

bron kan b.v.http://xa.yimg.com/kq/gro(...)9%25E2%2580%2599.pdf zijn. (dubbelcheck het even, heb alleen net ter plekke abstract bekeken)

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Graciasquote:Op dinsdag 10 juli 2012 00:29 schreef oompaloompa het volgende:

Ik zou het gewoon als scale doen, doet iedereen. dan voor bonuspunten nog even slim doen en zeggen "is officieel ordinaal, maar (bron) heeft aangetoond dat ook dan scale toegepast kan worden.

bron kan b.v.http://xa.yimg.com/kq/gro(...)9%25E2%2580%2599.pdf zijn. (dubbelcheck het even, heb alleen net ter plekke abstract bekeken)

(de geen mening/nvt nog wel even recoden naar Missing dus? of is daar betere oplossing voor?)

ja gewoon als missing. Als je meerdere condities gebruikt kun je nog even voor de zekerheid een losse variabele aanmaken (bv 1= wel ingevuld, 2= niet ingevuld) om dan nog even te kijken of mensen in de ene conditie de vraag sig. meer ingevuld hebben dan anderen.

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

nou dat maakt mijn dag ook weer goed

Succes!

Succes!

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Even een vraag over transformaties, ik heb een logtransformatie gedaan voor de afhankelijke variabele. Voor toetsen mag dit allemaal zonder problemen, tegen niet getransformeerde variabelen? Maar geldt dit ook voor een ANOVA?

Je mag alles doen wat je wilt met getransformeerde variabelen zolang je maar vervolgens bij de interpratie rekening houdt met je transformatie.quote:Op dinsdag 10 juli 2012 01:16 schreef Brembo het volgende:

Even een vraag over transformaties, ik heb een logtransformatie gedaan voor de afhankelijke variabele. Voor toetsen mag dit allemaal zonder problemen, tegen niet getransformeerde variabelen? Maar geldt dit ook voor een ANOVA?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Pfff

Als je een single paired comparison ANOVA moet doen, dan kan dat toch gewoon via general linear model --> univariate en dan optie 'single' bij contrasts? Ik heb data uit 3 surveys die ik moet vergelijken, vandaar. Ik heb alle data in 1 groot bestand, met een nieuwe variabele die bij elke respondent aangeeft uit welke survey hij komt.

Volgens mijn begeleider moet ik met allemaal formules en hercoderingen gaan zitten werken

Als je een single paired comparison ANOVA moet doen, dan kan dat toch gewoon via general linear model --> univariate en dan optie 'single' bij contrasts? Ik heb data uit 3 surveys die ik moet vergelijken, vandaar. Ik heb alle data in 1 groot bestand, met een nieuwe variabele die bij elke respondent aangeeft uit welke survey hij komt.

Volgens mijn begeleider moet ik met allemaal formules en hercoderingen gaan zitten werken

huh? Er van uitgaande dat jij je begeleider goed hebt begrepen heb jij gelijkquote:Op dinsdag 10 juli 2012 14:01 schreef Omnifacer het volgende:

Pfff

Als je een single paired comparison ANOVA moet doen, dan kan dat toch gewoon via general linear model --> univariate en dan optie 'single' bij contrasts? Ik heb data uit 3 surveys die ik moet vergelijken, vandaar. Ik heb alle data in 1 groot bestand, met een nieuwe variabele die bij elke respondent aangeeft uit welke survey hij komt.

Volgens mijn begeleider moet ik met allemaal formules en hercoderingen gaan zitten werken

Then again, in principe kun je verschillende surveys niet zo maar met elkaar vergelijken..

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Thanks voor je antwoord. Dit is de situatie: ik heb drie surveys afgenomen, en wil deze vergelijken op een bepaalde variabele, bijvoorbeeld 'competence'. Wat ik had gedaan: een variabele gemaakt waarin elke respondent getagd wordt uit welke survey hij afkomstig is. Daarmee had ik ANOVA's gemaakt, door gewoon univariate ANOVA te doen. Daar kwam dan een significantie van .182 uit.

Gister zei de begeleider echter: je kunt die drie groepen niet zomaar met elkaar vergelijken vanwege verschil in grootte, je moet een paired comparison ANOVA doen. Nu heb ik me scheel zitten lezen in zo'n kutboek en allemaal zitten kutten met SPSS, maar ik kom niet verder. Dat boek komt met allemaal formules aanzetten (geen idee waar je die zou moeten invoeren), en volgens de tutorials op YouTube kun je gewoon dus doen wat ik omschreef: contrasts --> single selecteren.

Jij ziet er uit als iemand die er meer van weet dan ik: hoe zie jij dat? Als ik het op die laatste manier doe, wordt er dan rekening gehouden met verschil in aantal respondenten?

Als ik het op die laatste manier doe, wordt er dan rekening gehouden met verschil in aantal respondenten?

Gister zei de begeleider echter: je kunt die drie groepen niet zomaar met elkaar vergelijken vanwege verschil in grootte, je moet een paired comparison ANOVA doen. Nu heb ik me scheel zitten lezen in zo'n kutboek en allemaal zitten kutten met SPSS, maar ik kom niet verder. Dat boek komt met allemaal formules aanzetten (geen idee waar je die zou moeten invoeren), en volgens de tutorials op YouTube kun je gewoon dus doen wat ik omschreef: contrasts --> single selecteren.

Jij ziet er uit als iemand die er meer van weet dan ik: hoe zie jij dat?

Heh? Dat klopt gewoon echt niet.quote:Op dinsdag 10 juli 2012 14:20 schreef Omnifacer het volgende:

Thanks voor je antwoord. Dit is de situatie: ik heb drie surveys afgenomen, en wil deze vergelijken op een bepaalde variabele, bijvoorbeeld 'competence'. Wat ik had gedaan: een variabele gemaakt waarin elke respondent getagd wordt uit welke survey hij afkomstig is. Daarmee had ik ANOVA's gemaakt, door gewoon univariate ANOVA te doen. Daar kwam dan een significantie van .182 uit.

Gister zei de begeleider echter: je kunt die drie groepen niet zomaar met elkaar vergelijken vanwege verschil in grootte, je moet een paired comparison ANOVA doen. Nu heb ik me scheel zitten lezen in zo'n kutboek en allemaal zitten kutten met SPSS, maar ik kom niet verder. Dat boek komt met allemaal formules aanzetten (geen idee waar je die zou moeten invoeren), en volgens de tutorials op YouTube kun je gewoon dus doen wat ik omschreef: contrasts --> single selecteren.

Jij ziet er uit als iemand die er meer van weet dan ik: hoe zie jij dat?Als ik het op die laatste manier doe, wordt er dan rekening gehouden met verschil in aantal respondenten?

Als eerste doe je een anova, als daar geen verschil uit blijkt houdt het eigenlijk op.

Je kunt ook nog contrasten tussen de losse groepen doen. je kunt of post-hocs doen (hoef je niks aan te passen) of planned contrasts. Voor planned contrasts is groepsgrootte alleen relevant (volgens mij & collega naast me) als je meerdere groepen samen vergelijkt met andere groepen samen.

Ter illustratie, stel ik heb de volgende groepen

1: n=25

2: n = 50

3: n = 100

4: n = 250

Je kunt gewoon 2 and 3 met elkaar vergelijken.

Wat wel een probleem wordt is als je 1&2 met 3&4 samen zou willen vergelijken, dan moet je binnen die paren rekening houden met groepsgrootte.

wat voor iemand moetik je voorstellen bij je begeleider, wetenschappelijk onderzoeker of eerder mbo-methodologiedocent en zelfgetrained enqueteur?

Ik ben vrij zeker van mijn antwoord, maar het is een beetje afhankelijk van het relatief verschil in expertise op wie je beter af kunt gaan ^^

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Begeleider is een AIO.

In mijn geval heb ik hypothesen die over verschil tussen survey1 en survey 2+3 gaan, en hypothesen die tussen verschil tussen survey 1, 2 en 3 gaan.

Survey 1: n=36

Survey 2: n=40

Survey 3: n=28.

Volgens mijn begeleider kan ik deze dus niet zomaar met elkaar vergelijken omdat n teveel verschilt.

Ik had bij alle hypothesen een ANOVA gedaan en nergens kwam trouwens verschil uit.

Ik snap er zelf dus helemaal geen kut van. Godver wat een gezeik

In mijn geval heb ik hypothesen die over verschil tussen survey1 en survey 2+3 gaan, en hypothesen die tussen verschil tussen survey 1, 2 en 3 gaan.

Survey 1: n=36

Survey 2: n=40

Survey 3: n=28.

Volgens mijn begeleider kan ik deze dus niet zomaar met elkaar vergelijken omdat n teveel verschilt.

Ik had bij alle hypothesen een ANOVA gedaan en nergens kwam trouwens verschil uit.

Ik snap er zelf dus helemaal geen kut van. Godver wat een gezeik

Je begeleider heeft gelijk m.b.t. je eerste toetsquote:Op dinsdag 10 juli 2012 14:41 schreef Omnifacer het volgende:

Begeleider is een AIO.

In mijn geval heb ik hypothesen die over verschil tussen survey1 en survey 2+3 gaan, en hypothesen die tussen verschil tussen survey 1, 2 en 3 gaan.

Survey 1: n=36

Survey 2: n=40

Survey 3: n=28.

Volgens mijn begeleider kan ik deze dus niet zomaar met elkaar vergelijken omdat n teveel verschilt.

Ik had bij alle hypothesen een ANOVA gedaan en nergens kwam trouwens verschil uit.

Ik snap er zelf dus helemaal geen kut van. Godver wat een gezeik

daarvoor moet je groep 1 op -1 zetten

groep 2 op 40/68 en groep 3 op 28/68

Omdat groep 2 en 3 een andere grootte hebben moet je ze anders wegen. Overigens is het een beetje zinloos planned contrasts te doen als je geen plan had en de anova sowieso al niet sig is, maar dat terzijde.

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Tsjah, het slaat ook nergens op. Al die tijd die in die zinloze analyses gaat zitten, terwijl in beginsel al niks significant isquote:Op dinsdag 10 juli 2012 14:47 schreef oompaloompa het volgende:

[..]

Je begeleider heeft gelijk m.b.t. je eerste toets

daarvoor moet je groep 1 op -1 zetten

groep 2 op 40/68 en groep 3 op 28/68

Omdat groep 2 en 3 een andere grootte hebben moet je ze anders wegen. Overigens is het een beetje zinloos planned contrasts te doen als je geen plan had en de anova sowieso al niet sig is, maar dat terzijde.

Ik heb je even PM gestuurd over hoe dat 'op -1 zetten' etc werkt. Hoop dat je er even naar wil kijken. Thanks alvast

Mensen, ben ik weer. Ik ben er bijna helemaal uit, ik moet alleen nog een repeated measure ANOVA doen voor twee variabelen. Laat ik ze even var1 en var2 noemen. Ik wil de score van de respondenten uit survey 1 op deze variabelen vergelijken met de score van de respondenten op survey2+3 samen. Var1 en var2 zijn within-subject variabelen, en survey1 en survey2+3 zijn natuurlijk between-variabelen, dus moet ik van mijn begeleider een repeated measure doen. Zoals ik hier al zei: ik heb een grote dataset met alle respondenten erin, en zelf een soort variabele aangemaakt die aangeeft uit welke survey mensen afkomstig zijn.

De hypothese is dat het verschil tussen survey 1 en 2/3 voor var1 groter is dan voor var2.

Hoe moet ik dit nu doen? Als ik snel een repeated measure ANOVA doe dan komen er allemaal dingen uit waarvan ik niet echt snap wat ze betekenen. Ik kan ook geen onderscheid zien tussen survey 1 en 2/3. Is er iemand die me kan helpen?

De hypothese is dat het verschil tussen survey 1 en 2/3 voor var1 groter is dan voor var2.

Hoe moet ik dit nu doen? Als ik snel een repeated measure ANOVA doe dan komen er allemaal dingen uit waarvan ik niet echt snap wat ze betekenen. Ik kan ook geen onderscheid zien tussen survey 1 en 2/3. Is er iemand die me kan helpen?

Was je hier al uitgekomen of heb je nog steeds hulp nodig?quote:Op dinsdag 10 juli 2012 18:16 schreef Omnifacer het volgende:

Mensen, ben ik weer. Ik ben er bijna helemaal uit, ik moet alleen nog een repeated measure ANOVA doen voor twee variabelen. Laat ik ze even var1 en var2 noemen. Ik wil de score van de respondenten uit survey 1 op deze variabelen vergelijken met de score van de respondenten op survey2+3 samen. Var1 en var2 zijn within-subject variabelen, en survey1 en survey2+3 zijn natuurlijk between-variabelen, dus moet ik van mijn begeleider een repeated measure doen. Zoals ik hier al zei: ik heb een grote dataset met alle respondenten erin, en zelf een soort variabele aangemaakt die aangeeft uit welke survey mensen afkomstig zijn.

De hypothese is dat het verschil tussen survey 1 en 2/3 voor var1 groter is dan voor var2.

Hoe moet ik dit nu doen? Als ik snel een repeated measure ANOVA doe dan komen er allemaal dingen uit waarvan ik niet echt snap wat ze betekenen. Ik kan ook geen onderscheid zien tussen survey 1 en 2/3. Is er iemand die me kan helpen?

Zo ja, kun je even een screenshot maken van wat je in het eerste en wteede scherm van repeated in hebt gevuld?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Ik denk dat ik eruit ben, ik zal morgen even laten weten wat de begeleider ervan zei... Misschien moet ik het wel opnieuw doen (weet niet zeker of ik het goed heb gedaan), als dat zo is dan geef ik weer even een sein.

Bedankt!

Bedankt!

Ik heb ook even een vraag over een onderzoek van mij. Ik heb van mijn afhankelijke variabele data verzameld over 10 jaar verspreid. Vervolgens een een regressieanalyse met 7 onafhankelijke variabelen. Uitkomsten hiervan waren prachtig ook al omdat ik wist dat die zaken een sterk effect zouden hebben op mijn afhankelijke variabele. Nu wilt mijn begeleider alleen dat ik ook jaar-dummies gebruik. Als ik dit echter doe is het effect van een jaar enorm op mijn afhankelijke variabele en de effecten van al mijn eerste onafhankelijke variabelen zijn nu nihil.

Hoe moet ik dit precies interpreteren en is het gewoon invoegen van year-dummies de beste manier om te controleren op jaarinvloeden op data?

Hoe moet ik dit precies interpreteren en is het gewoon invoegen van year-dummies de beste manier om te controleren op jaarinvloeden op data?

Nice, hoop dat het allemaal goedgekeurd wordtquote:Op woensdag 11 juli 2012 22:47 schreef Omnifacer het volgende:

Ik denk dat ik eruit ben, ik zal morgen even laten weten wat de begeleider ervan zei... Misschien moet ik het wel opnieuw doen (weet niet zeker of ik het goed heb gedaan), als dat zo is dan geef ik weer even een sein.

Bedankt!

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Interpretatie; verschillen op dv worden verklaard door jaar-verschillen.quote:Op donderdag 12 juli 2012 09:45 schreef VreemdeEend het volgende:

Ik heb ook even een vraag over een onderzoek van mij. Ik heb van mijn afhankelijke variabele data verzameld over 10 jaar verspreid. Vervolgens een een regressieanalyse met 7 onafhankelijke variabelen. Uitkomsten hiervan waren prachtig ook al omdat ik wist dat die zaken een sterk effect zouden hebben op mijn afhankelijke variabele. Nu wilt mijn begeleider alleen dat ik ook jaar-dummies gebruik. Als ik dit echter doe is het effect van een jaar enorm op mijn afhankelijke variabele en de effecten van al mijn eerste onafhankelijke variabelen zijn nu nihil.

Hoe moet ik dit precies interpreteren en is het gewoon invoegen van year-dummies de beste manier om te controleren op jaarinvloeden op data?

Dummies is waarschijnlijk niet het beste, het geeft je erg veel degrees of freedom. Is er een reden warom je jaar niet als continue kunt zien? En heb je niet per proefpersoon een meting per jaar?

Overigens is 17 IV's echt enorm veel, hoe groot is je dataset?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Ik probeer het aantal fusie's en overnames in Europa over 11 jaar gezien (per maand bekeken) te verklaren door 7 economische indicatoren. Ik heb dus voor 132 maanden het aantal fusies en overnames en daarbij dan die waarden van de indicatoren voor de betreffende periode. Ik begrijp dat 17 IV's echt heel veel is, maar mijn begeleider blijft maar doorzeuren over het controleren op jaarinvloeden. Is er dan nog een andere manier waarop ik iets kan doen met de invloed van het jaar zelf zonder dummies te gebruiken?quote:Op donderdag 12 juli 2012 09:53 schreef oompaloompa het volgende:

[..]

Interpretatie; verschillen op dv worden verklaard door jaar-verschillen.

Dummies is waarschijnlijk niet het beste, het geeft je erg veel degrees of freedom. Is er een reden warom je jaar niet als continue kunt zien? En heb je niet per proefpersoon een meting per jaar?

Overigens is 17 IV's echt enorm veel, hoe groot is je dataset?

Dit is echt totaal niet wat ik normaal doe, dus ik kan het moeilijk beantwoorden. Aangenomen dat jaar geen linear verband heeft kun je het niet als losse variabele meenemen, maar dummies lijkt me ook echt een waardeloze oplossing, moet ik even over nadenken. (ik doe voornamelijk experimenteel onderzoek dus ben minder thuis in correlationeel onderzoek en modelleren, alhoewel ik wel wat relevante statistiek vakken er over heb gehad, maar dat is ondertussen een beetje weggezaktquote:Op donderdag 12 juli 2012 10:13 schreef VreemdeEend het volgende:

[..]

Ik probeer het aantal fusie's en overnames in Europa over 11 jaar gezien (per maand bekeken) te verklaren door 7 economische indicatoren. Ik heb dus voor 132 maanden het aantal fusies en overnames en daarbij dan die waarden van de indicatoren voor de betreffende periode. Ik begrijp dat 17 IV's echt heel veel is, maar mijn begeleider blijft maar doorzeuren over het controleren op jaarinvloeden. Is er dan nog een andere manier waarop ik iets kan doen met de invloed van het jaar zelf zonder dummies te gebruiken?

Dan een andere vraag, het lijkt me logisch dat jaar samenhant met veel van die economische indicatoren, ik weet niet welke indicatoren je gebruikt maar als er een effect van jaar is, zou ik juist verwachten dat dat via die economische factoren gaat (2001 was een slecht jaar economische gezien, daardoor waren er meer overnames). Als dat zo is, en je controleert voor jaar, controleer je onbedoeld ook juist voor de dingen waarin je geinteresseerd bent, lijkt me ook niet de bedoeling..

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Hoe kan je Multiple Response Sets gebruiken voor analyses anders dan de 2 bij Analyze > Multiple Response?

En ik heb dichotomous gedaan, dus 1tjes en nulletjes. Maar heb ook cases erbij die de hele vraag niet beantwoord hebben, daar heb ik nu allemaal 0 staan. Maakt dat nog wat uit voor de analyses? Moet ik die vervangen met bv 99 - missing value? Of kijkt SPSS sowieso alleen naar de 1tjes en maakt het niet uit?

En ik heb dichotomous gedaan, dus 1tjes en nulletjes. Maar heb ook cases erbij die de hele vraag niet beantwoord hebben, daar heb ik nu allemaal 0 staan. Maakt dat nog wat uit voor de analyses? Moet ik die vervangen met bv 99 - missing value? Of kijkt SPSS sowieso alleen naar de 1tjes en maakt het niet uit?

Lijkt niet uit te maken, wat betreft die missing values...

Nog een vraag over MPR:

Als je bijvoorbeeld de vraag hebt 'In welk(e) land(en) bent u op vakantie geweest in 2011?' en men kan meerdere antwoorden aanvinken.

En frequentietabel van de MPR geeft bijvoorbeeld aan dat 60% van de cases in Spanje is geweest en 40% van de cases in Italië....

.. is het dan vervolgens ook mogelijk om te kijken hoeveel cases er zowel in Spanje als Italië zijn geweest in 2011?

En zoja kan je die dan vervolgens in een variabele stoppen zodat je analyses kan doen over het segment dat in beide landen is geweest?

BVD!

Nog een vraag over MPR:

Als je bijvoorbeeld de vraag hebt 'In welk(e) land(en) bent u op vakantie geweest in 2011?' en men kan meerdere antwoorden aanvinken.

En frequentietabel van de MPR geeft bijvoorbeeld aan dat 60% van de cases in Spanje is geweest en 40% van de cases in Italië....

.. is het dan vervolgens ook mogelijk om te kijken hoeveel cases er zowel in Spanje als Italië zijn geweest in 2011?

En zoja kan je die dan vervolgens in een variabele stoppen zodat je analyses kan doen over het segment dat in beide landen is geweest?

BVD!

Select cases klikken en dan select cases if... Daar kun je aangeven dat alleen cases meedoen die in een bepaald land zijn geweest. Ook kun je met het AND commando alleen de cases selecteren die in beide landen zijn geweest. Bijvoorbeeld: if Spanje = 1 AND Italië = 1. Ik ga er even vanuit dat zo je variabelen heten en dat 1 staat voor "er op vakantie geweest". Dan selecteer je dus alleen cases die in beide landen zijn geweest.quote:Op zaterdag 14 juli 2012 21:05 schreef VacaLoca het volgende:

Lijkt niet uit te maken, wat betreft die missing values...

Nog een vraag over MPR:

Als je bijvoorbeeld de vraag hebt 'In welk(e) land(en) bent u op vakantie geweest in 2011?' en men kan meerdere antwoorden aanvinken.

En frequentietabel van de MPR geeft bijvoorbeeld aan dat 60% van de cases in Spanje is geweest en 40% van de cases in Italië....

.. is het dan vervolgens ook mogelijk om te kijken hoeveel cases er zowel in Spanje als Italië zijn geweest in 2011?

En zoja kan je die dan vervolgens in een variabele stoppen zodat je analyses kan doen over het segment dat in beide landen is geweest?

BVD!

Succes!

Ook ik heb wat SPSS hulp nodig. Voor mijn scriptie onderzoek voer ik regressies uit in SPSS.

De onafhankelijke variabelen in het model heb ik ingedeeld in vier groepen (fysieke, sociale, locatie en prijs variabelen). Om uiteindelijk statistisch het sterkste model te vinden gebruik ik de zgn. 'enter methode' voor het toevoegen van de variabelen (groepen) aan het model. Het komt er op neer dat ik uiteindelijk vier regressie modellen heb. Het eerste model heeft slechts 1 groep onafhankelijke variabelen in het model, terwijl het vierde model alle vier de groepen in het model meeneemt.

Dit vierde model is dan ook het sterkste. Althans dat heeft de hoogste verklarende waarde (R-square).

Dit is ook uit te lezen in de 'model summary' die hier beneden is afgebeeld. Wat ik graag wil weten is wat de individuele verklarende waarde is per groep in het laatste model. Dus wat is de statistisch verklarende waarde van groep 1, 2, 3 en 4 in model 4. Dus welk percentage van 73,8% (R-square) verklaart elke groep individueel. De model summary geeft deze statistiek alleen cumulatief. Is er in SPSS een manier om dit te vinden? Zo ja, hoe?

De onafhankelijke variabelen in het model heb ik ingedeeld in vier groepen (fysieke, sociale, locatie en prijs variabelen). Om uiteindelijk statistisch het sterkste model te vinden gebruik ik de zgn. 'enter methode' voor het toevoegen van de variabelen (groepen) aan het model. Het komt er op neer dat ik uiteindelijk vier regressie modellen heb. Het eerste model heeft slechts 1 groep onafhankelijke variabelen in het model, terwijl het vierde model alle vier de groepen in het model meeneemt.

Dit vierde model is dan ook het sterkste. Althans dat heeft de hoogste verklarende waarde (R-square).

Dit is ook uit te lezen in de 'model summary' die hier beneden is afgebeeld. Wat ik graag wil weten is wat de individuele verklarende waarde is per groep in het laatste model. Dus wat is de statistisch verklarende waarde van groep 1, 2, 3 en 4 in model 4. Dus welk percentage van 73,8% (R-square) verklaart elke groep individueel. De model summary geeft deze statistiek alleen cumulatief. Is er in SPSS een manier om dit te vinden? Zo ja, hoe?

Als het goed is heb je in de output nog een tabel staan met de regressiecoefficienten (betas en B waarden) per predictor.quote:Op donderdag 19 juli 2012 09:21 schreef bart1074 het volgende:

Ook ik heb wat SPSS hulp nodig. Voor mijn scriptie onderzoek voer ik regressies uit in SPSS.

De onafhankelijke variabelen in het model heb ik ingedeeld in vier groepen (fysieke, sociale, locatie en prijs variabelen). Om uiteindelijk statistisch het sterkste model te vinden gebruik ik de zgn. 'enter methode' voor het toevoegen van de variabelen (groepen) aan het model. Het komt er op neer dat ik uiteindelijk vier regressie modellen heb. Het eerste model heeft slechts 1 groep onafhankelijke variabelen in het model, terwijl het vierde model alle vier de groepen in het model meeneemt.

Dit vierde model is dan ook het sterkste. Althans dat heeft de hoogste verklarende waarde (R-square).

Dit is ook uit te lezen in de 'model summary' die hier beneden is afgebeeld. Wat ik graag wil weten is wat de individuele verklarende waarde is per groep in het laatste model. Dus wat is de statistisch verklarende waarde van groep 1, 2, 3 en 4 in model 4. Dus welk percentage van 73,8% (R-square) verklaart elke groep individueel. De model summary geeft deze statistiek alleen cumulatief. Is er in SPSS een manier om dit te vinden? Zo ja, hoe?

[ afbeelding ]

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Ja dat klopt en zelfs nog een hele hoop andere output. Maar het is mij niet duidelijk hoe ik die kan gebruiken om hetgeen te vinden waarnaar ik op zoek ben. De verklarende waarde per groep variabelen dus. Kan jij me dat uitleggen?quote:Op donderdag 19 juli 2012 09:25 schreef oompaloompa het volgende:

[..]

Als het goed is heb je in de output nog een tabel staan met de regressiecoefficienten (betas en B waarden) per predictor.

Dank

Kun je even de tabel copy pasten van model 4 met de regressiecoefficienten?quote:Op donderdag 19 juli 2012 09:36 schreef bart1074 het volgende:

[..]

Ja dat klopt en zelfs nog een hele hoop andere output. Maar het is mij niet duidelijk hoe ik die kan gebruiken om hetgeen te vinden waarnaar ik op zoek ben. De verklarende waarde per groep variabelen dus. Kan jij me dat uitleggen?

Dank

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Het percentage dat zo'n extra variabele verklaart is het verschil tussen de R2 met en zonder die variabele(volgens mij, of anders dat getal met een verwaarloosbaar verschil).quote:Op donderdag 19 juli 2012 09:21 schreef bart1074 het volgende:

Ook ik heb wat SPSS hulp nodig. Voor mijn scriptie onderzoek voer ik regressies uit in SPSS.

De onafhankelijke variabelen in het model heb ik ingedeeld in vier groepen (fysieke, sociale, locatie en prijs variabelen). Om uiteindelijk statistisch het sterkste model te vinden gebruik ik de zgn. 'enter methode' voor het toevoegen van de variabelen (groepen) aan het model. Het komt er op neer dat ik uiteindelijk vier regressie modellen heb. Het eerste model heeft slechts 1 groep onafhankelijke variabelen in het model, terwijl het vierde model alle vier de groepen in het model meeneemt.

Dit vierde model is dan ook het sterkste. Althans dat heeft de hoogste verklarende waarde (R-square).

Dit is ook uit te lezen in de 'model summary' die hier beneden is afgebeeld. Wat ik graag wil weten is wat de individuele verklarende waarde is per groep in het laatste model. Dus wat is de statistisch verklarende waarde van groep 1, 2, 3 en 4 in model 4. Dus welk percentage van 73,8% (R-square) verklaart elke groep individueel. De model summary geeft deze statistiek alleen cumulatief. Is er in SPSS een manier om dit te vinden? Zo ja, hoe?

[ afbeelding ]

Het staat trouwens gewoon theoretisch vast dat je met een extra variabele nooit slechter kan verklaren, dus dat zou geen verrassing moeten zijn dat een model met meer variabelen een hogere R2 heeft.

Beneath the gold, bitter steel

Nee dat i niet helemaal waar. Stel dat je twee variabelen hebt, A en B. A en B correleren met elkaar met .5quote:Op donderdag 19 juli 2012 09:49 schreef Fingon het volgende:

[..]

Het percentage dat zo'n extra variabele verklaart is het verschil tussen de R2 met en zonder die variabele(volgens mij, of anders dat getal met een verwaarloosbaar verschil).

Het staat trouwens gewoon theoretisch vast dat je met een extra variabele nooit slechter kan verklaren, dus dat zou geen verrassing moeten zijn dat een model met meer variabelen een hogere R2 heeft.

Als je alleen A in het model toevoegt zal de verklaarde variantie van A overschat worden omdat dat gedeelte dat door B verklaard wordt maar niet in het model meegenomen is, voor die .5 door A vrklaard zal worden.

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Dat is dus niet waar, want het is sterk afhankelijk van de volgorde waarin de groepen van variabelen worden toegevoegd. Via die 'enter methode' heb ik dus de beste volgorde gevonden en daarmee het definitieve model. Nu wil ik weten wat de verklarende waarde per groep is in dit definitieve model. Volgens mij is dit dus niet zo simpel als verschillen in R2...quote:Op donderdag 19 juli 2012 09:49 schreef Fingon het volgende:

[..]

Het percentage dat zo'n extra variabele verklaart is het verschil tussen de R2 met en zonder die variabele(volgens mij, of anders dat getal met een verwaarloosbaar verschil).

Het staat trouwens gewoon theoretisch vast dat je met een extra variabele nooit slechter kan verklaren, dus dat zou geen verrassing moeten zijn dat een model met meer variabelen een hogere R2 heeft.

Klopt, dus post die tabel eventjes dan kan ik het uitleggen ^^quote:Op donderdag 19 juli 2012 09:54 schreef bart1074 het volgende:

[..]

Dat is dus niet waar, want het is sterk afhankelijk van de volgorde waarin de groepen van variabelen worden toegevoegd. Via die 'enter methode' heb ik dus de beste volgorde gevonden en daarmee het definitieve model. Nu wil ik weten wat de verklarende waarde per groep is in dit definitieve model. Volgens mij is dit dus niet zo simpel als verschillen in R2...

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Feit is wel dat je nooit een hogere R2 kan krijgen met minder (van dezelfde) variabelen.quote:Op donderdag 19 juli 2012 09:54 schreef oompaloompa het volgende:

[..]

Nee dat i niet helemaal waar. Stel dat je twee variabelen hebt, A en B. A en B correleren met elkaar met .5

Als je alleen A in het model toevoegt zal de verklaarde variantie van A overschat worden omdat dat gedeelte dat door B verklaard wordt maar niet in het model meegenomen is, voor die .5 door A vrklaard zal worden.

Beneath the gold, bitter steel

Alvast bedankt voor je hulp. Hier kan je een excel file downloaden met de volledige output.quote:Op donderdag 19 juli 2012 09:43 schreef oompaloompa het volgende:

[..]

Kun je even de tabel copy pasten van model 4 met de regressiecoefficienten?

Klopt. Daarom heb je helemaal op het einde van de tabel de sig. F change. Die kijkt of de toegenomen verklaarde variantie t.o.v. de toegenomen degrees of freedom wel significant is.quote:Op donderdag 19 juli 2012 09:56 schreef Fingon het volgende:

[..]

Feit is wel dat je nooit een hogere R2 kan krijgen met minder (van dezelfde) variabelen.

In de excell file staat alleen dezelfde tabel als die je hier gepost hebt.quote:Op donderdag 19 juli 2012 09:58 schreef bart1074 het volgende:

[..]

Alvast bedankt voor je hulp. Hier kan je een excel file downloaden met de volledige output.

Edit: ik kan niet lezen

Ik probeer het wel even zonder de tabel.

bij de regression coefficients heb je als het goed is een B (ongestandaardiseerd) en een beta.

De B betekent ongeveer dat elke toename van 1 in die variabele leidt tot een toename van B in je afhankelijke.

Voor de betas zijn alle onafhankelijken gestandaardiseerd, is de variantie van alke onafhankelijke op 1 gezet. Dat betekent dus dat de beta laat zien hoeveel een toename van 1 standaardeviatie uitmaakt voor de afhankelijke. Omdat die allemaal gestandaardiseerd zijn, kun je je onafhankelijken vergelijken op de betas. Heeft bv onafhankelijke a een beta van 2, en onafhankelijke b eentje van 1. Dan is het effect van onafhankelijke 1 twee keer zo groot (per toename van 1 std) als het effect van onafhankelijke b.

Hopelijk is dat een beetje begrijpelijk

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Altijd lekker om op zaterdagavond bezig te zijn met scriptie en SPSS.

Over dat fijne programma gesproken; ik heb in mijn enquete een vraag die met ja / nee beantwoord kan worden en vervolgens ook een veld met toelichting eraan gekoppeld (maar niet verplicht om in te vullen). Hoe verwerk ik dit in mijn variable view? Kom er niet echt aan uit..

Thanks!

Over dat fijne programma gesproken; ik heb in mijn enquete een vraag die met ja / nee beantwoord kan worden en vervolgens ook een veld met toelichting eraan gekoppeld (maar niet verplicht om in te vullen). Hoe verwerk ik dit in mijn variable view? Kom er niet echt aan uit..

Thanks!

Een tweede variabele maken voor die toelichting. Dus een dichotome ('numeric') variabele voor de ja/nee, en daarna meteen een string variabele voor die toelichting.

'Expand my brain, learning juice!'

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

Iemand enig idee hoe je verschillende grafieken op dezelfde grootte kan maken? Dus als je ze dan in word plakt, ze dan precies op 1 lijn naast elkaar komen staan. Height en width hetzelfde maken werkt op 1 of andere manier niet..

Shine bright like a diamond.

Ik maak mijn grafieken altijd in excell omdat je daar veel flexibeler in kunt zijn, geen oplossing voor je probleem maar misschien wle een goede b-optie.

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Hm, alleen dit zijn Kaplan-meier plots en heb geen zin om alle data en vervolgens de grafieken etc ook weer aan te passen in excel..quote:Op vrijdag 27 juli 2012 14:59 schreef oompaloompa het volgende:

Ik maak mijn grafieken altijd in excell omdat je daar veel flexibeler in kunt zijn, geen oplossing voor je probleem maar misschien wle een goede b-optie.

Macro's in word ken ik niet?

Shine bright like a diamond.

Als je geen zin heb om data aan te passen dan zul je helemaal geen zin hebben om een macro te schrijven.

Die macro hoef je niet te schrijven maar kan je opnemen. Wat makkelijk is. Hoe het precies werkt is afhankelijk van de Word versie. F1 of google 'are your best friends' hier.

Aldus.

Haha thanks, ik zal even kijken  Ik had alleen gehoopt dat het op een wat makkelijker manier mat SPSS kon..

Ik had alleen gehoopt dat het op een wat makkelijker manier mat SPSS kon..

Shine bright like a diamond.

Ik ben bezig met mijn bachelorscriptie, waarin ik onderzoek doe naar de verschillen tussen studenten die een internationale carriere nastreven in

1) een Westers land

2) een Opkomende Economie

3) maakt niet uit

Hiervoor heb ik aan de hand van theorie 6 variabelen ontwikkelt en een vragenlijst geconstrueerd, met meerdere items per variabele.

Dit is mijn conceptuele model:

Gezien mijn afhankelijke variabele een categorische(/nominale) is met 3 categorieën, moet ik volgens veel literatuur een Discriminantmieanalyse of een Logistische regressie uitvoeren. Met de uitkomst van deze toetsen krijg ik voornamelijk kansverwachtingen.

Het klinkt voor mij echter intuïtiever om een er een analyse op basis van T-testen op los te laten, zoals een ANOVA. Ik wil uiteindelijk immers de verschillen in gemiddelden weten, om te bepalen of studenten die kiezen voor een Westers land bijvoorbeeld meer aangetrokken worden door een hogere levenskwaliteit, en diegenen die voor opkomende economieën kiezen (bijvoorbeeld) voor de Cultuur.

>>Wat is jullie mening? Heb ik mijn conceptueel model gewoon verkeerd getekend?

1) een Westers land

2) een Opkomende Economie

3) maakt niet uit

Hiervoor heb ik aan de hand van theorie 6 variabelen ontwikkelt en een vragenlijst geconstrueerd, met meerdere items per variabele.

Dit is mijn conceptuele model:

Gezien mijn afhankelijke variabele een categorische(/nominale) is met 3 categorieën, moet ik volgens veel literatuur een Discriminantmieanalyse of een Logistische regressie uitvoeren. Met de uitkomst van deze toetsen krijg ik voornamelijk kansverwachtingen.

Het klinkt voor mij echter intuïtiever om een er een analyse op basis van T-testen op los te laten, zoals een ANOVA. Ik wil uiteindelijk immers de verschillen in gemiddelden weten, om te bepalen of studenten die kiezen voor een Westers land bijvoorbeeld meer aangetrokken worden door een hogere levenskwaliteit, en diegenen die voor opkomende economieën kiezen (bijvoorbeeld) voor de Cultuur.

>>Wat is jullie mening? Heb ik mijn conceptueel model gewoon verkeerd getekend?

Is je DV categorisch? Dus mensen hebben of westers, of opkomend of maakt niet uit, of is het een schaal?quote:Op zondag 29 juli 2012 23:28 schreef DutchCow het volgende:

Ik ben bezig met mijn bachelorscriptie, waarin ik onderzoek doe naar de verschillen tussen studenten die een internationale carriere nastreven in

1) een Westers land

2) een Opkomende Economie

3) maakt niet uit

Hiervoor heb ik aan de hand van theorie 6 variabelen ontwikkelt en een vragenlijst geconstrueerd, met meerdere items per variabele.

Dit is mijn conceptuele model:

[ link | afbeelding ]

Gezien mijn afhankelijke variabele een categorische(/nominale) is met 3 categorieën, moet ik volgens veel literatuur een Discriminantmieanalyse of een Logistische regressie uitvoeren. Met de uitkomst van deze toetsen krijg ik voornamelijk kansverwachtingen.

Het klinkt voor mij echter intuïtiever om een er een analyse op basis van T-testen op los te laten, zoals een ANOVA. Ik wil uiteindelijk immers de verschillen in gemiddelden weten, om te bepalen of studenten die kiezen voor een Westers land bijvoorbeeld meer aangetrokken worden door een hogere levenskwaliteit, en diegenen die voor opkomende economieën kiezen (bijvoorbeeld) voor de Cultuur.

>>Wat is jullie mening? Heb ik mijn conceptueel model gewoon verkeerd getekend?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

(Als je met DV Dependent Variabele bedoelt): Ik heb dit inderdaad een beetje onduidelijk aangeven.quote:Op zondag 29 juli 2012 23:32 schreef oompaloompa het volgende:

[..]

Is je DV categorisch? Dus mensen hebben of westers, of opkomend of maakt niet uit, of is het een schaal?

Ik heb een vragenlijst uitgedeeld waarin de respondenten eerst 7 voorkeurslanden mochten aangeven. Daaruit heb ik de drie categorieën gemaakt:

Als er 6 of 7 Westerse landen werden gemarkeerd: Klasse = Westers

Als er 6 of 7 Opkomende landen werden gemarkeerd: Klasse = Opkomend

Als dit niet het geval was: Geen specifieke voorkeur.

Ik zou dit natuurlijk ook als een metrische schaal kunnen zien (Westers met de waarden 1,2,3,4,5,6 of 7)..

Ik heb de oplossing zelf gevonden, dus voor iedereen die hier ook problemen mee heeft:quote:Op vrijdag 27 juli 2012 14:47 schreef June. het volgende:

Iemand enig idee hoe je verschillende grafieken op dezelfde grootte kan maken? Dus als je ze dan in word plakt, ze dan precies op 1 lijn naast elkaar komen staan. Height en width hetzelfde maken werkt op 1 of andere manier niet..

In je graph editor kun je van een bestaande grafiek een template maken (ergens onder file) en deze kun je dan weer toepassen op je andere grafieken

Shine bright like a diamond.

Ik zou gewoon 0-7 doen en anovas / t-toetsen. Zodra je het hercategoriseert verlies je waardevolle informatie (6 is niet hetzelfde als 7 net zomin als 0 hetzelfde als 5 niet-westers) vraag is alleen of je westers v.s. opkomend als 1 categorie met twee uitersten kunt zien of dat je westers en opkomend als twee losse Dependents moet nemen.quote:Op zondag 29 juli 2012 23:46 schreef DutchCow het volgende:

[..]

(Als je met DV Dependent Variabele bedoelt): Ik heb dit inderdaad een beetje onduidelijk aangeven.

Ik heb een vragenlijst uitgedeeld waarin de respondenten eerst 7 voorkeurslanden mochten aangeven. Daaruit heb ik de drie categorieën gemaakt:

Als er 6 of 7 Westerse landen werden gemarkeerd: Klasse = Westers

Als er 6 of 7 Opkomende landen werden gemarkeerd: Klasse = Opkomend

Als dit niet het geval was: Geen specifieke voorkeur.

Ik zou dit natuurlijk ook als een metrische schaal kunnen zien (Westers met de waarden 1,2,3,4,5,6 of 7)..

Nice, goed om te weten als ik ooit tegen dit probleem aanloop!quote:Op zondag 29 juli 2012 23:58 schreef June. het volgende:

[..]

Ik heb de oplossing zelf gevonden, dus voor iedereen die hier ook problemen mee heeft:

In je graph editor kun je van een bestaande grafiek een template maken (ergens onder file) en deze kun je dan weer toepassen op je andere grafieken.

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Ik zit er nog even overna te denken waarom ik destijds in mijn onderzoeksopzet voor de categorieën gekozen heb. Ik denk dat de 0-7 oplossing inderdaad duidelijker is. Ik zit alleen nog met een klein probleem: er zijn meer 'westerse' landen in de landenlijst dan 'opkomende landen'.. De kans dat men voor een westers land kiest is dus groter. Moet en kan ik hiervoor corrigeren?quote:Op maandag 30 juli 2012 00:04 schreef oompaloompa het volgende:

[..]

Ik zou gewoon 0-7 doen en anovas / t-toetsen. Zodra je het hercategoriseert verlies je waardevolle informatie (6 is niet hetzelfde als 7 net zomin als 0 hetzelfde als 5 niet-westers) vraag is alleen of je westers v.s. opkomend als 1 categorie met twee uitersten kunt zien of dat je westers en opkomend als twee losse Dependents moet nemen.

Zolang je mensen onderling vergelijkt niet, als je absolute claims wilt maken wel, maar dat gaat nogal moeilijk. Zou het alleen noemen in de discussie.quote:Op maandag 30 juli 2012 00:11 schreef DutchCow het volgende:

[..]

Ik zit er nog even overna te denken waarom ik destijds in mijn onderzoeksopzet voor de categorieën gekozen heb. Ik denk dat de 0-7 oplossing inderdaad duidelijker is. Ik zit alleen nog met een klein probleem: er zijn meer 'westerse' landen in de landenlijst dan 'opkomende landen'.. De kans dat men voor een westers land kiest is dus groter. Moet en kan ik hiervoor corrigeren?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

(echt bedankt voor je snelle reacties oompaloompa!)

Sorry dat ik weet terugkom met mijn vraag, maar ik kom er echt niet meer uit

Het komt erop neer dat ik onderzoek:

->Welke factoren van invloed zijn op de keuze tussen een westers of een opkomend land (deze deelvraag is reeds onderzocht in het literaire deel, daaruit heb ik zes variabelen gemaakt en gemeten)

Een volgende deelvraag is:

Wat de verschillen in motieven zijn om in een opkomend- of een westers land te willen werken. Hierbij verwacht ik dus dat op sommige variabelen de westerse groep hoger scoort dan de andere groep (de opkomende landen).

Simpel zou je zeggen: Gooi er in SPSS een ANOVA overheen, de 6 variabelen worden dan ingevuld als dependent, en de landklasse (westers, opkomend, geen voorkeur) als 'factor' waarop wordt gegroepeerd. Ik krijg dan ook netjes de significante verschillen in gemiddelden, hiep hiep hoera!

Maarrr.. Kijkend naar mijn conceptuele model (zie figuur in mijn post hierboven) mag ik toch helemaal geen ANOVA gebruiken? De onafhankelijke variabelen zijn in mijn SPSS invoer ingevoerd als de AFhankelijke? Ik keer als het ware mijn hele conceptuele model om, dat is toch vreemd?

[edit]: verder lees ik dat ANOVA gebruikelijk is in experimenten, terwijl mijn onderzoek natuurlijk de werkelijkheid tracht te omschrijven, zonder als onderzoeker deze te beïnvloeden[/edit]

Sorry dat ik weet terugkom met mijn vraag, maar ik kom er echt niet meer uit

Het komt erop neer dat ik onderzoek:

->Welke factoren van invloed zijn op de keuze tussen een westers of een opkomend land (deze deelvraag is reeds onderzocht in het literaire deel, daaruit heb ik zes variabelen gemaakt en gemeten)

Een volgende deelvraag is:

Wat de verschillen in motieven zijn om in een opkomend- of een westers land te willen werken. Hierbij verwacht ik dus dat op sommige variabelen de westerse groep hoger scoort dan de andere groep (de opkomende landen).

Simpel zou je zeggen: Gooi er in SPSS een ANOVA overheen, de 6 variabelen worden dan ingevuld als dependent, en de landklasse (westers, opkomend, geen voorkeur) als 'factor' waarop wordt gegroepeerd. Ik krijg dan ook netjes de significante verschillen in gemiddelden, hiep hiep hoera!

Maarrr.. Kijkend naar mijn conceptuele model (zie figuur in mijn post hierboven) mag ik toch helemaal geen ANOVA gebruiken? De onafhankelijke variabelen zijn in mijn SPSS invoer ingevoerd als de AFhankelijke? Ik keer als het ware mijn hele conceptuele model om, dat is toch vreemd?

[edit]: verder lees ik dat ANOVA gebruikelijk is in experimenten, terwijl mijn onderzoek natuurlijk de werkelijkheid tracht te omschrijven, zonder als onderzoeker deze te beïnvloeden[/edit]

Oke... Ik voel mijzelf nu echt onwijs stom

Mijn data bestaat uit kinderen van 5 - 18 jaar met een ziekte. In de leeftijdsgroep van 8-12 jaar heb ik data van gezonde kinderen. Ik heb daarom deze kinderen in één bestand gezet met mijn zieke kinderen van 8-12 jaar en daarbij heb ik gekeken of er verschillen zijn. Dit ging gewoon prima.

Nu heb ik een artikel gevonden waar ook data in staat van gezonde kinderen, in dezelfde leeftijdsgroep en deze ga ik als (extra) referentie-groep gebruiken.

Ik heb deze gemiddelden nu in een SPSS bestand gezet en daarbij ook mijn eigen gemiddelden. Hier heb ik een t-test op los gelaten (totale groep van 5-18 jaar, gezond/ziek) en daar kwamen de nodige getallen uit. Prima.

Maar... Nu wil ik nog de gemiddelde toetsen van 5-7 jaar en 13-18 jaar met deze referentiegroep. Echter, ik snap niet goed hoe ik dat moet doen

Ik heb daarbij de data (dus alleen de gemiddelden van de vier variabelen van gezonde als zieke kinderen) van 5-7 in een bestand gezet.

Als ik het namelijk doe zoals ik het bij de hele groep heb gedaan (dus 5-18 gezond en 5-18 ziek), dan rekent hij verder niets uit.

Mijn data bestaat uit kinderen van 5 - 18 jaar met een ziekte. In de leeftijdsgroep van 8-12 jaar heb ik data van gezonde kinderen. Ik heb daarom deze kinderen in één bestand gezet met mijn zieke kinderen van 8-12 jaar en daarbij heb ik gekeken of er verschillen zijn. Dit ging gewoon prima.

Nu heb ik een artikel gevonden waar ook data in staat van gezonde kinderen, in dezelfde leeftijdsgroep en deze ga ik als (extra) referentie-groep gebruiken.

Ik heb deze gemiddelden nu in een SPSS bestand gezet en daarbij ook mijn eigen gemiddelden. Hier heb ik een t-test op los gelaten (totale groep van 5-18 jaar, gezond/ziek) en daar kwamen de nodige getallen uit. Prima.

Maar... Nu wil ik nog de gemiddelde toetsen van 5-7 jaar en 13-18 jaar met deze referentiegroep. Echter, ik snap niet goed hoe ik dat moet doen

Ik heb daarbij de data (dus alleen de gemiddelden van de vier variabelen van gezonde als zieke kinderen) van 5-7 in een bestand gezet.

Als ik het namelijk doe zoals ik het bij de hele groep heb gedaan (dus 5-18 gezond en 5-18 ziek), dan rekent hij verder niets uit.

"It's good to be open-minded, but not so open that your brains fall out."

Neem dit niet verkeerd op, maar het klinkt alsof je eigenlijk niet zo goed weet wat je aan het doen bent.quote:Op maandag 30 juli 2012 12:26 schreef DutchCow het volgende:

(echt bedankt voor je snelle reacties oompaloompa!)

Sorry dat ik weet terugkom met mijn vraag, maar ik kom er echt niet meer uit

Het komt erop neer dat ik onderzoek:

->Welke factoren van invloed zijn op de keuze tussen een westers of een opkomend land (deze deelvraag is reeds onderzocht in het literaire deel, daaruit heb ik zes variabelen gemaakt en gemeten)

Een volgende deelvraag is:

Wat de verschillen in motieven zijn om in een opkomend- of een westers land te willen werken. Hierbij verwacht ik dus dat op sommige variabelen de westerse groep hoger scoort dan de andere groep (de opkomende landen).

Simpel zou je zeggen: Gooi er in SPSS een ANOVA overheen, de 6 variabelen worden dan ingevuld als dependent, en de landklasse (westers, opkomend, geen voorkeur) als 'factor' waarop wordt gegroepeerd. Ik krijg dan ook netjes de significante verschillen in gemiddelden, hiep hiep hoera!

Maarrr.. Kijkend naar mijn conceptuele model (zie figuur in mijn post hierboven) mag ik toch helemaal geen ANOVA gebruiken? De onafhankelijke variabelen zijn in mijn SPSS invoer ingevoerd als de AFhankelijke? Ik keer als het ware mijn hele conceptuele model om, dat is toch vreemd?

[edit]: verder lees ik dat ANOVA gebruikelijk is in experimenten, terwijl mijn onderzoek natuurlijk de werkelijkheid tracht te omschrijven, zonder als onderzoeker deze te beïnvloeden[/edit]

Anovas en regressies zijn techinisch hetzelfde, statistiek is niets anders dan formules dus de analyse die je gebruikt zal niet opeens de werkelijkheid beinvloeden o.i.d.

Als je gemeten motieven continu zijn kun je waarschijnlijk het beste een regressie doen met het aantal landen als adhankelijke (test wel eerst even de assumpties, kijk of er daadwerkelijk een linear verband is etc.)

Als je motiven enkele categorien zijn is het gemakkelijker een anova te doen.

Ik snap totaal niet wat je bedoeltquote:Op maandag 30 juli 2012 12:50 schreef automatic_ het volgende:

Oke... Ik voel mijzelf nu echt onwijs stom

Mijn data bestaat uit kinderen van 5 - 18 jaar met een ziekte. In de leeftijdsgroep van 8-12 jaar heb ik data van gezonde kinderen. Ik heb daarom deze kinderen in één bestand gezet met mijn zieke kinderen van 8-12 jaar en daarbij heb ik gekeken of er verschillen zijn. Dit ging gewoon prima.

Nu heb ik een artikel gevonden waar ook data in staat van gezonde kinderen, in dezelfde leeftijdsgroep en deze ga ik als (extra) referentie-groep gebruiken.

Ik heb deze gemiddelden nu in een SPSS bestand gezet en daarbij ook mijn eigen gemiddelden. Hier heb ik een t-test op los gelaten (totale groep van 5-18 jaar, gezond/ziek) en daar kwamen de nodige getallen uit. Prima.

Maar... Nu wil ik nog de gemiddelde toetsen van 5-7 jaar en 13-18 jaar met deze referentiegroep. Echter, ik snap niet goed hoe ik dat moet doen

Ik heb daarbij de data (dus alleen de gemiddelden van de vier variabelen van gezonde als zieke kinderen) van 5-7 in een bestand gezet.

Als ik het namelijk doe zoals ik het bij de hele groep heb gedaan (dus 5-18 gezond en 5-18 ziek), dan rekent hij verder niets uit.

Je hebt alle data toch of alleen gemiddelde en sd?

Kun je even precies zeggen wat je probeert te doen en wat je van spss terug krijgt?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Uitleg is niet mijn sterkte kant

Nee, van de referentiegroep uit het artikel heb ik alleen de gemiddelde (en eventueel ook de SD, maar ik heb nu alleen de gemiddelde in een bestand gezet).

En ik probeerde een t-test te doen. Ik kom er zo even op terug!

Nee, van de referentiegroep uit het artikel heb ik alleen de gemiddelde (en eventueel ook de SD, maar ik heb nu alleen de gemiddelde in een bestand gezet).

En ik probeerde een t-test te doen. Ik kom er zo even op terug!

"It's good to be open-minded, but not so open that your brains fall out."

Maar hoe doe je een t-test zonder sd?quote:Op maandag 30 juli 2012 13:18 schreef automatic_ het volgende:

Uitleg is niet mijn sterkte kant

Nee, van de referentiegroep uit het artikel heb ik alleen de gemiddelde (en eventueel ook de SD, maar ik heb nu alleen de gemiddelde in een bestand gezet).

En ik probeerde een t-test te doen. Ik kom er zo even op terug!

je kunt niet gewoon een 1-sample doen

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Weet ik veelquote:Op maandag 30 juli 2012 13:40 schreef oompaloompa het volgende:

[..]

Maar hoe doe je een t-test zonder sd?

je kunt niet gewoon een 1-sample doen

Dat van die one-sample was ik al achter. Momentje. Ik ga het even openen.

"It's good to be open-minded, but not so open that your brains fall out."

Mag ik het anders even "duidelijk" (althans... dat probeer ik) in een mailtje zetten?

"It's good to be open-minded, but not so open that your brains fall out."

Tuurlijk, ben alleen wel zo weg van internet, dus alvast een tip. Om een t-test te doen heb je een gemiddelde en spreiding nodig. Als je geen raw data hebt, is het waarschijnlijk het gemakkelijkste gewoon een t-test met de hand (excell/rekenmachine) te doen.quote:Op maandag 30 juli 2012 13:48 schreef automatic_ het volgende:

Mag ik het anders even "duidelijk" (althans... dat probeer ik) in een mailtje zetten?

Op dinsdag 1 november 2016 00:05 schreef JanCees het volgende:

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

De polls worden ook in 9 van de 10 gevallen gepeild met een meerderheid democraten. Soms zelf +10% _O-

Mailtje is al onderweg, haha. Geen probleem als het niet lukt om er naar te kijken!

Een t-test met de hand?! Oh hemel... Heb ik dat ooit geleerd?

Een t-test met de hand?! Oh hemel... Heb ik dat ooit geleerd?

"It's good to be open-minded, but not so open that your brains fall out."

Als je methodenonderwijs een beetje goed is, heb je dat gehad jaquote:Op maandag 30 juli 2012 13:53 schreef automatic_ het volgende:

Mailtje is al onderweg, haha. Geen probleem als het niet lukt om er naar te kijken!

Een t-test met de hand?! Oh hemel... Heb ik dat ooit geleerd?

Ja, dat is vast goed geweest, maar ook jij kent mijn SPSS / Statistiek / MTO kunstenquote:Op maandag 30 juli 2012 15:12 schreef Sandertje23 het volgende:

[..]

Als je methodenonderwijs een beetje goed is, heb je dat gehad ja

"It's good to be open-minded, but not so open that your brains fall out."

Zijn er nog mensen aanwezig?  Ik heb een vraagje over mijn data analyse..

Ik heb een vraagje over mijn data analyse..

Ik heb een soort van Counts tabel waarin staat hoe vaak een variabele is gekozen (f) hoe vaak die voorkwam (b) en percentueel (%) tov de andere variabelen. Zo dus:

Sample Size 229 229 100,00

Groep 1:.................................f .......... b.....%

1............................................103... 203....50,74

2 ............................................ 71 203 34,98

3............................................ 29 203 14,29

Groep 2:

1............................................63 170 37,06

2 ............................................48 170 28,24

3 ............................................ 59 170 34,71

Nou is me aangeraden om een chi² toets te doen om te kijken of er een significant verschil in aantal keer gekozen zit. Ik dacht dit gedaan te hebben in Excel, door te verwachten dat ze allemaal gelijk werden gekozen (per groep) en dan een chi square per groep. Maar, steeds als ik het in SPSS doe, en nu ik het in een excel macro doe, heb je 2 datasets nodig om de chi² te doen.

Hoe moet ik hem dan doen? Oftewel: welke variabelen moet ik invoeren? HELP!

Of ben ik al klaar als ik de variabelen in kolommen zet ipv rijen?

Edit: layout probleempje..

Ik heb een soort van Counts tabel waarin staat hoe vaak een variabele is gekozen (f) hoe vaak die voorkwam (b) en percentueel (%) tov de andere variabelen. Zo dus:

Sample Size 229 229 100,00

Groep 1:.................................f .......... b.....%

1............................................103... 203....50,74

2 ............................................ 71 203 34,98

3............................................ 29 203 14,29

Groep 2:

1............................................63 170 37,06

2 ............................................48 170 28,24

3 ............................................ 59 170 34,71

Nou is me aangeraden om een chi² toets te doen om te kijken of er een significant verschil in aantal keer gekozen zit. Ik dacht dit gedaan te hebben in Excel, door te verwachten dat ze allemaal gelijk werden gekozen (per groep) en dan een chi square per groep. Maar, steeds als ik het in SPSS doe, en nu ik het in een excel macro doe, heb je 2 datasets nodig om de chi² te doen.

Hoe moet ik hem dan doen? Oftewel: welke variabelen moet ik invoeren? HELP!

Of ben ik al klaar als ik de variabelen in kolommen zet ipv rijen?

Edit: layout probleempje..

Volgens mij moet je drie variabelen maken.

(1) geeft aan of het om groep 1 of 2 gaat

(2) geeft aan of het 1, 2 of 3 betreft

(3) de aantallen, die je vervolgens weegt via data - weigh variables of zo. Ergens onderaan de lijst.

Bij crosstabs geeft je dan de variabele van groep 1 en groep twee als layer op.

(1) geeft aan of het om groep 1 of 2 gaat

(2) geeft aan of het 1, 2 of 3 betreft

(3) de aantallen, die je vervolgens weegt via data - weigh variables of zo. Ergens onderaan de lijst.

Bij crosstabs geeft je dan de variabele van groep 1 en groep twee als layer op.

'Expand my brain, learning juice!'

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

Maar, ik heb dat onduidelijk weergegeven, de variabelen in groep 1 en 2 zijn andere variabelen. Het gaat om een conjunct analyse waarbij Groep 1 een type kamer is, waarvan 1 = eenpersoonskamer, 2 = tweepersoonskamer en 3 is 4 of meer persoonskamer. En Groep twee is Uitzicht met 1 landschap, 2 stad, 3 park. Mensen die een eenpersoonskamer kiezne kunnen dus ook kiezen voor een landschap maar daar heb ik geen informatie over. Dan mag ik ze toch niet op die manier vergelijken?quote:Op dinsdag 7 augustus 2012 10:13 schreef crossover het volgende:

Volgens mij moet je drie variabelen maken.

(1) geeft aan of het om groep 1 of 2 gaat

(2) geeft aan of het 1, 2 of 3 betreft

(3) de aantallen, die je vervolgens weegt via data - weigh variables of zo. Ergens onderaan de lijst.

Bij crosstabs geeft je dan de variabele van groep 1 en groep twee als layer op.

Ik wil juist weten binnen een zo'n groep of daar inderdaad grote verschillen zitten in de frequentie van keuze..

Ik zou hier dieper op in moeten gaan om hier goed antwoord op te geven en daar heb ik helaas geen tijd voor.. misschien kan je professionele hulp inschakelen of een collega(-student) vragen?

'Expand my brain, learning juice!'

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

Oke, geeft niets! Ik had er professionele hulp voor ingeschakeld, maar zei had eigenlijk alleen gezegd dat ik een chi² kon doen hierop om te kijken of ze verschilden maar nu ben ik zelf enorm gaan twijfelen en is zij op vakantie.. Paniek hier dus!quote:Op dinsdag 7 augustus 2012 10:46 schreef crossover het volgende:

Ik zou hier dieper op in moeten gaan om hier goed antwoord op te geven en daar heb ik helaas geen tijd voor.. misschien kan je professionele hulp inschakelen of een collega(-student) vragen?

Toch bedankt voor je hulp.

Hey allemaal,

deze vraag is vooral naar Vreemdeeend gericht, maar anderen mogen natuurlijk ook antwoorden.

Ik heb in SPSS (wat anders) een onafhankelijke variabele "jaar". Deze variabele bestaat uit de jaren 1999, 2006 en 2010. Ik gebruik namelijk data van deze drie jaren om mijn onderzoek te verrichten. Ik wil onderzoeken of deze variabele ook een invloed heeft op mijn afhankelijke variabele.

Ik vraag me nu echter af hoe ik deze variabele moet coderen? Gebruik ik hem als continue variabele en steek ik hem "gewoon" in mijn model OF zet ik het over in dummy's waarbij ik een referentiecategorie kies?

Alvast bedankt!

deze vraag is vooral naar Vreemdeeend gericht, maar anderen mogen natuurlijk ook antwoorden.

Ik heb in SPSS (wat anders) een onafhankelijke variabele "jaar". Deze variabele bestaat uit de jaren 1999, 2006 en 2010. Ik gebruik namelijk data van deze drie jaren om mijn onderzoek te verrichten. Ik wil onderzoeken of deze variabele ook een invloed heeft op mijn afhankelijke variabele.

Ik vraag me nu echter af hoe ik deze variabele moet coderen? Gebruik ik hem als continue variabele en steek ik hem "gewoon" in mijn model OF zet ik het over in dummy's waarbij ik een referentiecategorie kies?

Alvast bedankt!

Heb je alleen jaar als onafhankelijke variabele? Dan is het een simpele 1-way-ANOVA en hoef je niets te hercoderen.quote:Op woensdag 8 augustus 2012 23:33 schreef Melli7 het volgende:

Hey allemaal,

deze vraag is vooral naar Vreemdeeend gericht, maar anderen mogen natuurlijk ook antwoorden.

Ik heb in SPSS (wat anders) een onafhankelijke variabele "jaar". Deze variabele bestaat uit de jaren 1999, 2006 en 2010. Ik gebruik namelijk data van deze drie jaren om mijn onderzoek te verrichten. Ik wil onderzoeken of deze variabele ook een invloed heeft op mijn afhankelijke variabele.

Ik vraag me nu echter af hoe ik deze variabele moet coderen? Gebruik ik hem als continue variabele en steek ik hem "gewoon" in mijn model OF zet ik het over in dummy's waarbij ik een referentiecategorie kies?

Alvast bedankt!

Neen helaas!

Mijn onafhankelijke variabelen zijn: jaar, arbeidsmarktstatus, opleidingsniveau, inkomen en gezondheidstoestand

Mijn afhankelijke variabele zijn consumptie-uitgaven.

Het is dus de bedoeling om een meervoudige lineaire regressie uit te voeren.

Maar het is met de variabele jaar dat ik vastzit. Ik weet niet goed hoe deze in mijn model thuishoort. Maar het is wel belangrijk aangezien het jaar ook een invloed kan hebben op de consumptie-uitgaven.

[ Bericht 24% gewijzigd door Melli7 op 08-08-2012 23:54:51 (verduidelijking) ]

Mijn onafhankelijke variabelen zijn: jaar, arbeidsmarktstatus, opleidingsniveau, inkomen en gezondheidstoestand

Mijn afhankelijke variabele zijn consumptie-uitgaven.

Het is dus de bedoeling om een meervoudige lineaire regressie uit te voeren.

Maar het is met de variabele jaar dat ik vastzit. Ik weet niet goed hoe deze in mijn model thuishoort. Maar het is wel belangrijk aangezien het jaar ook een invloed kan hebben op de consumptie-uitgaven.

[ Bericht 24% gewijzigd door Melli7 op 08-08-2012 23:54:51 (verduidelijking) ]

Ik denk dat je niet veel keuze hebt en wel dummys moet gebruiken. Het is namelijk geen interval- of ratioschaal.

'Expand my brain, learning juice!'

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

<a href="http://www.last.fm/user/crossover1" rel="nofollow" target="_blank">Last.fm</a>

Ik had al op internet gekeken en daar kan je geboortedatum terugbrengen naar getallen door compute te gebruiken. Dus in mijn geval zou ik 2012-1999= 13, 2012-2006=6 en 2012-2010= 2.

Maar denk dat ik het probleem dan alleen maar verleg....

Zullen het eens met dummy's proberen!

In ieder geval bedankt!

Maar denk dat ik het probleem dan alleen maar verleg....

Zullen het eens met dummy's proberen!

In ieder geval bedankt!

Dat kan best hoor. Dan wordt het gewoon een interval/ratioschaal en kan je 'm wel gebruiken.

'Expand my brain, learning juice!'