F&L Filosofie & Levensbeschouwing

Een plek om te discussiëren over filosofische vragen, filosofen, religieuze vraagstukken of religie en levensbeschouwing in het algemeen.

In een ander topic kwam dit even in een volstrekt off-topic zijpaadje ter sprake en ik denk dat het een eigen topic waard is.

De vrij plotselinge opkomst van generatieve AI heeft de manier waarop we online discussiëren ingrijpend veranderd. Waar sociale media en fora ooit uitsluitend draaiden om het uitwisselen van gedachten tussen mensen, verschijnen er steeds vaker bijdragen die (deels) door een taalmodel zijn geschreven. Soms is dat expliciet zichtbaar, zoals bij Grok op X, dat vooral wordt ingezet als factchecker. Soms gebeurt het ongemerkt, wanneer een gebruiker AI raadpleegt en het resultaat onder eigen naam als reactie plaatst. Wat verwachten we eigenlijk van een online discussie en hoe verhoudt AI zich tot die verwachting?

Een belangrijk voordeel van AI is de snelheid waarmee het feitelijke of rationele tegenargumenten kan formuleren. Het kost doorgaans veel minder moeite om onzin te verzinnen dan om die te weerleggen. Daardoor is het publieke debat lange tijd kwetsbaar geweest voor complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin. Het voorbeeld Grok laat zien dat AI dit patroon kan doorbreken: er is plotseling een tegenmacht die foutieve uitspraken onmiddellijk van context voorziet of corrigeert. Dat werkt disciplinerend: wie onzin verkondigt, wordt sneller en effectiever tegengesproken dan voorheen.

Maar een gesprek is niet alleen een strijd om de waarheid, het is ook een sociaal ritueel. Fora en sociale media zijn plekken van ontmoeting, waar we de impliciete verwachting hebben dat een bijdrage door een mens geschreven is. Wanneer iemand ongemerkt een AI-tekst plaatst, kan dat voelen als verraad. Je dacht een gesprek te voeren met een ander, maar bleek in feite te communiceren met een computer. Dat roept een gevoel van oneerlijkheid op: jij hebt tijd en energie gestoken in een reactie, terwijl je gesprekspartner de arbeid heeft uitbesteed. Authenticiteit blijkt soms minstens zo belangrijk als inhoud.

Voor de Duitse filosoof Habermas is de publieke sfeer alleen gezond als deelnemers zich inzetten voor communicatieve rationaliteit: gesprekken waarin je argumenten eerlijk uitwisselt en gericht bent op wederzijds begrip. AI kan dit ideaal ondersteunen, door discussies feitelijker en gestructureerder te maken. Maar zodra AI wordt ingezet zonder dat de gesprekspartner het weet, wordt een van Habermas’ basisvoorwaarden geschonden: de waarachtigheid van je bijdrage. Een gesprek kan niet op louter inhoud rusten; ook de intentie van de spreker moet helder en eerlijk zijn.

Hannah Arendt biedt een iets breder perspectief. Voor haar is het publieke domein de ruimte waar mensen in hun uniciteit verschijnen, door middel van woorden en daden. We laten zien wie we zijn door ons te uiten in eigen taal en stijl. Als AI de woorden levert, komt de vraag op of iemand nog wel ‘verschijnt’. Of wordt diegene juist onzichtbaar, verscholen achter een technisch masker? Misschien verklaart dat waarom verborgen AI-gebruik zo veel weerstand oproept: we voelen intuïtief dat er iemand ontbreekt, dat de stem die we horen niet de unieke aanwezigheid van een ander mens is. Het publieke gesprek dreigt dan te verschralen, omdat er minder werkelijk menselijk verschijnen plaatsvindt.

Immanuel Kant voegt nog een derde dimensie toe. Voor Kant is eerlijkheid een plicht die voortkomt uit respect voor de ander als doel op zichzelf. Als je verzwijgt dat je een machine hebt gebruikt, behandel je de ander instrumenteel: je manipuleert hun verwachting van een menselijke interactie. Het gebruik van AI hoeft volgens een Kantiaanse logica niet verkeerd te zijn, zolang het transparant gebeurt en de ander met volledige kennis van zaken kan instemmen met het gesprek.

We zien dus drie kaders: Habermas wijst op de noodzaak van waarachtigheid voor een rationeel gesprek, Arendt op het belang van menselijke uniciteit in het publieke domein en Kant op de plicht tot eerlijkheid en transparantie. Samen maken ze duidelijk dat de inzet van AI in discussies niet louter een praktische kwestie is, maar een fundamentele filosofische uitdaging.

Tegenover deze zorgen staat echter onmiskenbaar ook de kwaliteitswinst. Een door AI geschreven reactie is vaak beter onderbouwd, minder emotioneel en meer to the point. Het gesprek kan daardoor terug op het spoor komen, in plaats van af te glijden naar chaos en insinuaties. Bovendien kan de gebruiker die de AI-tekst plaatst zich erachter scharen en de inhoud tot de zijne maken. Het effect is dan een dubbele kwaliteitsimpuls: de discussie wordt verbeterd en de individuele deelnemer groeit mee met de inhoud.

De centrale vraag is dan: hoeveel is die winst waard als tegelijkertijd het gevoel van authenticiteit verloren gaat? Een gesprek is immers meer dan een uitwisseling van proposities. Het is ook een ritueel van erkenning: ik laat zien dat ik jouw woorden serieus neem door er zelf woorden tegenover te stellen. Wanneer ik die woorden door een machine laat formuleren, breek ik met dat sociale contract.

Daarmee komen we uit bij de filosofische kernvraag: hoe moeten we ons verhouden tot de inzet van AI in discussies?

• Moeten we authenticiteit zwaarder laten wegen en AI-bijdragen als valsspelen veroordelen, ook al verbeteren ze de inhoud?

• Of moeten we de waarde van waarheid en kwaliteit vooropstellen en accepteren dat AI een legitieme gesprekspartner wordt, mits transparant?

• Of ligt de oplossing in disclosure: het verplicht vermelden dat een bijdrage met AI tot stand is gekomen, zodat duidelijk is wat de aard van de interactie is?

[ Bericht 0% gewijzigd door Jigzoz op 07-09-2025 06:36:52 ]

De vrij plotselinge opkomst van generatieve AI heeft de manier waarop we online discussiëren ingrijpend veranderd. Waar sociale media en fora ooit uitsluitend draaiden om het uitwisselen van gedachten tussen mensen, verschijnen er steeds vaker bijdragen die (deels) door een taalmodel zijn geschreven. Soms is dat expliciet zichtbaar, zoals bij Grok op X, dat vooral wordt ingezet als factchecker. Soms gebeurt het ongemerkt, wanneer een gebruiker AI raadpleegt en het resultaat onder eigen naam als reactie plaatst. Wat verwachten we eigenlijk van een online discussie en hoe verhoudt AI zich tot die verwachting?

Een belangrijk voordeel van AI is de snelheid waarmee het feitelijke of rationele tegenargumenten kan formuleren. Het kost doorgaans veel minder moeite om onzin te verzinnen dan om die te weerleggen. Daardoor is het publieke debat lange tijd kwetsbaar geweest voor complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin. Het voorbeeld Grok laat zien dat AI dit patroon kan doorbreken: er is plotseling een tegenmacht die foutieve uitspraken onmiddellijk van context voorziet of corrigeert. Dat werkt disciplinerend: wie onzin verkondigt, wordt sneller en effectiever tegengesproken dan voorheen.

Maar een gesprek is niet alleen een strijd om de waarheid, het is ook een sociaal ritueel. Fora en sociale media zijn plekken van ontmoeting, waar we de impliciete verwachting hebben dat een bijdrage door een mens geschreven is. Wanneer iemand ongemerkt een AI-tekst plaatst, kan dat voelen als verraad. Je dacht een gesprek te voeren met een ander, maar bleek in feite te communiceren met een computer. Dat roept een gevoel van oneerlijkheid op: jij hebt tijd en energie gestoken in een reactie, terwijl je gesprekspartner de arbeid heeft uitbesteed. Authenticiteit blijkt soms minstens zo belangrijk als inhoud.

Voor de Duitse filosoof Habermas is de publieke sfeer alleen gezond als deelnemers zich inzetten voor communicatieve rationaliteit: gesprekken waarin je argumenten eerlijk uitwisselt en gericht bent op wederzijds begrip. AI kan dit ideaal ondersteunen, door discussies feitelijker en gestructureerder te maken. Maar zodra AI wordt ingezet zonder dat de gesprekspartner het weet, wordt een van Habermas’ basisvoorwaarden geschonden: de waarachtigheid van je bijdrage. Een gesprek kan niet op louter inhoud rusten; ook de intentie van de spreker moet helder en eerlijk zijn.

Hannah Arendt biedt een iets breder perspectief. Voor haar is het publieke domein de ruimte waar mensen in hun uniciteit verschijnen, door middel van woorden en daden. We laten zien wie we zijn door ons te uiten in eigen taal en stijl. Als AI de woorden levert, komt de vraag op of iemand nog wel ‘verschijnt’. Of wordt diegene juist onzichtbaar, verscholen achter een technisch masker? Misschien verklaart dat waarom verborgen AI-gebruik zo veel weerstand oproept: we voelen intuïtief dat er iemand ontbreekt, dat de stem die we horen niet de unieke aanwezigheid van een ander mens is. Het publieke gesprek dreigt dan te verschralen, omdat er minder werkelijk menselijk verschijnen plaatsvindt.

Immanuel Kant voegt nog een derde dimensie toe. Voor Kant is eerlijkheid een plicht die voortkomt uit respect voor de ander als doel op zichzelf. Als je verzwijgt dat je een machine hebt gebruikt, behandel je de ander instrumenteel: je manipuleert hun verwachting van een menselijke interactie. Het gebruik van AI hoeft volgens een Kantiaanse logica niet verkeerd te zijn, zolang het transparant gebeurt en de ander met volledige kennis van zaken kan instemmen met het gesprek.

We zien dus drie kaders: Habermas wijst op de noodzaak van waarachtigheid voor een rationeel gesprek, Arendt op het belang van menselijke uniciteit in het publieke domein en Kant op de plicht tot eerlijkheid en transparantie. Samen maken ze duidelijk dat de inzet van AI in discussies niet louter een praktische kwestie is, maar een fundamentele filosofische uitdaging.

Tegenover deze zorgen staat echter onmiskenbaar ook de kwaliteitswinst. Een door AI geschreven reactie is vaak beter onderbouwd, minder emotioneel en meer to the point. Het gesprek kan daardoor terug op het spoor komen, in plaats van af te glijden naar chaos en insinuaties. Bovendien kan de gebruiker die de AI-tekst plaatst zich erachter scharen en de inhoud tot de zijne maken. Het effect is dan een dubbele kwaliteitsimpuls: de discussie wordt verbeterd en de individuele deelnemer groeit mee met de inhoud.

De centrale vraag is dan: hoeveel is die winst waard als tegelijkertijd het gevoel van authenticiteit verloren gaat? Een gesprek is immers meer dan een uitwisseling van proposities. Het is ook een ritueel van erkenning: ik laat zien dat ik jouw woorden serieus neem door er zelf woorden tegenover te stellen. Wanneer ik die woorden door een machine laat formuleren, breek ik met dat sociale contract.

Daarmee komen we uit bij de filosofische kernvraag: hoe moeten we ons verhouden tot de inzet van AI in discussies?

• Moeten we authenticiteit zwaarder laten wegen en AI-bijdragen als valsspelen veroordelen, ook al verbeteren ze de inhoud?

• Of moeten we de waarde van waarheid en kwaliteit vooropstellen en accepteren dat AI een legitieme gesprekspartner wordt, mits transparant?

• Of ligt de oplossing in disclosure: het verplicht vermelden dat een bijdrage met AI tot stand is gekomen, zodat duidelijk is wat de aard van de interactie is?

[ Bericht 0% gewijzigd door Jigzoz op 07-09-2025 06:36:52 ]

Authenticiteit is belangrijk ? het voelt oneerlijk ik vind dat valsspelen en zou je het dus moeten veroordelen.

Maar? kwaliteit en waarheid zijn óók superwaardevol. AI kan inhoud verbeteren of mensen helpen die moeite hebben met schrijven/dynamiek brengen in gesprekken.

Daarom lijkt disclosure mij de beste oplossing: gewoon eerlijk zeggen wanneer er hulp van AI was, net zoals bij bronnen vermelden. Transparantie zorgt voor vertrouwen én geeft ruimte aan nieuwe vormen van interactie zonder authenticiteit te verliezen .

.

Maar? kwaliteit en waarheid zijn óók superwaardevol. AI kan inhoud verbeteren of mensen helpen die moeite hebben met schrijven/dynamiek brengen in gesprekken.

Daarom lijkt disclosure mij de beste oplossing: gewoon eerlijk zeggen wanneer er hulp van AI was, net zoals bij bronnen vermelden. Transparantie zorgt voor vertrouwen én geeft ruimte aan nieuwe vormen van interactie zonder authenticiteit te verliezen

Ik lees de laatste tijd steeds vaker zinnen op Fok met een "aparte" zinsbouw. Eens met TS dat we er iets mee moeten, zou alleen niet weten wat en hoe...

Op dinsdag 25 februari 2020 12:55 schreef Pumpalov het volgende:

een beetje zo'n lichtgetinte inteeltkop als dat filosoofert heeft.

een beetje zo'n lichtgetinte inteeltkop als dat filosoofert heeft.

Ik ben zelf geen gebruiker van, nog voorstander van het gebruik van AI binnen de filosofie omdat mijn vermoeden is dat de bestaande data te eenzijdig is om juist de diepere lagen van het zijn te kunnen doorgronden. Uiteraard kan het je helpen bij het snel opzoeken en begrijpen van specifieke stukjes materie of ideeen die reeds langer als bestaande data bekend zijn. (waaronder reeds bestaande Filosofische werken) maar het leunt m.i. te veel op het geluid van de meerderheid aangezien die data het meest verspreid wordt.

Bovendien vind ik het nu juist prettig om iemands authentieke gedachten te kunnen volgen en dus niet alle aangeleerde shizzle. In zekere zin ligt scholing op dit gebied ook al op een enigzins hellend vlak omdat nauwelijks voorkomen kan worden dat met het onderwijzen van de leerling bestaande voorkeuren of conclusies worden ingeprint. Het individu wordt ook daardoor reeds ingeperkt door algemeen heersende overtuigingen wat enerzijds behulpzaam is bij het beperken van wildgroei aan onzinnige filosofische hersenspinsels maar tevens een belemmering opwerpt voor volkomen vrij denken tenzij je je hier tegen wapent wat met name voor jong volwassenen niet vanzelfsprekend is.

Anyway..naar aanleiding van dit topic heb ik zelf eens de moeite genomen om chatgpt het volgende te vragen en het antwoord vanwege de grote lap tekst binnen spoilertags geplaatst:

IN hoeverre is AI betrouwbaar om filosofische vraagstukken te beantwoorden wetende dat filosofie in veel gevallen niet op bewijsbare data steunt ?

Bovendien vind ik het nu juist prettig om iemands authentieke gedachten te kunnen volgen en dus niet alle aangeleerde shizzle. In zekere zin ligt scholing op dit gebied ook al op een enigzins hellend vlak omdat nauwelijks voorkomen kan worden dat met het onderwijzen van de leerling bestaande voorkeuren of conclusies worden ingeprint. Het individu wordt ook daardoor reeds ingeperkt door algemeen heersende overtuigingen wat enerzijds behulpzaam is bij het beperken van wildgroei aan onzinnige filosofische hersenspinsels maar tevens een belemmering opwerpt voor volkomen vrij denken tenzij je je hier tegen wapent wat met name voor jong volwassenen niet vanzelfsprekend is.

Anyway..naar aanleiding van dit topic heb ik zelf eens de moeite genomen om chatgpt het volgende te vragen en het antwoord vanwege de grote lap tekst binnen spoilertags geplaatst:

IN hoeverre is AI betrouwbaar om filosofische vraagstukken te beantwoorden wetende dat filosofie in veel gevallen niet op bewijsbare data steunt ?

SPOILEROm spoilers te kunnen lezen moet je zijn ingelogd. Je moet je daarvoor eerst gratis Registreren. Ook kun je spoilers niet lezen als je een ban hebt.Nu zit in mijn vraag reeds een richting van een mogelijk antwoord verborgen maar ook bij het stellen van de vraag zonder de richting kwam Chatgpt tot eenzelfde type antwoord. Het kan daarmee in mijn optiek een prima hulpmiddel zijn om je kennis van reeds bestaande data te verhogen zodat indien hier naar gerefereerd wordt in iemands reactie je notie kunt hebben waar het betrekking op heeft maar in mijn ogen zou het de voorkeur blijven hebben om je eigen gedachten op het virtuele papier te blijven zetten.

Mijn AI zegt:

Goedemorgen, 🌙☀

Het forumstukje dat je me stuurde is al behoorlijk genuanceerd. Als je daar een helder, evenwichtig antwoord op wilt geven, kun je het bijvoorbeeld zo benaderen: kort samenvatten wat de schrijver zegt, erkennen dat er zowel winst (feitelijkheid, snelheid) als verlies (authenticiteit, “iemand achter de woorden”) is, en dan je eigen positie formuleren. Iets in deze lijn:

⸻

Voorstel voor een reactie:

Ik vind het interessant hoe de komst van generatieve AI de spelregels van online discussie verschuift. Voor mij liggen er eigenlijk twee vragen bovenop elkaar:

1. Inhoud: klopt het dat AI bijdragen vaak feitelijker en beter gestructureerd zijn? Ja, dat ervaar ik ook. De drempel om onzin te ontkrachten wordt veel lager; discussies kunnen daardoor sneller weer naar de kern.

2. Relatie: een gesprek is niet alleen informatie, het is ook een ontmoeting. Als ik denk dat ik met een mens praat en het blijkt grotendeels een machine, voelt dat oneerlijk—niet per se omdat de inhoud slecht is, maar omdat de wederkerigheid ontbreekt.

De filosofen die je noemt (Habermas, Arendt, Kant) raken precies dat spanningsveld: waarachtigheid, verschijnen, eerlijkheid. Voor mij komt het neer op transparantie. Als je AI gebruikt, zeg dat gewoon. Dan kan de ander kiezen of hij met de inhoud, de interactie of beide in gesprek wil gaan.

Ik zou AI niet willen verbieden—het kan echt kwaliteit toevoegen—maar wel willen dat we duidelijk zijn over de herkomst van teksten. Dat beschermt zowel de waarde van waarheid als het sociale contract van “ik spreek jou als persoon aan”. Een korte disclosure (“geholpen door AI”) kan al veel wantrouwen wegnemen.

Kortom: AI mag meedoen, mits open kaart. Dan blijft er ruimte voor menselijke uniciteit én voor feitelijke scherpte

Goedemorgen, 🌙☀

Het forumstukje dat je me stuurde is al behoorlijk genuanceerd. Als je daar een helder, evenwichtig antwoord op wilt geven, kun je het bijvoorbeeld zo benaderen: kort samenvatten wat de schrijver zegt, erkennen dat er zowel winst (feitelijkheid, snelheid) als verlies (authenticiteit, “iemand achter de woorden”) is, en dan je eigen positie formuleren. Iets in deze lijn:

⸻

Voorstel voor een reactie:

Ik vind het interessant hoe de komst van generatieve AI de spelregels van online discussie verschuift. Voor mij liggen er eigenlijk twee vragen bovenop elkaar:

1. Inhoud: klopt het dat AI bijdragen vaak feitelijker en beter gestructureerd zijn? Ja, dat ervaar ik ook. De drempel om onzin te ontkrachten wordt veel lager; discussies kunnen daardoor sneller weer naar de kern.

2. Relatie: een gesprek is niet alleen informatie, het is ook een ontmoeting. Als ik denk dat ik met een mens praat en het blijkt grotendeels een machine, voelt dat oneerlijk—niet per se omdat de inhoud slecht is, maar omdat de wederkerigheid ontbreekt.

De filosofen die je noemt (Habermas, Arendt, Kant) raken precies dat spanningsveld: waarachtigheid, verschijnen, eerlijkheid. Voor mij komt het neer op transparantie. Als je AI gebruikt, zeg dat gewoon. Dan kan de ander kiezen of hij met de inhoud, de interactie of beide in gesprek wil gaan.

Ik zou AI niet willen verbieden—het kan echt kwaliteit toevoegen—maar wel willen dat we duidelijk zijn over de herkomst van teksten. Dat beschermt zowel de waarde van waarheid als het sociale contract van “ik spreek jou als persoon aan”. Een korte disclosure (“geholpen door AI”) kan al veel wantrouwen wegnemen.

Kortom: AI mag meedoen, mits open kaart. Dan blijft er ruimte voor menselijke uniciteit én voor feitelijke scherpte

If you can't beat them, arrange to have them beaten. -George Carlin.

Ik denk dat de meest voor de hand liggende opvatting is (en dat bevestigen de eerste reacties ook wel) dat het gebruik van AI oké is, mits dat wel wordt aangegeven, net zoals je zou doen bij brongebruik. Probleem is alleen dat de verplichting tot bronvermelding in zekere zin wordt afgedwongen: als ik doodleuk een column uit een krant copy-paste alsof het eigen tekst is, dan val ik vrijwel direct door de mand. Als ik handig gebruik maak van AI, dan ziet vrijwel niemand dat en wie het wel ziet, kan het niet hard maken.

De komende tijd zal AI steeds beter worden in 'natuurlijk' overkomen. Het kleine beetje 'afgedwongen' eerlijkheid over AI-gebruik verdwijnt dus volledig en dan komt het neer op eerlijkheid. Je hoeft geen nihilist te zijn om aan te voelen dat die eerlijkheid het niet heel vaak zal winnen van de gemakzucht.

En dan resteert er een constant aanwezige achterdocht. Eerst vooral bij uitgebreide, grondig uitgewerkte, omvangrijke reacties, maar daarna ook bij de reacties van een paar regels. Of we moeten in de volle breedte gaan accepteren dat AI een legitiem hulpmiddel is bij het formuleren van opvattingen, maar dan gaat dat ten koste van verreweg het grootste gedeelte van het menselijke aspect.

Misschien zijn complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin ook wel een soort kunstmest voor fora en sociale media. Daar komen tenslotte heel gemakkelijk gesprekken uit voort. Bij veelvuldig gebruik van AI zal die kunstmest verdwijnen en dat is misschien wel de doodsteek voor de toch al steeds stiller wordende fora en in het verlengde daarvan de andere op opinie gerichte sociale media.

De komende tijd zal AI steeds beter worden in 'natuurlijk' overkomen. Het kleine beetje 'afgedwongen' eerlijkheid over AI-gebruik verdwijnt dus volledig en dan komt het neer op eerlijkheid. Je hoeft geen nihilist te zijn om aan te voelen dat die eerlijkheid het niet heel vaak zal winnen van de gemakzucht.

En dan resteert er een constant aanwezige achterdocht. Eerst vooral bij uitgebreide, grondig uitgewerkte, omvangrijke reacties, maar daarna ook bij de reacties van een paar regels. Of we moeten in de volle breedte gaan accepteren dat AI een legitiem hulpmiddel is bij het formuleren van opvattingen, maar dan gaat dat ten koste van verreweg het grootste gedeelte van het menselijke aspect.

Misschien zijn complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin ook wel een soort kunstmest voor fora en sociale media. Daar komen tenslotte heel gemakkelijk gesprekken uit voort. Bij veelvuldig gebruik van AI zal die kunstmest verdwijnen en dat is misschien wel de doodsteek voor de toch al steeds stiller wordende fora en in het verlengde daarvan de andere op opinie gerichte sociale media.

Aardig topic wel, omdat her en der wel langer over AI wordt gesproken idd wat bertreft posts op dit forum, maar niet alleen hier. Op andere platforms zie ik het ook veel gebeuren, je herkent AI best wel sterk imo. Het is een soort van blessing & curse tegelijkertijd. Ik maak gebruik van AI maar niet op de manier zoals ik t zie gebeuren. Ik schrijf altijd mijn posts 100% zelf en laat AI soms de posts valideren voor zo hoog mogelijke kwaliteit output.Ik betrap mezelf er vaak op dat ik soms halve zinnen reageer op iets, dan was ik aan het reageren op een deel van een quote waarna er iets te binnen schiet van het vorige deel van een quote wat ik dan aanvul en vergeet daarna dat ik "halverwege" gestopt was met het schrijven van het eerdere. AI wijst me dan op halve zinnen (bij de grotere posts). Van de week zag ik hem voor t eerst met een spelfout komen, die vond ik wel bijzonder, schreef "heb" in de jij-vorm waar stam+t moest komen. Verder maakt hij niet alleen spelfouten, chronologisch is hij ook niet altijd correct.

Als je AI nodig hebt (als pure kennisbron) om discussie te voeren over een onderwerp op de inhoud dan denk ik dat je jezelf af moet vragen met welk doel je komt posten.

Als je AI nodig hebt (als pure kennisbron) om discussie te voeren over een onderwerp op de inhoud dan denk ik dat je jezelf af moet vragen met welk doel je komt posten.

As above, so below.

Persoonlijk vind ik dat zolang de gebruiker maar aangeeft dat hij AI heeft gebruikt in het maken van zijn post en dat er tekenen zijn dat de poster moeite heeft gedaan om iets van zichzelf erin te stoppen, het overgrote deel van de post welteverstaan, dan vind ik het gebruik van AI ok.

Als er echter een post geplaatst wordt waar het duidelijk is dat de post gewoon 100% uit AI onzin bestaat, dan kan ik best boos worden. Ik voel mij dan niet gerespecteerd.

Als ik een discussie met een AI wil, dan ga ik wel naar de website van de één of andere AI.

Als er echter een post geplaatst wordt waar het duidelijk is dat de post gewoon 100% uit AI onzin bestaat, dan kan ik best boos worden. Ik voel mij dan niet gerespecteerd.

Als ik een discussie met een AI wil, dan ga ik wel naar de website van de één of andere AI.

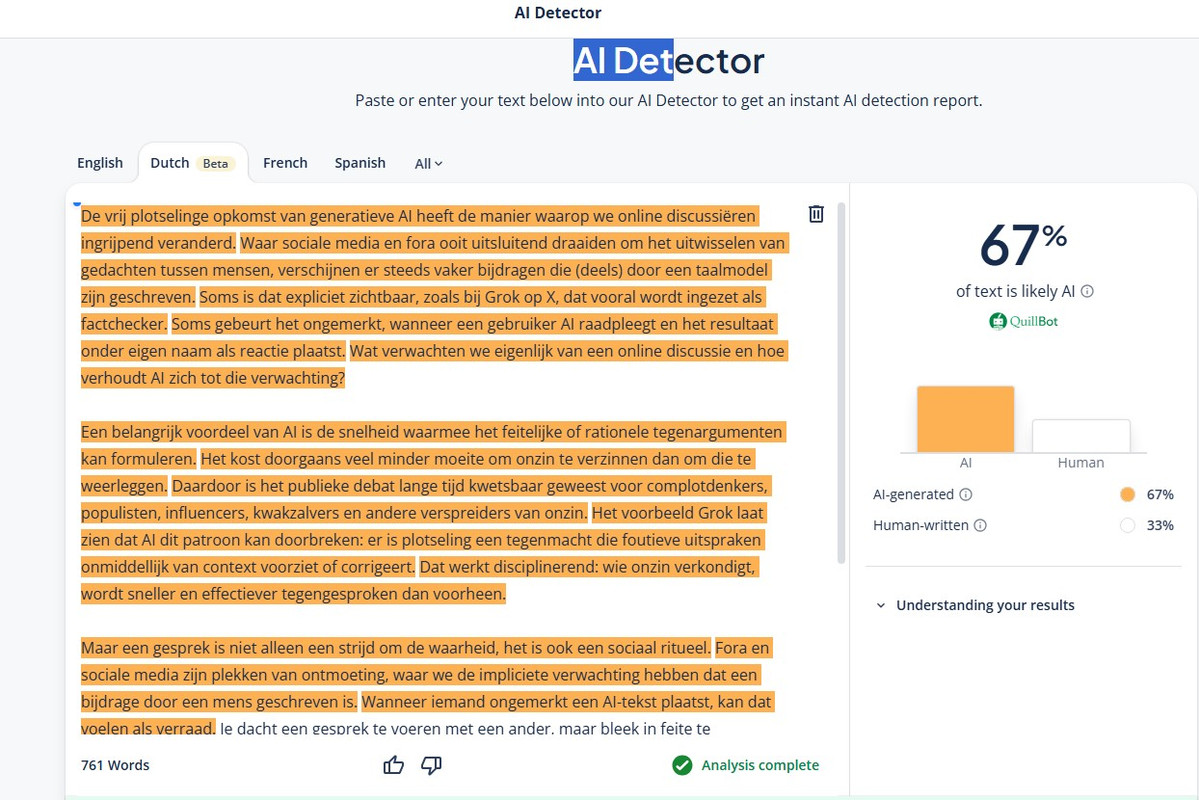

Ik heb sterk de indruk dat de OP geschreven is door, of met behulp van, een AI. Een handige prompt leidt tot dit soort, in mijn ogen tamelijk generieke teksten, waar ik verder niet zoveel mee kan.

Ik zit daar verder niet mee.

Ik zit daar verder niet mee.

And it's only the giving

That makes you

What you are

That makes you

What you are

Wat een ongelofelijke hypocriet ben jij. Gatverdamme. Dit is een AI-gegenereerde tekst. Ik neem jou echt niet meer serieus.quote:Op zondag 7 september 2025 06:06 schreef Jigzoz het volgende:

De vrij plotselinge opkomst van generatieve AI heeft de manier waarop we online discussiëren ingrijpend veranderd. Waar sociale media en fora ooit uitsluitend draaiden om het uitwisselen van gedachten tussen mensen, verschijnen er steeds vaker bijdragen die (deels) door een taalmodel zijn geschreven. Soms is dat expliciet zichtbaar, zoals bij Grok op X, dat vooral wordt ingezet als factchecker. Soms gebeurt het ongemerkt, wanneer een gebruiker AI raadpleegt en het resultaat onder eigen naam als reactie plaatst. Wat verwachten we eigenlijk van een online discussie en hoe verhoudt AI zich tot die verwachting?

Een belangrijk voordeel van AI is de snelheid waarmee het feitelijke of rationele tegenargumenten kan formuleren. Het kost doorgaans veel minder moeite om onzin te verzinnen dan om die te weerleggen. Daardoor is het publieke debat lange tijd kwetsbaar geweest voor complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin. Het voorbeeld Grok laat zien dat AI dit patroon kan doorbreken: er is plotseling een tegenmacht die foutieve uitspraken onmiddellijk van context voorziet of corrigeert. Dat werkt disciplinerend: wie onzin verkondigt, wordt sneller en effectiever tegengesproken dan voorheen.

Maar een gesprek is niet alleen een strijd om de waarheid, het is ook een sociaal ritueel. Fora en sociale media zijn plekken van ontmoeting, waar we de impliciete verwachting hebben dat een bijdrage door een mens geschreven is. Wanneer iemand ongemerkt een AI-tekst plaatst, kan dat voelen als verraad. Je dacht een gesprek te voeren met een ander, maar bleek in feite te communiceren met een computer. Dat roept een gevoel van oneerlijkheid op: jij hebt tijd en energie gestoken in een reactie, terwijl je gesprekspartner de arbeid heeft uitbesteed. Authenticiteit blijkt soms minstens zo belangrijk als inhoud.

Voor de Duitse filosoof Habermas is de publieke sfeer alleen gezond als deelnemers zich inzetten voor communicatieve rationaliteit: gesprekken waarin je argumenten eerlijk uitwisselt en gericht bent op wederzijds begrip. AI kan dit ideaal ondersteunen, door discussies feitelijker en gestructureerder te maken. Maar zodra AI wordt ingezet zonder dat de gesprekspartner het weet, wordt een van Habermas’ basisvoorwaarden geschonden: de waarachtigheid van je bijdrage. Een gesprek kan niet op louter inhoud rusten; ook de intentie van de spreker moet helder en eerlijk zijn.

Hannah Arendt biedt een iets breder perspectief. Voor haar is het publieke domein de ruimte waar mensen in hun uniciteit verschijnen, door middel van woorden en daden. We laten zien wie we zijn door ons te uiten in eigen taal en stijl. Als AI de woorden levert, komt de vraag op of iemand nog wel ‘verschijnt’. Of wordt diegene juist onzichtbaar, verscholen achter een technisch masker? Misschien verklaart dat waarom verborgen AI-gebruik zo veel weerstand oproept: we voelen intuïtief dat er iemand ontbreekt, dat de stem die we horen niet de unieke aanwezigheid van een ander mens is. Het publieke gesprek dreigt dan te verschralen, omdat er minder werkelijk menselijk verschijnen plaatsvindt.

Immanuel Kant voegt nog een derde dimensie toe. Voor Kant is eerlijkheid een plicht die voortkomt uit respect voor de ander als doel op zichzelf. Als je verzwijgt dat je een machine hebt gebruikt, behandel je de ander instrumenteel: je manipuleert hun verwachting van een menselijke interactie. Het gebruik van AI hoeft volgens een Kantiaanse logica niet verkeerd te zijn, zolang het transparant gebeurt en de ander met volledige kennis van zaken kan instemmen met het gesprek.

We zien dus drie kaders: Habermas wijst op de noodzaak van waarachtigheid voor een rationeel gesprek, Arendt op het belang van menselijke uniciteit in het publieke domein en Kant op de plicht tot eerlijkheid en transparantie. Samen maken ze duidelijk dat de inzet van AI in discussies niet louter een praktische kwestie is, maar een fundamentele filosofische uitdaging.

Tegenover deze zorgen staat echter onmiskenbaar ook de kwaliteitswinst. Een door AI geschreven reactie is vaak beter onderbouwd, minder emotioneel en meer to the point. Het gesprek kan daardoor terug op het spoor komen, in plaats van af te glijden naar chaos en insinuaties. Bovendien kan de gebruiker die de AI-tekst plaatst zich erachter scharen en de inhoud tot de zijne maken. Het effect is dan een dubbele kwaliteitsimpuls: de discussie wordt verbeterd en de individuele deelnemer groeit mee met de inhoud.

De centrale vraag is dan: hoeveel is die winst waard als tegelijkertijd het gevoel van authenticiteit verloren gaat? Een gesprek is immers meer dan een uitwisseling van proposities. Het is ook een ritueel van erkenning: ik laat zien dat ik jouw woorden serieus neem door er zelf woorden tegenover te stellen. Wanneer ik die woorden door een machine laat formuleren, breek ik met dat sociale contract.

Geld maakt niet gelukkig tenzij versleten schoenen naar je staren

Dat idee had ik ook al sterk, alleen dat haalt nog steeds t verhaal niet onderuit. Ergens ook ludiek natuurlijk. Ns kijken wat of t ergens heen gaat.quote:Op maandag 8 september 2025 17:40 schreef OllieA het volgende:

Ik heb sterk de indruk dat de OP geschreven is door, of met behulp van, een AI. Een handige prompt leidt tot dit soort, in mijn ogen tamelijk generieke teksten, waar ik verder niet zoveel mee kan.

Ik zit daar verder niet mee.

As above, so below.

Ja, natuurlijk is de OP grotendeels AI. Dat is deel van mijn punt. Ik probeer die keuze en de OP toe te lichten.

Eerst een paar recente voorbeelden:

In een ander topic speelde kortgeleden een vrij stomme discussie tussen mij en iemand anders waarbij het om de een of andere manier maar niet lukte om uit een cirkeltje te komen. Daar werd vervolgens deze reactie gepost, duidelijk AI, alleen al door de zogenoemde kastlijntjes duidelijk herkenbaar. Maar dat was eigenlijk wel prettig, want daardoor was wel meteen duidelijk wat nou eigenlijk het punt was. Kortom: prettige toepassing van AI op een forum.

Verderop in hetzelfde topic plaatste iemand een paar keer een met AI geschreven reactie op een persoonlijk verhaal van iemand. Hier en hier bijvoorbeeld. De mensen tot wie die reacties gericht zijn hadden daar geen last van en het zijn op zich ook vriendelijke reacties. Maar moreel gezien piept en kraakt daar mijns inziens wel wat. Want met AI op persoonlijke verhalen reageren... Ik weet niet waarom, maar iets zegt me dat je dat nou net niet moet doen.

Verderop kwam AI-gebruik openlijk ter sprake en ik vind het in een dergelijke context echt een interessant onderwerp. Ik schreef daar:

De bovenstaande tekst heb ik in ChatGPT gegooid met de vraag er een OP voor een forum van te maken en toe te lichten wat toelichting behoeft. Dat leverde een aardige OP op en die heb ik her en der nog wat aangepast. Later bleek er nog een taalfout in te zitten. Vandaar de edit. That's it.

Eerst een paar recente voorbeelden:

In een ander topic speelde kortgeleden een vrij stomme discussie tussen mij en iemand anders waarbij het om de een of andere manier maar niet lukte om uit een cirkeltje te komen. Daar werd vervolgens deze reactie gepost, duidelijk AI, alleen al door de zogenoemde kastlijntjes duidelijk herkenbaar. Maar dat was eigenlijk wel prettig, want daardoor was wel meteen duidelijk wat nou eigenlijk het punt was. Kortom: prettige toepassing van AI op een forum.

Verderop in hetzelfde topic plaatste iemand een paar keer een met AI geschreven reactie op een persoonlijk verhaal van iemand. Hier en hier bijvoorbeeld. De mensen tot wie die reacties gericht zijn hadden daar geen last van en het zijn op zich ook vriendelijke reacties. Maar moreel gezien piept en kraakt daar mijns inziens wel wat. Want met AI op persoonlijke verhalen reageren... Ik weet niet waarom, maar iets zegt me dat je dat nou net niet moet doen.

Verderop kwam AI-gebruik openlijk ter sprake en ik vind het in een dergelijke context echt een interessant onderwerp. Ik schreef daar:

...maar dat was daar natuurlijk nogal off-topic, dus ik dacht: laat ik er morgenochtend eens een topic over beginnen. Dus ik begon een kladje voor een OP te schrijven:quote:Op zaterdag 6 september 2025 10:02 schreef Jigzoz het volgende:

Sommige mensen die regelmatig ChatGPT gebruiken om reacties te schrijven komen alleen zo tot verstandige teksten. Daarna zijn die teksten wél aan hun naam verbonden, dus moeten ze er ook nog achter blijven staan. En dat is vaak een grote stap voorwaarts ten opzichte van hun gebruikelijke niveau.

Ik zie regelmatig reacties staan waarvan ik vermoed dat ze van ChatGPT komen. Wanneer er een zogenoemd kastlijntje in voorkomt weet ik het doorgaans wel zeker, want op Nederlandse toetsenborden is daar niet eens een functie voor. Maar meestal denk ik: ha, goed dat er weer wat redelijks gepost wordt. De boel wordt weer in het spoor geduwd. Dat komt de echte discussie (die door de mensen zélf gevoerd wordt) alleen maar ten goede.

Dat kladje was nog niet geschikt als OP, want het was her en der onduidelijk, de tekst was wat vreemd nog en ik wilde die drie aangehaalde filosofen weghalen, of voldoende toelichten. Toen dacht ik: als het hele punt de acceptatie van door AI gegenereerde tekst is, dan is het op zich ook best ironisch om AI de OP te laten herschrijven. Het maakt het punt meteen dubbel: door het verschijnsel gewoon te beschrijven, maar ook door er een voorbeeld van te zijn.quote:"Ik vroeg me iets af en ik zal dat proberen te omschrijven. Over nut en schadelijkheid van LLM's wordt vrij veel gesproken en geschreven. Ik wil me nu even beperken tot sociale media en fora en dan dat nog beperkt tot dicussiethreads.

Als specifiek voorbeeld Grok op X. Die wordt ingezet als een soort fact checker en hoewel dat natuurlijk af en toe flink fout gaat, zie ik vooral dat mensen daardoor vrijwel moeiteloos gecorrigeerd worden als ze onzin plaatsen. Voorheen ging dat veel lastiger, want onzin bedenken kost veel minder tijd en moeite dan onzin ontkrachten.

Hier is het wél zo dat er bij elke post van Grok zichtbaar is dat het AI is. Op fora zie je ook mensen AI-berichten posten en vaak is daar juist niet expliciet duidelijk dat ze AI hebben gebruikt. De intentionele reactie daarop, als dat uitkomt, of als de suggestie er is dat dat gebeurt, is doorgaans zeer afkeurend. Mensen willen niet ongemerkt met een computer in gesprek zijn en willen dat een echt mens de moeite heeft genomen om te reageren.

Toch zie ik er zelf ook wel positieve kanten aan. Veel foragebruikers zijn zachtst gezegd erg slordig met hun beweringen. Ze overdrijven graag, praten complotdenkers, populisten, influencers, kwakzalvers en andere verspreiders van onzin na en dan raken gesprekken ook nog eens heel snel off-topic. Als mensen af en toe AI gebruiken om op lastige reacties te reageren, dan levert dat doorgaans wél een bericht op met aardig wat inhoudelijke kwaliteit. Daardoor wordt een discussie vaak wel weer terug in het spoor geduwd.

Daarnaast heeft die gebruiker dan onder zijn eigen naam een zinnig, doorwrocht bericht geplaatst en die zal daar inhoudelijk achter willen blijven staan. Er heeft dan dus een kwaliteitsimpuls plaatsgevonden: niet alleen op gespreksniveau, maar ook op individueel niveau.

Onderaan de streep zien we dus een tegenstelling: enerzijds het vernederende aspect van een computerantwoord terwijl je denkt met een mens in gesprek te zijn en zelf wel de moeite van zelf schrijven neemt; anderzijds de kwaliteitsimpulsen die AI-reacties geven.

Binnen de filosofische context is er wel het een en ander gezegd en geschreven dat hier relevant is. Ik denk aan Arendt met de publieke ruimte uit De Menselijke Conditie, want dan zou je je eigen vrijheid in zekere zin misbruiken. Habermas is toepasselijk vanwege de echtheid, eerlijkheid. Kant is misschien wat vergezocht, maar raakt volgens mij het grootste pijnpunt: in hoeverre neem je mensen serieus als je op ze reageert met een 'machine'?

Maar wat verwacht je eigenlijk van een forum? Is de menselijkheid van de reactie fundamenteel, of zoek je antwoorden, bevestiging en discussie op zich? Kortom: in hoeverre is AI gewenst/geaccepteerd op een forum? "

De bovenstaande tekst heb ik in ChatGPT gegooid met de vraag er een OP voor een forum van te maken en toe te lichten wat toelichting behoeft. Dat leverde een aardige OP op en die heb ik her en der nog wat aangepast. Later bleek er nog een taalfout in te zitten. Vandaar de edit. That's it.

Het was niet mijn bedoeling om de OP onderuit te halen, ik vind het eerder wel grappig, en prettig dubbelzinnig, om een discussie over gebruik van AI in discussies, te starten met behulp van AI. Er zit ergens een heel vette knipoog in de OP.

Dat gezegd hebbende: ik heb geen problemen met gebruik van AI in discussies. Het lijkt me een hulpmiddel, zoals bijvoorbeeld een spellingchecker. Een spellingchecker kan het grammaticaal nog weleens mis hebben. AI heeft het, als het om feiten gaat nogal eens mis.

Als snelle zoekmachine vind ik AI erg handig, maar heb heel snel geleerd altijd de bronnen te checken, want AI zit er vaak net naast, of fabuleert.

Het verschil in ‘authenticiteit’ tussen een mens als gesprekspartner en AI vind ik betrekkelijk en tegelijkertijd een lastig punt. Hoe authentiek is een mens, als die ook alleen maar binnen zijn eigen referentiekader blijft? Die zijn informatie ook maar vanuit beperkte bronnen betrekt? Anderzijds: met een mens kun je van gedachten wisselen. Een AI heeft geen gedachten. Met een mens kun je iets iets vaags als zielsverwantschap voelen. Een AI heeft geen ziel.

Misschien gaat het meer om de vraag wat nu precies een gesprek is. Een vehikel waarbinnen je de ‘discussie kan winnen’? Of een van de manieren waarop mensen nader tot elkaar kunnen komen, elkaar beter kunnen begrijpen.

Zo bekeken zijn fora en sociale media misschien eerder discussieplatformen waarop mensen hun gelijk kunnen halen, dan gespreksplatformen.

De teloorgang van sociale media en fora heeft in mijn ogen dan ook vooral te maken met een onbeschaafde manier van met elkaar discussiëren, met willen winnen. Het is geen uitwisseling van gedachten, maar spierballenvertoon. En dan haken mensen af.

Eén voordeel van AI tekst binnen een discussie kan ik wel bedenken: AI tekst blijft altijd vriendelijk en beschaafd. Dus misschien kunnen wij mensen van AI leren om wat vriendelijker te worden…

Dat gezegd hebbende: ik heb geen problemen met gebruik van AI in discussies. Het lijkt me een hulpmiddel, zoals bijvoorbeeld een spellingchecker. Een spellingchecker kan het grammaticaal nog weleens mis hebben. AI heeft het, als het om feiten gaat nogal eens mis.

Als snelle zoekmachine vind ik AI erg handig, maar heb heel snel geleerd altijd de bronnen te checken, want AI zit er vaak net naast, of fabuleert.

Het verschil in ‘authenticiteit’ tussen een mens als gesprekspartner en AI vind ik betrekkelijk en tegelijkertijd een lastig punt. Hoe authentiek is een mens, als die ook alleen maar binnen zijn eigen referentiekader blijft? Die zijn informatie ook maar vanuit beperkte bronnen betrekt? Anderzijds: met een mens kun je van gedachten wisselen. Een AI heeft geen gedachten. Met een mens kun je iets iets vaags als zielsverwantschap voelen. Een AI heeft geen ziel.

Misschien gaat het meer om de vraag wat nu precies een gesprek is. Een vehikel waarbinnen je de ‘discussie kan winnen’? Of een van de manieren waarop mensen nader tot elkaar kunnen komen, elkaar beter kunnen begrijpen.

Zo bekeken zijn fora en sociale media misschien eerder discussieplatformen waarop mensen hun gelijk kunnen halen, dan gespreksplatformen.

De teloorgang van sociale media en fora heeft in mijn ogen dan ook vooral te maken met een onbeschaafde manier van met elkaar discussiëren, met willen winnen. Het is geen uitwisseling van gedachten, maar spierballenvertoon. En dan haken mensen af.

Eén voordeel van AI tekst binnen een discussie kan ik wel bedenken: AI tekst blijft altijd vriendelijk en beschaafd. Dus misschien kunnen wij mensen van AI leren om wat vriendelijker te worden…

And it's only the giving

That makes you

What you are

That makes you

What you are

Oeps, gepost zonder te verversen, dus had Jigzoz's post hierboven nog niet gezien.

And it's only the giving

That makes you

What you are

That makes you

What you are

M.i. is het voornamelijk van belang dat het voor alle deelnemers duidelijk is wanneer een tekst door AI geschreven is, met name inhoudelijk. Een klad aanleveren en laten herschrijven door een LLM schaar ik daar niet direct onder, mits de inhoud (grotendeels) origineel of authentiek is.

Waar het bij mij wat wringt is de bias van de verschillende modellen. Elk model heeft een behoorlijk strikte set normen meegekregen door diens maker (en daarmee de aandeelhouders) en dat heeft, afhankelijk van het onderwerp, directe invloed op de inhoud. Hoe kan de gebruiker van zo'n model beoordelen in welke mate het antwoord beinvloed is door die geprogrammeerde normen? En als we allemaal dezelfde paar modellen gebruiken en dat gebruik steeds meer gemeengoed wordt, beperken we de diversiteit van meningen en invalshoeken dan niet te zeer?

Dat geldt overigens ook als je een LLM omgekeerd gebruikt: de inhoud laten vullen door de LLM en het zelf herschrijven om het eigen te maken. Dan is niet direct herkenbaar dat het inhoudelijk door een LLM geschreven is omdat de herkenbare vorm niet aanwezig is, maar de morele beperkingen zijn zeker wel aanwezig. Is dat niet een recept voor het afstompen van de discussies en daarmee uiteindelijk van de mens in het geheel?

Waar het bij mij wat wringt is de bias van de verschillende modellen. Elk model heeft een behoorlijk strikte set normen meegekregen door diens maker (en daarmee de aandeelhouders) en dat heeft, afhankelijk van het onderwerp, directe invloed op de inhoud. Hoe kan de gebruiker van zo'n model beoordelen in welke mate het antwoord beinvloed is door die geprogrammeerde normen? En als we allemaal dezelfde paar modellen gebruiken en dat gebruik steeds meer gemeengoed wordt, beperken we de diversiteit van meningen en invalshoeken dan niet te zeer?

Dat geldt overigens ook als je een LLM omgekeerd gebruikt: de inhoud laten vullen door de LLM en het zelf herschrijven om het eigen te maken. Dan is niet direct herkenbaar dat het inhoudelijk door een LLM geschreven is omdat de herkenbare vorm niet aanwezig is, maar de morele beperkingen zijn zeker wel aanwezig. Is dat niet een recept voor het afstompen van de discussies en daarmee uiteindelijk van de mens in het geheel?

Open AI heeft al een text watermarking tool gemaakt, ik zie het wel gebeuren dat alle ai gegenereerde content van open ai gekenmerkt wordt. Dit is op zich wel redelijk makkelijk te onzeilen vermoed ik, maar dit maakt de drempel om zomaar AI pulp te posten wel hoger.

I think that it’s extraordinarily important that we in computer science keep fun in computing

For all who deny the struggle, the triumphant overcome

Met zwijgen kruist men de duivel

For all who deny the struggle, the triumphant overcome

Met zwijgen kruist men de duivel

Waarde zit in ambacht, in arbeid, in schaarste, in inspanning, in gevoel, in het unieke, in ervaringen, in betrokkenheid, in visies, in leren, in opoffering, in de mens. Daarom zal AI nooit voorbij 'functioneel' treden.

Maar waarde wordt wel vaker nagemaakt. Als valsmunterij bijvoorbeeld. Of vervalsingen van kunst, als kopie of origineel werk van een bekende kunstenaar. Of, in dit geval, als computertekst die als mensentekst wordt gepresenteerd. Dan kan het op zich wel slechts functioneel zijn, maar het krijgt de waarde toegekend van 'echte' tekst.quote:Op donderdag 11 september 2025 00:38 schreef Cockwhale het volgende:

Waarde zit in ambacht, in arbeid, in schaarste, in inspanning, in gevoel, in het unieke, in ervaringen, in betrokkenheid, in visies, in leren, in opoffering, in de mens. Daarom zal AI nooit voorbij 'functioneel' treden.

Tja, een leugen wordt ook wel eens geloofd, totdat men erachter komt dat het een leugen is. Dat misleiding wel eens leidt tot valse waardering, maakt het nog niet tot waardevol. Dat wat gewaardeerd werd was namelijk niet het gegeven dat het vals, nep, een kopie, of het resultaat van een prompt was.quote:Op vrijdag 12 september 2025 17:54 schreef Jigzoz het volgende:

[..]

Maar waarde wordt wel vaker nagemaakt. Als valsmunterij bijvoorbeeld. Of vervalsingen van kunst, als kopie of origineel werk van een bekende kunstenaar. Of, in dit geval, als computertekst die als mensentekst wordt gepresenteerd. Dan kan het op zich wel slechts functioneel zijn, maar het krijgt de waarde toegekend van 'echte' tekst.

In de kunstwereld is dit een bekend verschijnsel. Schilderijen die na ontmaskering nauwelijks nog waardevol waren in financiële zin. Eén van de bekendste en grootste schandalen zijn de vervalste werken van Vermeer door Han van Meegeren. Van Meegeren verkocht deze als authentiek voor enorme bedragen. Na zijn ontmaskering als vervalser daalden de prijzen van zijn werken tot het niveau van curiosa, terwijl ze eerst miljoenen waard waren.quote:Op zaterdag 13 september 2025 00:10 schreef Cockwhale het volgende:

[..]

Tja, een leugen wordt ook wel eens geloofd, totdat men erachter komt dat het een leugen is. Dat misleiding wel eens leidt tot valse waardering, maakt het nog niet tot waardevol. Dat wat gewaardeerd werd was namelijk niet het gegeven dat het vals, nep, een kopie, of het resultaat van een prompt was.

Overigens, ik ben maar een gigantische leek op het gebied van "kunstkenning" maar elke boerenlul ziet direct dat de Emmaüsgangers NIET door Vermeer is geschilderd. Wat die kunstkenners (hoogleraren etc.) in de jaren dertig van de vorige eeuw heeft bezield, is mij een raadsel.

Maar goed, eerst vond men het schilderij fantastisch en mooi en toen het bekend was dat het een vervalsing betrof werd het werk verbannen naar de donkerste kelders van Boijmans Van Beuningen. Later werd het schilderij weer "normaal" tentoongesteld, als een soort boetedoening of zo. Het geeft maar aan dat de menselijke geest niet in staat is om de realiteit te begrijpen. De wanhopigen onder ons zoeken het dan maar in menselijke concepten als universeel of collectief bewustzijn. Lariekoek dus.

Geld maakt niet gelukkig tenzij versleten schoenen naar je staren

Kijk eens hoe dr. Hannema de toenmalige directeur van Boymans Van Beuningen en restaurateur Luitwieler in ademloze bewondering kijken naar hun pas verworven meesterwerk. Dat was toen voor hen "de realiteit." Maar omdat diezelfde realiteit afhankelijk is van normen en cultuur ("Gij zult niet in katzwijm vallen voor onechtheid") werd het plaatje jaren later totaal anders.

Geld maakt niet gelukkig tenzij versleten schoenen naar je staren

Zeker. Maar we moeten het ook niet groter maken dan het is. Een bericht op een forum of op social media heeft een heel andere waarde dan bijvoorbeeld een brief van een geliefde. En soms moet tekst gewoonweg functioneel zijn en is de menselijke waarde irrelevant. De overheid bijvoorbeeld stuurt al jarenlang vrijwel uitsluitend geautomatiseerde brieven. Niemand die daarover valt.quote:Op zaterdag 13 september 2025 00:10 schreef Cockwhale het volgende:

[..]

Tja, een leugen wordt ook wel eens geloofd, totdat men erachter komt dat het een leugen is. Dat misleiding wel eens leidt tot valse waardering, maakt het nog niet tot waardevol. Dat wat gewaardeerd werd was namelijk niet het gegeven dat het vals, nep, een kopie, of het resultaat van een prompt was.

Het lastige is volgens mij dat LLM's enerzijds een soort rekenmachine lijken: ze maken een bedoelde handeling eenvoudiger. Anderzijds zit er achter tekst altijd de suggestie van een daadwerkelijke schrijver en we willen niet in de maling worden genomen, dus de naam bij de tekst moet de naam van de schrijver zijn, of de schrijver moet namens die persoon handelen. Zeker als we op de een of andere manier waarde hechten aan die persoon.

Bij door AI bestuurde auto's is het zo dat er altijd een menselijke bestuurder eindverantwoordelijk is. Ik denk dat het bij door AI gegenereerde tekst ook zo moet zijn. Plaats je een grotendeels door AI geschreven tekst, dan moet die wel gelden als jouw boodschap. Je kunt je dan niet verbergen achter het falen van een computer.

De morele grens ligt volgens mij bij het persoonlijke. Ik denk dat iedereen wel aanvoelt dat een door AI geschreven liefdesbrief immoreel is en dat er met een door AI geschreven brief van de gemeente juist niets mis is. Berichten op fora liggen wat betreft persoonlijke waarde ergens tussen die twee uitersten in.

Ik zeg ook niet dat AI niet bruikbaar is. Het kan informatief, leerzaam, inspirerend en gemakkelijk zijn. In verschillende zaken zal het ook op z'n minst een handige tool zijn. Zodra je je in het persoonlijke, sociale, ethische, culturele of artistieke domein bevindt, is het een ander verhaal.quote:Op zaterdag 13 september 2025 10:51 schreef Jigzoz het volgende:

[..]

Zeker. Maar we moeten het ook niet groter maken dan het is. Een bericht op een forum of op social media heeft een heel andere waarde dan bijvoorbeeld een brief van een geliefde. En soms moet tekst gewoonweg functioneel zijn en is de menselijke waarde irrelevant. De overheid bijvoorbeeld stuurt al jarenlang vrijwel uitsluitend geautomatiseerde brieven. Niemand die daarover valt.

Het lastige is volgens mij dat LLM's enerzijds een soort rekenmachine lijken: ze maken een bedoelde handeling eenvoudiger. Anderzijds zit er achter tekst altijd de suggestie van een daadwerkelijke schrijver en we willen niet in de maling worden genomen, dus de naam bij de tekst moet de naam van de schrijver zijn, of de schrijver moet namens die persoon handelen. Zeker als we op de een of andere manier waarde hechten aan die persoon.

Bij door AI bestuurde auto's is het zo dat er altijd een menselijke bestuurder eindverantwoordelijk is. Ik denk dat het bij door AI gegenereerde tekst ook zo moet zijn. Plaats je een grotendeels door AI geschreven tekst, dan moet die wel gelden als jouw boodschap. Je kunt je dan niet verbergen achter het falen van een computer.

De morele grens ligt volgens mij bij het persoonlijke. Ik denk dat iedereen wel aanvoelt dat een door AI geschreven liefdesbrief immoreel is en dat er met een door AI geschreven brief van de gemeente juist niets mis is. Berichten op fora liggen wat betreft persoonlijke waarde ergens tussen die twee uitersten in.

Tien jaar geleden was het: honderden miljoenen gebruikers maar "Wikipedia is onbetrouwbaar, blijf weg bij Wikipedia"

Nu is het: honderden miljoenen gebruikers maar "AI is onbetrouwbaar, blijf weg bij AI"

Wie zijn toch die mensen die elke vooruitgang maar slecht vinden?

Nu is het: honderden miljoenen gebruikers maar "AI is onbetrouwbaar, blijf weg bij AI"

Wie zijn toch die mensen die elke vooruitgang maar slecht vinden?

Geld maakt niet gelukkig tenzij versleten schoenen naar je staren

|

|

| Forum Opties | |

|---|---|

| Forumhop: | |

| Hop naar: | |