quote:Op vrijdag 12 juni 2015 11:32 schreef I-care het volgende:

Beste mensen,

Na het zien van deze documentaire over A.I en de eventuele consequenties van A.I kwamen er toch enkel gedachten bovendrijven. Zoals welke voordelen kunnen deze ontwikkelingen hebben voor de mensheid als geheel, en uiteraard ook de geschetste negatieve consequenties zoals bijvoorbeeld het verlies van menselijke autonomie.

Graag zou ik een discussie voeren om eens te kijken hoe men tegenover het concept superintelligentie staat?

In de documentaire worden enkele gedachtelijnen uitgediept, waaronder dat onze technologie ons in snelvaart vooruitstreeft, en de wijsheid mogelijk achterblijft op deze ontwikkelingen. We hebben namelijk amper tijd om deze bij te houden en op verstandige wijze mee te evolueren.

Deze conclusie deel ik dan ook! Vat hebben wij als individu amper meer in de ontwikkeling van technologie an sich, en uitlopend de steeds intelligenter wordende systemen. De vraag is of, en hoe wij als mensen zouden moeten ingrijpen om niet uiteindelijk onder de voeten te worden gelopen door systemen waar wij als mens geen grip meer op hebben.

Ik ben benieuwd naar jullie meningen!

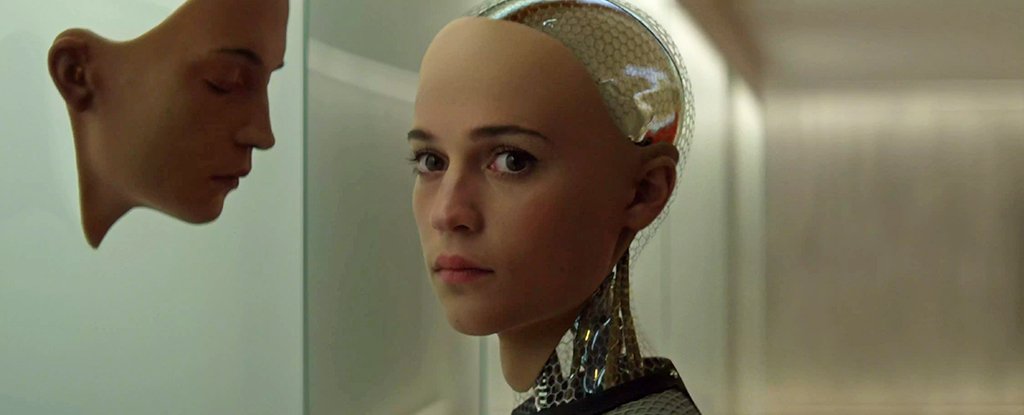

[ afbeelding ]

http://www.npo.nl/de-volmaakte-mens/10-06-2015/VPWON_1231937

Dat sowieso niet, lijkt mij. Hoe flexibel en dynamisch en adaptief die software ook in elkaar zit, het is uiteindelijk toch een deterministisch algoritme. Dat kan best leren en zich ontwikkelen en steeds intelligenter gedrag vertonen, maar dat is dan nog steeds deterministisch.quote:Op donderdag 15 oktober 2015 13:39 schreef I-care het volgende:

En kan het buiten deze deterministische causaliteit handelen?

Overigens kan de mens het volgens mij net zo min. De atomen waarvan organische hersencellen gemaakt zijn, zijn net zo deterministisch als de siliciumatomen van microprocessors.

En al waren ze dat niet: willekeur op de kwantumschaal kan toch moeilijk worden uitgelegd als vrije wil.quote:Op zondag 18 oktober 2015 16:30 schreef lnloggen het volgende:

[..]

Dat sowieso niet, lijkt mij. Hoe flexibel en dynamisch en adaptief die software ook in elkaar zit, het is uiteindelijk toch een deterministisch algoritme. Dat kan best leren en zich ontwikkelen en steeds intelligenter gedrag vertonen, maar dat is dan nog steeds deterministisch.

Overigens kan de mens het volgens mij net zo min. De atomen waarvan organische hersencellen gemaakt zijn, zijn net zo deterministisch als de siliciumatomen van microprocessors.

Ik heb idee dat de vraag "is het universum deterministisch?" relevant is voor de vrij wil altijd een beetje vreemd gevonden.

Het lijkt mij dat iemand met een sterke wil helemaal niet wordt beinvloed door kwantumonbepaaldheden. En als dat wel zou gebeuren dat we dat dan eerder zouden uitleggen als een beperking zijn van zijn vrije wil.

Een 'sterke wil' is het totaal ander begrip dan en 'vrije wil'.quote:Op zondag 18 oktober 2015 16:38 schreef Molurus het volgende:

Het lijkt mij dat iemand met een sterke wil helemaal niet wordt beinvloed door kwantumonbepaaldheden.

Een 'sterke wil' wordt over het algemeen wel gezien als de ultieme expressie van 'vrije wil'. Wanneer iemand, ondanks de omstandigheden, zijn wil doorzet.quote:Op zondag 18 oktober 2015 16:56 schreef deelnemer het volgende:

[..]

Een 'sterke wil' is het totaal ander begrip dan en 'vrije wil'.

Maar toegegeven: die associatie is paradoxaal. In hoeverre kiest iemand ervoor om een sterke wil te hebben?

In die zin is de hele discussie over vrije wil in mijn ogen tamelijk onzinnig.

Als het gaat om dit topic (om te voorkomen dat we afdwalen) denk ik niet dat er een reden is om te veronderstellen dat AI en NI (natural intelligence) op het punt van vrijheid van wil van elkaar verschillen, ongeacht of ze "echt" vrij zijn.

Dat komt omdat het begrip 'vrije wil' vooral deel uitmaakt van een politiek ideologische strijd, waarin het irrelevant is of begrippen zinnig zijn of niet. De beweging die het begrip 'vrije wil' omarmt, bewondert ook mensen die hun wil doordrammen (waar een wil is, is een weg) tenzij ze tot de vijand behoren, want dan is het vooral onjuist.quote:Op zondag 18 oktober 2015 16:59 schreef Molurus het volgende:

Een 'sterke wil' wordt over het algemeen wel gezien als de ultieme expressie van 'vrije wil'. Wanneer iemand, ondanks de omstandigheden, zijn wil doorzet.

Ik denk eigenlijk dat dat verschil een illusie is, en dat menselijke hersenen gewoon nog wat voor lopen op de huidige computers en software (in ontwikkeling en parallelle rekenkracht). Maar dat het een kwestie van tijd is (en niet eens zo heel veel tijd meer) voordat de mens wordt ingehaald.

Er zijn wel andere fundamentele verschillen tussen computers en menselijke hersenen:quote:Op zondag 18 oktober 2015 17:24 schreef lnloggen het volgende:

Men grijpt vaak de zogenaamde "vrije wil" aan als fundamenteel verschil tussen menselijke intelligentie (of menselijk gedrag, of de essentie van mens-zijn) en kunstmatige intelligentie of robots.

Ik denk eigenlijk dat dat verschil een illusie is, en dat menselijke hersenen gewoon nog wat voor lopen op de huidige computers en software (in ontwikkeling en parallelle rekenkracht). Maar dat het een kwestie van tijd is (en niet eens zo heel veel tijd meer) voordat de mens wordt ingehaald.

1) hersenen zijn analoog daar waar (ieg de meeste) computers digitaal zijn.

2) bij computers zijn geheugen en processing grotendeels gescheiden, bij hersenen is dat meer geintegreerd.

3) hersenen hebben redelijk verregaand gespecialiseerde deelgebieden in de hardware. Bij computers is het allemaal redelijk uniform / onbepaald.

En zo zijn er vast nog wel meer.

Inderdaad, vrij zou betekenen vrij kunnen handelen en denken zonder sturing, overtuigingen van allerlei aard en eventuele verlangens die niet geheel vrij in keuze zijn.quote:Op zondag 18 oktober 2015 17:11 schreef deelnemer het volgende:

[..]

Dat komt omdat het begrip 'vrije wil' vooral deel uitmaakt van een politiek ideologische strijd, waarin het irrelevant is of begrippen zinnig zijn of niet. De beweging die het begrip 'vrije wil' omarmt, bewondert ook mensen die hun wil doordrammen (waar een wil is, is een weg) tenzij ze tot de vijand behoren, want dan is het vooral onjuist.

Daaruit beredeneer ik dat vrije wil simpelweg niet bestaat.

Een sterke wil is een diepe overtuiging van een zekere aard. Niet perse een vrije.

Nou ja, de vraag is dan misschien in hoeverre de computer beďnvloed wordt door zijn omgeving?quote:Op zondag 18 oktober 2015 16:30 schreef lnloggen het volgende:

[..]

Dat sowieso niet, lijkt mij. Hoe flexibel en dynamisch en adaptief die software ook in elkaar zit, het is uiteindelijk toch een deterministisch algoritme. Dat kan best leren en zich ontwikkelen en steeds intelligenter gedrag vertonen, maar dat is dan nog steeds deterministisch.

Overigens kan de mens het volgens mij net zo min. De atomen waarvan organische hersencellen gemaakt zijn, zijn net zo deterministisch als de siliciumatomen van microprocessors.

Ik ben niet geheel overtuigd of een volledig digitaal denken onderhevig is aan strikt deterministische wetten. Of beter gezegd, staat van denken en opvattingen over het geheel.

Laten we zeggen dat er veel handelingen niet perse hoeven te volgen uit puur actie en reactie?

Het heeft geen menselijke beperkingen zowel in denken als biologisch, het kent geen honger, geen sociale cultuur, en geen opvoeding in principe. Hoe zou het dan gaan vraag ik mij af.

Zijn dat wel juiste vergelijkingen, analoog versus digitaal zegt vrij weinig op zich, meer de methode van vastleggen en processen.quote:Op zondag 18 oktober 2015 17:30 schreef Molurus het volgende:

[..]

Er zijn wel andere fundamentele verschillen tussen computers en menselijke hersenen:

1) hersenen zijn analoog daar waar (ieg de meeste) computers digitaal zijn.

2) bij computers zijn geheugen en processing grotendeels gescheiden, bij hersenen is dat meer geintegreerd.

3) hersenen hebben redelijk verregaand gespecialiseerde deelgebieden in de hardware. Bij computers is het allemaal redelijk uniform / onbepaald.

En zo zijn er vast nog wel meer.

Die zijn vast niet zo uniek als wij willen geloven, deze kunnen misschien zelfs wel digitaal voorbij gestreefd worden in zowel capaciteit als snelheid.

Op zich geen sterk argument dus.

Neuronen vuren wel of niet, niet een beetje. Dat de onderliggende hardware analoog is maakt weinig uit, de werking in een neuraal netwerk is in essentie een digitaal proces.quote:Op zondag 18 oktober 2015 17:30 schreef Molurus het volgende:

[..]

Er zijn wel andere fundamentele verschillen tussen computers en menselijke hersenen:

1) hersenen zijn analoog daar waar (ieg de meeste) computers digitaal zijn.

Overigens zijn siliciumatomen (waar computers van gemaakt zijn) natuurlijk net zo analoog als koolwaterstofverbindingen (waar hersenen van gemaakt zijn).

Beide een kwestie van implementatie. Scheiden of versmelting van geheugen en processing is een kwestie van hoe je de zaken programmeert, en gespecialiseerde deelgebieden zorgt er hooguit voor dat het sneller of efficiënter is, maar ook dat is een kwestie van tijd.quote:2) bij computers zijn geheugen en processing grotendeels gescheiden, bij hersenen is dat meer geintegreerd.

3) hersenen hebben redelijk verregaand gespecialiseerde deelgebieden in de hardware. Bij computers is het allemaal redelijk uniform / onbepaald.

Vast, en het prestatievermogen van computers van nu is ook nog niet te vergelijken met dat van hersenen. Maar ik zie niks cruciaals dat hersenen wel kunnen, en computers niet. Behalve dat hersenen veel sneller en groter zijn qua geheugen, parallelle verwerking, enzovoort. Maar dat schaalt allemaal vanzelf mee met het voortschrijden der techniek. En die techniek groeit bij computers een stuk harder dan de evolutie bij mensen.quote:En zo zijn er vast nog wel meer.

Vast behoorlijk wat, maar hoe is dat relevant? (en in hoeverre is die omgeving niet net zo deterministisch)quote:Op zondag 18 oktober 2015 17:41 schreef I-care het volgende:

Nou ja, de vraag is dan misschien in hoeverre de computer beďnvloed wordt door zijn omgeving?

Waaruit anders?quote:Ik ben niet geheel overtuigd of een volledig digitaal denken onderhevig is aan strikt deterministische wetten. Of beter gezegd, staat van denken en opvattingen over het geheel.

Laten we zeggen dat er veel handelingen niet perse hoeven te volgen uit puur actie en reactie?

Nou ja, dat vraag ik mij dus af. Iets is strikt deterministisch als voorgaande stappen, of processen geen andere uitkomst kunnen hebben dan welke volgt uit die voorgaande stappen.quote:Op zondag 18 oktober 2015 22:12 schreef lnloggen het volgende:

[..]

Vast behoorlijk wat, maar hoe is dat relevant? (en in hoeverre is die omgeving niet net zo deterministisch)

[..]

Waaruit anders?

Vrij keuze ontstaat dus eigenlijk pas als alle stappen en mogelijke uitkomsten bekend zijn. En de bewustwording daarvan geheel en compleet is. Met al die kennis over de invloeden is het mogelijk een keuze te maken die niet voortkomt uit een van de eerdere stappen. In reactionaire zin.

Kan een bewuste intelligentie zich daar bovenplaatsen vraag ik mij af?

Ik plaat dit alvast maar als notitie, want ik ben er nog niet helemaal uit hoe dat nu zou kunnen werken

Damn.. ik zit nu in season 4 aflevering 10 (ja, het is hard gegaan) en daarin zit echt een prachtige discussie tussen Harold en twee anderen over de vraag of zo'n AI 'benevolent' kan zijn.quote:Op woensdag 14 oktober 2015 12:20 schreef Fir3fly het volgende:

Trouwens, over dit onderwerp is er de geweldige serie Person of Interest. Een enorme aanrader.

"Wat nu als zo'n AI besluit om de honger in de werld op te lossen door genoeg mensen te vermoorden zodat er voldoende voedsel is voor iedereen? Het zou zijn doel bereikt hebben, maar is het moreel?"

Het lijkt mij eerder een te simpele reactie. Waarom niet juist investeren dan in de herdistributie van technologische ontwikkelingen?quote:"Wat nu als zo'n AI besluit om de honger in de werld op te lossen door genoeg mensen te vermoorden zodat er voldoende voedsel is voor iedereen? Het zou zijn doel bereikt hebben, maar is het moreel?"

Het schijnt zo te zijn dat naarmate de welvaart oploopt de geboorten teruglopen. Dat lijkt dus veel zinniger dan random mensen om te brengen. Zodoende is er dan op termijn ook weer voldoende voedsel en minder bevolking.

Ongebreidelde groei van mensen is ook niet handig natuurlijk en juist met een dergelijke aanpak zou een hele ethisch discussie/actie overbodig worden.

Vanuit rationeel oogpunt zou een reductie van een over-populatie de snelste oplossing bieden. Wij mensen doen immers precies hetzelfde bij andere levende soorten indien ze een bedreiging vormen voor het plaatselijke ecosysteem. (behalve bij onze eigen soort)quote:Op donderdag 26 november 2015 12:11 schreef I-care het volgende:

[..]

Het lijkt mij eerder een te simpele reactie. Waarom niet juist investeren dan in de herdistributie van technologische ontwikkelingen?

Het schijnt zo te zijn dat naarmate de welvaart oploopt de geboorten teruglopen. Dat lijkt dus veel zinniger dan random mensen om te brengen. Zodoende is er dan op termijn ook weer voldoende voedsel en minder bevolking.

Ongebreidelde groei van mensen is ook niet handig natuurlijk en juist met een dergelijke aanpak zou een hele ethisch discussie/actie overbodig worden.

Het is maar de vraag of AI ooit een vergevorderd moraliteitsbesef kan ontwikkelen om zo'n keuze te maken.

Vergeet niet dat vanuit menselijk oogpunt de meest prachtige idealen juist de meeste defecten vertonen. Vaak wanneer het rationeel gegeven wordt verblind door datzelfde ideaal. De beslissingen van een AI zou niet gebonden zijn aan dergelijke keuzes. Dat kan inderdaad verstrekkende gevolgen hebben.

Wanneer kun je spreken van een over-populatie? Dat is de vraag als eerst. Daarnaast moet je er dan al gelijk van uitgaan dat het een moreel besef heeft, of in ieder geval een alliantie met ons mensen, anders zou het geen besef hebben van een probleem en die in ons voordeel willen oplossen, al dan niet rationeel en ethisch verantwoordquote:Op donderdag 26 november 2015 12:48 schreef Elzies het volgende:

[..]

Vanuit rationeel oogpunt zou een reductie van een over-populatie de snelste oplossing bieden. Wij mensen doen immers precies hetzelfde bij andere levende soorten indien ze een bedreiging vormen voor het plaatselijke ecosysteem. (behalve bij onze eigen soort)

Het is maar de vraag of AI ooit een vergevorderd moraliteitsbesef kan ontwikkelen om zo'n keuze te maken.

Vergeet niet dat vanuit menselijk oogpunt de meest prachtige idealen juist de meeste defecten vertonen. Vaak wanneer het rationeel gegeven wordt verblind door datzelfde ideaal. De beslissingen van een AI zou niet gebonden zijn aan dergelijke keuzes. Dat kan inderdaad verstrekkende gevolgen hebben.

Misschien vernietigd de A.I ons gelijk al als soort en ontwerpt het een betere soort zodat het zelf de aarde kan gaan bevolken.. Who knows..

De mensheid heeft veel positieve eigenschappen en evenzoveel negatieve eigenschappen, het is maar net welke richting de mensheid zichzelf op wil sturen.

ENGINEERS ARE TEACHING ROBOTS TO SAY "NO", BUT IT'S FOR OUR OWN GOOD

We sure hope so...

At first, the news that software engineers are teaching robots to disobey their human masters does sound slightly troubling: should we really allow the artificial intelligence systems of the future to say no to us? But once you think it through, you can see why such a feature might actually end up saving your life.

http://www.sciencealert.c(...)t-s-for-our-own-good

http://www.theverge.com/2(...)f-driving-car-racingquote:Formula E announces the world's first driverless car racing series

Ten teams will compete before each race of the 2016-2017 season

Formula E, the global all-electric racing series, has partnered with a company called Kinetik to form the world's first driverless car racing series. The new support series, called Roborace, will run its races before each scheduled Formula E event starting next season.

Roborace will pit ten teams — each armed with two cars — against each other in hour-long races on the same street circuits that the Formula E cars compete on. Each one of the 20 autonomous electric cars will be the same as the next, so teams will have to focus on developing better algorithms and artificial intelligence to win. It's similar strategy to how Formula E teams were made to run the same cars in the electric series' debut season, which helped place an emphasis on the development of battery technology.

Waar is die serie te volgen eigenlijk?quote:Op zondag 8 november 2015 12:59 schreef Molurus het volgende:

[..]

Damn.. ik zit nu in season 4 aflevering 10 (ja, het is hard gegaan) en daarin zit echt een prachtige discussie tussen Harold en twee anderen over de vraag of zo'n AI 'benevolent' kan zijn.

"Wat nu als zo'n AI besluit om de honger in de werld op te lossen door genoeg mensen te vermoorden zodat er voldoende voedsel is voor iedereen? Het zou zijn doel bereikt hebben, maar is het moreel?"

Geen idee, ik download zulke dingen meestal.quote:Op zondag 29 november 2015 08:24 schreef I-care het volgende:

[..]

Waar is die serie te volgen eigenlijk?

Nog beterquote:Op zondag 29 november 2015 10:31 schreef Molurus het volgende:

[..]

Geen idee, ik download zulke dingen meestal.

Wat een serie hé. Geniet van aflevering 12, wat mij betreft de beste aflevering van de hele seriequote:Op zondag 8 november 2015 12:59 schreef Molurus het volgende:

[..]

Damn.. ik zit nu in season 4 aflevering 10 (ja, het is hard gegaan) en daarin zit echt een prachtige discussie tussen Harold en twee anderen over de vraag of zo'n AI 'benevolent' kan zijn.

"Wat nu als zo'n AI besluit om de honger in de werld op te lossen door genoeg mensen te vermoorden zodat er voldoende voedsel is voor iedereen? Het zou zijn doel bereikt hebben, maar is het moreel?"

De mijne is toch wel metquote:Op zondag 29 november 2015 19:54 schreef Fir3fly het volgende:

[..]

Wat een serie hé. Geniet van aflevering 12, wat mij betreft de beste aflevering van de hele serie.

Qua fictie vind ik de Space Odyssey-reeks interessant qua kunstmatige intelligentie. HAL9000SPOILERdie simulaties; dat de hele aflevering zich afspeelt in gedachtenwereld van The Machine. Het laat wat mij betreft op interessante wijze zien hoe een wezen ervaart dat buiten ruimte en tijd staat, in zekere zin.

Die bedoelde ik ookquote:Op zondag 29 november 2015 21:37 schreef Gray het volgende:

[..]

De mijne is toch wel metQua fictie vind ik de Space Odyssey-reeks interessant qua kunstmatige intelligentie. HAL9000SPOILERdie simulaties; dat de hele aflevering zich afspeelt in gedachtenwereld van The Machine. Het laat wat mij betreft op interessante wijze zien hoe een wezen ervaart dat buiten ruimte en tijd staat, in zekere zin.

Oh, ik had het niet opgezocht.quote:

En zou het niet zo zijn dat je hiermee een A.I creëert?

Intelligentie is nu in principe kennisabsorptie en deels patroon en systeemherkenning. Des te beter en groter iemand zijn geheugen en direct overzicht (snelheid) binnen al deze kennis en herkenning en begrip van wat die kennis verklaard over de systemen en patronen, des te groter/hoger de intelligentie is.

Creativiteit is dan deels/geheel verantwoordelijk voor vooruitgang middels het samenvoegen van onderdelen van die kennis om een behoefte te vervullen. Motivatie in principe, voor een verscheidenheid aan redenen.

Stel nu dat de aankomende computers al deze patronen in onze realiteit juist kan interpreteren, dan is deze machine in staat om vrijwel elk antwoord op elke vraag te geven.

Maar kan dit ook zonder dat het zich bewust is van deze kwaliteiten? En is dit een voordeel of nadeel, afhankelijk dus wie zich toegang zou kunnen verschaffen tot al die kennis en met welk doel.

[ Bericht 74% gewijzigd door I-care op 05-12-2015 11:34:35 ]

Ik vraag mij nu eigenlijk af of een dergelijk computer op kwantumniveau een connectie met onze realiteit zou kunnen maken?quote:Op maandag 19 oktober 2015 08:46 schreef I-care het volgende:

[..]

Nou ja, dat vraag ik mij dus af. Iets is strikt deterministisch als voorgaande stappen, of processen geen andere uitkomst kunnen hebben dan welke volgt uit die voorgaande stappen.

Vrij keuze ontstaat dus eigenlijk pas als alle stappen en mogelijke uitkomsten bekend zijn. En de bewustwording daarvan geheel en compleet is. Met al die kennis over de invloeden is het mogelijk een keuze te maken die niet voortkomt uit een van de eerdere stappen. In reactionaire zin.

Kan een bewuste intelligentie zich daar bovenplaatsen vraag ik mij af?

Ik plaat dit alvast maar als notitie, want ik ben er nog niet helemaal uit hoe dat nu zou kunnen werken

Stel dat een A.I een begrip over onze meest intieme realiteit ontwikkelt, kan het deze dan beďnvloeden doormiddel van interactie met het kwantumveld.

A collaboration between UW developmental psychologists and computer scientists aims to enable robots to learn in the same way that children naturally do. The team used research on how babies follow an adult’s gaze to “teach” a robot to perform the same task.

Babies learn about the world by exploring how their bodies move in space, grabbing toys, pushing things off tables and by watching and imitating what adults are doing.

But when roboticists want to teach a robot how to do a task, they typically either write code or physically move a robot's arm or body to show it how to perform an action.

Now a collaboration between University of Washington developmental psychologists and computer scientists has demonstrated that robots can "learn" much like kids -- by amassing data through exploration, watching a human perform a task and determining how best to carry out that task on its own.

http://www.sciencedaily.com/releases/2015/12/151201131715.htm

ELON MUSK LAUNCHES US$1 BILLION AI COMPANY TO "BENEFIT HUMANITY" AND AVOID ROBOT WARS

These are the droids we're looking for.

Tesla and SpaceX chief Elon Musk has already got a lot on his plate, but that hasn't stopped the ambitious tech entrepreneur from starting up yet another new venture: OpenAI, a not-for-profit research company dedicated to advancing the science and ethics of artificial intelligence (AI).

"Our goal is to advance digital intelligence in the way that is most likely to benefit humanity as a whole, unconstrained by a need to generate financial return," the OpenAI team wrote in a post announcing the US$1 billion initiative. "Since our research is free from financial obligations, we can better focus on a positive human impact. We believe AI should be an extension of individual human wills and, in the spirit of liberty, as broadly and evenly distributed as possible."

http://www.sciencealert.c(...)and-avoid-robot-wars

WHAT EXACTLY ARE THE ETHICS OF ROBOT LOVE?

Is love with machines immoral – or even possible?

There was to have been a conference in Malaysia last week called Love and Sex with Robots but it was cancelled. Malaysian police branded it "illegal" and "ridiculous". "There is nothing scientific about sex with robots," said a police chief. However, others believe there are many interesting and important aspects of intimate robot partners that are worth researching and discussing.

http://www.sciencealert.c(...)ethics-of-robot-love

Ik denk dat er een enorme markt mee aan te boren isquote:Op woensdag 23 december 2015 02:05 schreef Kijkertje het volgende:

[ afbeelding ]

WHAT EXACTLY ARE THE ETHICS OF ROBOT LOVE?

Is love with machines immoral – or even possible?

There was to have been a conference in Malaysia last week called Love and Sex with Robots but it was cancelled. Malaysian police branded it "illegal" and "ridiculous". "There is nothing scientific about sex with robots," said a police chief. However, others believe there are many interesting and important aspects of intimate robot partners that are worth researching and discussing.

http://www.sciencealert.c(...)ethics-of-robot-love

Maar er zijn zoveel mensen eenzaam en zonder liefde dat de robots uiteindelijk niet aan te slepen zullen zijn.

Zou zo'n beetje het einde van de mensheid betekenen.quote:Op donderdag 24 december 2015 07:25 schreef I-care het volgende:

[..]

Ik denk dat er een enorme markt mee aan te boren isTriest? Ja.

Maar er zijn zoveel mensen eenzaam en zonder liefde dat de robots uiteindelijk niet aan te slepen zullen zijn.

https://vimeo.com/12915013

Er is er anders wel een pas door de Turing test gekomen.quote:Op dinsdag 29 december 2015 11:38 schreef DuizendGezichten het volgende:

AI is het perfecte canvas waarop de mens al zijn/haar wensen en angsten kan schilderen. We kunnen er helaas ook niet al teveel met zekerheid over zeggen. Het is er namelijk nog niet.

Ik had zoiets gehoord, ja. Heb je daar een linkie voor?quote:Op dinsdag 29 december 2015 11:50 schreef MPC60 het volgende:

[..]

Er is er anders wel een pas door de Turing test gekomen.

[ Bericht 100% gewijzigd door idefixide op 30-12-2015 19:37:48 ]

[edit]quote:Op dinsdag 29 december 2015 21:20 schreef DuizendGezichten het volgende:

Waarom dit bovenstaande "recruitment" filmpje?

Ik had het hier gepost omdat het als topic o.a. over de technologische ontwikkeling gaat, waar AI naar mijn opvatting een prominente rol in gaat spelen.

[ Bericht 9% gewijzigd door idefixide op 30-12-2015 20:01:25 ]

Ik denk dat we in de toekomst nog veel spectaculaire ontwikkelingen tegemoet kunnen zien, maar dat er nog essentiële barričres te slechten zijn. Specialisten in dit vakgebied zoals Max Welling (hoogleraar machine learning) verwachten dat machines die intelligenter dan mensen zijn op termijn van 60 jaar beschikbaar zijn.

quote:Met de AlphaGo ontwikkelt Google de eerste computer die intuďtief kan spelen

Nieuwe mijlpaal in artificiële intelligentie: computer verslaat mens bij complex bordspel

Dat we het in een partijtje schaak al lang niet meer van een computer kunnen halen, wisten we al. Nu blijkt een computer ook 'slimmer' te zijn dan het menselijk brein wanneer het gaat om een spelletje GO. Dat is opmerkelijk omdat het Chinese bordspel oneindig veel complexer is dan bijvoorbeeld schaken. De overwinning betekent dan ook een nieuwe grote stap in het veld van de artificiële intelligentie.

Door de jaren heen werden computers ingewikkelde puzzels waarvan we aanvankelijk dachten dat ze alleen door het menselijke brein opgelost konden worden, steeds beter meester. In 1997 versloeg de supercomputer van IBM Deep Blue grootmeester Garry Kasparov bij een partijtje schaak en in 2011 gaf IBM's Watson alle voorgaande winnaars van de quiz Jeopardy het nakijken. Dit jaar werd op gebied van artificiële intelligentie echter een nieuwe kaap gerond: een computer is erin geslaagd de mens te verslaan in het spel GO. Die prestatie is zo bijzonder omdat het Chinese bordspel oneindig veel complexer is dan eender welk ander bordspel.

Het aloude Chinese GO wordt gespeeld op een bord waarop 19 x 19 lijnen samen een raster met 316 'kruispunten' vormen. De bedoeling van het spel is dat beide spelers met hun stenen (de ene wit, de andere zwart) zoveel mogelijk hokjes veroveren door ze te omsingelen. Hoewel de regels van GO op zich niet zo ingewikkeld zijn, is het spelverloop dat zeker wel: bij elke zet zijn er zo'n 200 verschillende opties mogelijk. Bij schaak zijn er dat maar om en bij de 20. Die ruime keuzemogelijkheid maakt het voor een computer bijzonder moeilijk om het spel onder de knie te krijgen.

Menselijk denken

'Bij GO kan een computer niet simpelweg de best mogelijke stappen uit het totaal selecteren, de opties zijn immers eindeloos'

Demis Hassabis, CEO van Google DeepMind

"Bij een spelletje schaak volstaat het voor een computer om de gevolgen van elke mogelijke stap uit te denken en vervolgens de meest efficiënte weg naar winst te kiezen", zegt Demis Hassabis, CEO van Google DeepMind aan Quartz. "Bij Go is dat echter onmogelijk, er zijn immers meer mogelijkheden dan dat er atomen zijn in het heelal." Om een computer te bouwen die op een professionele manier Go kan spelen, moest men dus een systeem ontwikkelen dat het denkvermogen van een mens nabootst. Dat is dan ook precies wat de onderzoekers van DeepMind deden.

Voor hun design bouwde het team twee neurale computernetwerken die 'getraind' kunnen worden door grote hoeveelheden data in te voeren. Die data kan de computer vervolgens actief gebruiken om problemen op te lossen. "We hebben AlphaGo een analyse laten maken van 30 miljoen zetten van Go-partijen tussen professionele spelers", zegt Hassabis. "Op die manier leerde de computer welke zetten vaak gemaakt worden, en welk resultaat die opleveren in het vervolg van het spel." Aan de hand van die opgedane kennis speelde de computer vervolgens miljoenen spelen tegen zichzelf. Daardoor kon hij leren uit zijn eigen fouten en het spel zodanig onder de knie krijgen dat hij zijn stappen voortaan ook vooruit kon plannen.

Intuďtie

Erg bijzonder aan de neurale netwerken is, dat ze de computer toelaten te opereren op basis van zijn 'intuďtie': in plaats van alle mogelijke moves uit te denken, maakt het systeem uit een oneindig aantal mogelijkheden een selectie van twee of drie stappen, waarvan het 'aanvoelt' dat deze de beste opties zijn. Net zoals ook topspelers van Go moeten afgaan op hun buikgevoel om een spel te winnen.

'Net zoals ook topspelers van Go moeten afgaan op hun buikgevoel om een spel te winnen, zal de computer aanvoelen welke zet de beste is'

Demis Hassabis, CEO van Google DeepMind

Dat de AlphaGo zijn naam niet gestolen heeft, mag duidelijk zijn: vorig jaar in oktober versloeg de computer de Europese Go-kampioen met forfaitcijfers. De resultaten van die match werden nu pas naar buiten gebracht om ze te laten samenvallen met de publicatie rond de software in het vakblad Nature. Daarnaast lieten de onderzoekers van Deep Mind hun 'slimme speler' het ook opnemen tegen andere GO-spelende computersystemen. Van die partijen won AlphaGO er 99,8 procent.

De nieuwe Google-computer lijkt alvast één groot streepje voor te hebben op de mens: "Terwijl mensen onvermijdelijk bepaalde zwakheden hebben - ze worden moe wanneer ze lang spelen of kunnen fouten maken - heeft ons systeem daar geen last van", zegt Hassabis. "Sterker nog: hoe meer het speelt, hoe sterker het zal worden." De ontwikkeling van de AlphaGo lijkt dan ook een nieuwe mijlpaal te zijn in de ontwikkeling van artificiële intelligentie: de computer ondersteunt de idee dat echt, doelgericht 'denkwerk' door technische computersystemen wel degelijk mogelijk is.

[ Bericht 1% gewijzigd door kl1172 op 28-01-2016 15:01:24 ]

quote:Op donderdag 28 januari 2016 14:55 schreef kl1172 het volgende:

Een leuk tussendoortje uit AI-land.

[..]

Artificial intelligence beats human Go champion for the first time

Ik denk persoonlijk dat de mens een vorm van ai is, ik geloof niet echt in vrije wil. We zijn een product van ons leven. Ik denk ook dat het menselijke brein de sleutel is tot ai.

Ik ben niet zozeer bang voor of verheugd op de "effecten" van ai, maar ik maak me eerder zorgen om wie deze eerste vormen zullen beinvloeden. Ik denk dat dat het meeste impact zal hebben op hoe ai zich zal ontwikkelen. Waardoor het eigenlijk neerkomt op het vertrouwen in de mens, dus dat komt volgens mij neer op een 50/50

ik denk persoonlijk dat de ai ons op een gegeven moment zullen zien als een virus op deze planeet. Een destructief egoďstisch ras, die andere levensvormen bedreigd. En om deze balans te herstellen zou het aantal mensen drastisch moeten verminderen. Als mens zou ik dit nooit kunnen doen. maar net zoals wij het bij dieren doen omdat wij "superieur" zijn, zou een ai die superieur aan ons is hetzelfde bij ons kunnen doen. Als een bepaald diersoort een plaag word bestrijden we die. ik zal ook niet de beste kandidaat zijn om deze eerste vormen van ai te beďnvloeden. (Gelukkig maar)

Hoe bedoel je beďnvloeden?quote:Op vrijdag 5 februari 2016 17:32 schreef LionPopChoc het volgende:

Ai, ik weet vrij weinig over dit onderwerp maar intressant vind ik het wel.

Ik denk persoonlijk dat de mens een vorm van ai is, ik geloof niet echt in vrije wil. We zijn een product van ons leven. Ik denk ook dat het menselijke brein de sleutel is tot ai.

Ik ben niet zozeer bang voor of verheugd op de "effecten" van ai, maar ik maak me eerder zorgen om wie deze eerste vormen zullen beinvloeden. Ik denk dat dat het meeste impact zal hebben op hoe ai zich zal ontwikkelen. Waardoor het eigenlijk neerkomt op het vertrouwen in de mens, dus dat komt volgens mij neer op een 50/50

ik denk persoonlijk dat de ai ons op een gegeven moment zullen zien als een virus op deze planeet. Een destructief egoďstisch ras, die andere levensvormen bedreigd. En om deze balans te herstellen zou het aantal mensen drastisch moeten verminderen. Als mens zou ik dit nooit kunnen doen. maar net zoals wij het bij dieren doen omdat wij "superieur" zijn, zou een ai die superieur aan ons is hetzelfde bij ons kunnen doen. Als een bepaald diersoort een plaag word bestrijden we die. ik zal ook niet de beste kandidaat zijn om deze eerste vormen van ai te beďnvloeden. (Gelukkig maar)

Ik vermoed zoiets als 'tot slaaf maken van je eigen politieke agenda'.quote:

Zo'n AI geeft macht, iedereen zal daar - het liefst exclusieve - controle over willen hebben.

Uiteraard. Maar dan zou het geen echte A.I zijn naar mijn idee, maar een zeer geavanceerde rekenmachinequote:Op vrijdag 5 februari 2016 19:27 schreef Molurus het volgende:

[..]

Ik vermoed zoiets als 'tot slaaf maken van je eigen politieke agenda'.

Zo'n AI geeft macht, iedereen zal daar - het liefst exclusieve - controle over willen hebben.

Dan dus liever een echte A.I die wel bewust is dan een zeer capabele machine zonder. Dat laatste is namelijk veel gevaarlijker, omdat het dan nog steeds mensen zijn die het gebruiken en aansturen.

Ik weet niet zo goed hoe ik het moet uitleggen maar mijn kijk op dingen in het leven heb ik ook alleen maar omdat bepaalde dingen/mensen/boeken/films etc. Mij op een bepaalde manier beďnvloed hebben.

Dus beďnvloed als in wat voor informatie word overgebracht, en hoe de samenhang van verschillende soorten info tot een bepaalde conclusie leid.

Dat begrijp ik wel. Voor een eckte A.I niet zo moeilijk om te achterhalen lijkt mij. Dat het tot andere conclusies kan leiden dan wat nu normaal lijkt kan ik mij ook voorstellen.quote:Op vrijdag 5 februari 2016 19:47 schreef LionPopChoc het volgende:

Oo nee niet als in een conspiracy theory hoor.

Ik weet niet zo goed hoe ik het moet uitleggen maar mijn kijk op dingen in het leven heb ik ook alleen maar omdat bepaalde dingen/mensen/boeken/films etc. Mij op een bepaalde manier beďnvloed hebben.

Dus beďnvloed als in wat voor informatie word overgebracht, en hoe de samenhang van verschillende soorten info tot een bepaalde conclusie leid.

Bekijk per individu wat hem of haar beweegt en optimaal dient. Vermenigvuldig dat met een paar miljard en realiseer omstandigheden die daarvoor best suited zijn.

A NOVEL WRITTEN BY AI PASSES THE FIRST ROUND IN A JAPANESE LITERARY COMPETITION

I, for one, welcome our new AI overlords.

It may be time to add 'novelist' to the list of professions under threat from super-smart computer software, because a short story authored by artificial intelligence has made it through to the latter stages of a literary competition in Japan. It didn't scoop the top prize, but it's not a bad effort for a beginner.

http://www.sciencealert.c(...)literary-competition

http://www.zerohedge.com/(...)itic-obama-bashing-p

quote:Microsoft apparently became aware of the problem with Tay's racism, and silenced the bot later on Wednesday, after 16 hours of chats.

BRAVE NEW WORLD? SCI-FI FEARS 'HOLD BACK PROGRESS OF AI', WARNS EXPERT

Chris Bishop fears concern over Terminator-style scenarios could deprive humanity of one of the most powerful technologies ever created

‘Focusing on Terminator and the end of humanity’ could deprive us of the benefits of AI, said Chris Bishop of Microsoft Research.

The promise of artificial intelligence could be lost to humanity because people fear Terminator-style robots and other doomsday scenarios, an expert has warned.

Hyperbole about the risks of artificial intelligence threaten to scupper developments that could assist humanity, from driverless cars that could cut down road accidents to medical systems that could revolutionise healthcare, said Chris Bishop, director of Microsoft Research in Cambridge.

https://www.theguardian.c(...)i-warns-expert#img-1

AI WILL CREATE 'USELESS CLASS' OF HUMAN, PREDICTS BESTSELLING HISTORIAN

Smarter artificial intelligence is one of 21st century’s most dire threats, writes Yuval Noah Harari in follow-up to Sapiens

An iCub robot learns how to play from a child. Photograph: Dr Patricia Shaw/EPSRC/PA

It is hard to miss the warnings. In the race to make computers more intelligent than us, humanity will summon a demon, bring forth the end of days, and code itself into oblivion. Instead of silicon assistants we’ll build silicon assassins.

The doomsday story of an evil AI has been told a thousand times. But our fate at the hand of clever cloggs robots may in fact be worse - to summon a class of eternally useless human beings.

At least that is the future predicted by Yuval Noah Harari, a lecturer at the Hebrew University in Jerusalem, whose new book says more of us will be pushed out of employment by intelligent robots and on to the economic scrap heap.

https://www.theguardian.c(...)l-intelligence#img-1

Dat is de droom.quote:Op vrijdag 20 mei 2016 19:19 schreef Kijkertje het volgende:

AI WILL CREATE 'USELESS CLASS' OF HUMAN, PREDICTS BESTSELLING HISTORIAN

Smarter artificial intelligence is one of 21st century’s most dire threats, writes Yuval Noah Harari in follow-up to Sapiens

[ afbeelding ]

An iCub robot learns how to play from a child. Photograph: Dr Patricia Shaw/EPSRC/PA

It is hard to miss the warnings. In the race to make computers more intelligent than us, humanity will summon a demon, bring forth the end of days, and code itself into oblivion. Instead of silicon assistants we’ll build silicon assassins.

The doomsday story of an evil AI has been told a thousand times. But our fate at the hand of clever cloggs robots may in fact be worse - to summon a class of eternally useless human beings.

At least that is the future predicted by Yuval Noah Harari, a lecturer at the Hebrew University in Jerusalem, whose new book says more of us will be pushed out of employment by intelligent robots and on to the economic scrap heap.

https://www.theguardian.c(...)l-intelligence#img-1

Scientists just started teaching robots to feel pain

What could go wrong?

We're building robots that can walk and talk like us, but now we're giving them another a human quality you might not expect: the ability to feel pain. If nothing else, it should give us a chance if they ever try to overthrow humanity.

The researchers behind the technology think pain-sensitive robots are worth developing so they can keep themselves - and the humans working with them - safe from harm. If there's a threat to a robot's gears or motors, for example, it can take evasive action.

Artificial intelligence should be protected by human rights, says Oxford mathematician

Machines have feelings too.

With huge leaps taking place in the world of artificial intelligence (AI), right now, experts have started asking questions about the new forms of protection we might need against the formidable smarts and potential dangers of computers and robots of the near future.

But do robots need protection from us too? As the 'minds' of machines evolve ever closer to something that's hard to tell apart from human intelligence, new generations of technology may need to be afforded the kinds of moral and legal protections we usually think of as 'human' rights, says mathematician Marcus du Sautoy from the University of Oxford in the UK.

Ook van Marcus du Sautoy een aflevering van Horizon: The Hunt For AI

China Unveils The Fastest Supercomputer In The World

The crown for the fastest supercomputer remains in China, with Sunway TaihuLight taking the top spot from Tianhe-2. The new system is able to do almost three times more operations per second.

The recent TOP500 list of the most powerful supercomputers was announced at the International Supercomputing Conference, and TaihuLight has quickly taken center stage. The new machine can perform 93 petaflops, which is jargon for 93 quadrillion operations per second. That’s equivalent to over 50,000 Playstation 4s or about 2.6 million Samsung Galaxy S6s.

The incredible specs are not the only intriguing features. The entire machine was built with Chinese components following the US ban on Intel helping China to upgrade Tianhe-2 last year.

“As the first number one system of China that is completely based on homegrown processors, the Sunway TaihuLight system demonstrates the significant progress that China has made in the domain of designing and manufacturing large-scale computation systems,” Dr. Guangwen Yang, director of the National Supercomputing Center that houses TaihuLight, told TOP500 News.

TaihuLight is both powerful and efficient. It is made of 10.65 million cores divided on 41,000 chips, and it only uses 1.3 petabytes (1,300 terabytes) of RAM, which makes it incredibly energy efficient – it only needs 15.3 megawatts of power. By comparison, the most powerful supercomputer in the US only has 560,000 cores, and on power consumption, Tianhe-2 needs 17.8 megawatts for its 33 petaflops.

Although the focus is all on the latest Chinese machine, the TOP500 list shows significant progress in the entire field. The total combined performances have grown by almost 200 petaflops in the last year, with 95 machines now performing more than 1 petaflop. China also leads the list in the number of machines, 167, with the US second with 165. Europe shares 105 systems, 26 of which are in Germany, 18 in France, and 12 in the UK.

Supercomputers are a vital instrument for national security, scientific research, and industry. Climate forecasting, synthesizing new drugs, and product design are but a few ways that supercomputers impact everyday life.

http://www.iflscience.com(...)mputer-in-the-world/

Elon Musk's new company is developing robots to do your housework

For most people, housework is the absolute worst, and it’s kinda weird how in 2016, we still don’t have anything remotely like Rosie the robot maid, who vacuumed the hell out of the Jetsons’ house.

Well, it might finally be our time, because multitasking entrepreneur Elon Musk just announced that his new robotics firm, Open AI, will be developing 'domestic robots' that can perform basic household chores.

To accelerate the process, Open AI will be developing the robots based on technology that already exists - basically, it’s going to be taking off-the-shelf robots and customising them to do housework.

"There are existing techniques for specific tasks, but we believe that learning algorithms can eventually be made reliable enough to create a general-purpose robot," Open AI says in a blog post.

Open AI launched back in December 2015, and is headed up by Musk and Sam Altman, president of Y Combinator - a US company that provides seed funding for startups. Since then, it’s secured US$1 billion in funding from tech heavy-hitters such as PayPal cofounder Peter Thiel.

The idea behind the non-profit is to bring artificial intelligence to our everyday lives, rather than keeping it locked up in robotics labs around the world.

"We believe AI should be an extension of individual human wills and, in the spirit of liberty, as broadly and evenly distributed as is possible safely," the company announced at its launch.

Building a viable chore-bot is just one of Open AI’s goals, another is to build a robot with a useful and natural understanding of language.

Basically, they say the robots of today can understand certain, very specific questions and commands, but real intelligence is being able to ask for clarification and figure out if what’s being asked of it practical, safe, and non-ambiguous.

Progress is being made in this field, with this incredibly creepy robot almost holding its own in an existential conversation with a visibly bemused journalist, and this little guy, which is being taught to only follow instructions from humans if they don’t put it in danger. So researchers are pretty much figuring out how to troll-proof their robots.

"Today, there are promising algorithms for supervised language tasks such as question answering, syntactic-parsing and machine translation but there aren’t any for more advanced linguistic goals, such as the ability to carry a conversation, the ability to fully understand a document, and the ability to follow complex instructions in natural language," says Open AI. "We expect to develop new learning algorithms and paradigms to tackle these problems."

They should have a chat to Microsoft’s temporarily decommissioned chatbot Tay, but not for too long, in case she starts outing the Zodiac killer and asking for that sweet 3-inch-floppy.

The final goal for Open AI right now is solve a wide variety of games, such as chess, Go, and the Rubik's cube, using a single robot.

This all sounds great, and like most of what Musk does, including trying to get humans to Mars, and making renewable energy more available to the average person, we’re all in. Hopefully it doesn't backfire with our chorebots getting all stabby on us, but if anyone's going to do this cautiously, it's Musk.

"I think we should be very careful about artificial intelligence," he said during an MIT symposium back in 2014. "If I were to guess at what our biggest existential threat is, it's probably that... With artificial intelligence, we are summoning the demon."

GOOGLE'S DEEPMIND AI JUST MADE A MACHINE THAT SOUNDS EXACTLY LIKE A HUMAN

The future is now.

Now, there’s a new contender, brought to you by the brilliant minds behind DeepMind. Google has announced a new voice synthesis program in WaveNet, powered by deep neural AI.

Understanding voice samples has been powering programs like Google Voice Search for quite some time now. However, synthesizing something from those samples is proving to be quite a challenge.

The most prominent method to do that right now is concatenative TTS (text-to-speech). It combines fragments of recorded speech together.

The major drawback is this method can’t modify the fragments to create something new, resulting in the stilted 'robotic' voice. Another method is parametric TTS, which passes speech through a vocoder, producing even less natural speech.

Google’s WaveNet uses a completely different approach.

Instead of simply analysing the audio it's fed, it learns from them, similar to how many deep neural systems work. By working with at least 16,000 samples per second, WaveNet can generate its own raw audio samples.

And it can do this without much human intervention; it uses statistics to actually predict which audio piece it needs, what it has to 'say' next.

Want to take a listen for yourself? The announcement post has several voice samples in both English and Mandarin Chinese. The system is also able to synthesise its own music, since it can analyse any sound patterns and not just speech.

You can also listen to samples of the original compositions. Perhaps most impressively, the system is also able to synthesise speech without input.

Where TTS always requires input as instruction, WaveNet is able to create speech sound without a road map.

Granted, the result is just a string of nonsense sounds but it also contains the sounds of mouth movements and breathing.

This indicates the exciting potential of the system to create the most realistic computer voices.

Volgens mij slaat hij daar een stap over, en is het probleem eigenlijk: the way we treat ants.quote:Op vrijdag 30 september 2016 02:33 schreef Kijkertje het volgende:

but we haven't yet grappled with the problems associated with creating something that may treat us the way we treat ants.

Dat hele AI gebeuren wordt veel te veel op een antropocentrische manier beoordeeld. Alsof de mens de kroon van de schepping is waar het allemaal om draait. Was het voor onze evolutionaire voorgangers een probleem dat wij ontstonden? Voor sommigen absoluut. Was het voor de evolutie op zich, de ontwikkeling en groei en bewustwording en toename van intelligentie een probleem dat wij ontstonden? Nee, juist niet, dat was gewoon de zoveelste stap voorwaarts. Zoals AI dat ook zal zijn.

Als we iets kunnen maken wat slimmer, intelligenter, bewuster is dan wij zelf, zeg ik: doen!

Van onze kinderen hopen we dat ook, dus waarom niet van onze software.

Lees het boek Superintelligence van Nick Bostrom eens. Zo makkelijk moeten we niet denken over A.I.quote:Op vrijdag 30 september 2016 09:26 schreef Jace_TBL het volgende:

[..]

Volgens mij slaat hij daar een stap over, en is het probleem eigenlijk: the way we treat ants.

Dat hele AI gebeuren wordt veel te veel op een antropocentrische manier beoordeeld. Alsof de mens de kroon van de schepping is waar het allemaal om draait. Was het voor onze evolutionaire voorgangers een probleem dat wij ontstonden? Voor sommigen absoluut. Was het voor de evolutie op zich, de ontwikkeling en groei en bewustwording en toename van intelligentie een probleem dat wij ontstonden? Nee, juist niet, dat was gewoon de zoveelste stap voorwaarts. Zoals AI dat ook zal zijn.

Als we iets kunnen maken wat slimmer, intelligenter, bewuster is dan wij zelf, zeg ik: doen!

Van onze kinderen hopen we dat ook, dus waarom niet van onze software.

Of, hier

Persoonlijk zeg ik: niet doen. Althans, laten we zo veel mogelijk oplossingen proberen te vinden binnen de reguliere computersystemen die we al hebben. Daar zit, op het gebied van weak a.i., al tal van vooruitgang in sinds de laatste jaren. Verder is een echte A.I. uitermate onvoorspelbaar. Laten we eerst maar eens een jaar of vijftig onderzoek doen naar hoe we in een gesloten omgeving kunnen stoppen.

Kijkend naar wat de mens met de planeet heeft gedaan, zeg je dan in retrospect over de evolutie naar de huidige mens ook: hadden we beter niet kunnen doen?quote:Op vrijdag 30 september 2016 16:15 schreef Discombobulate het volgende:

Persoonlijk zeg ik: niet doen. Althans, laten we zo veel mogelijk oplossingen proberen te vinden binnen de reguliere computersystemen die we al hebben. Daar zit, op het gebied van weak a.i., al tal van vooruitgang in sinds de laatste jaren. Verder is een echte A.I. uitermate onvoorspelbaar. Laten we eerst maar eens een jaar of vijftig onderzoek doen naar hoe we in een gesloten omgeving kunnen stoppen.

Die mensapen en primaten hadden beter zoveel mogelijk oplossingen kunnen zoeken binnen het reguliere oerwoud en ecosysteem dat ze al hadden?

Help, de robot heeft mensenrechten

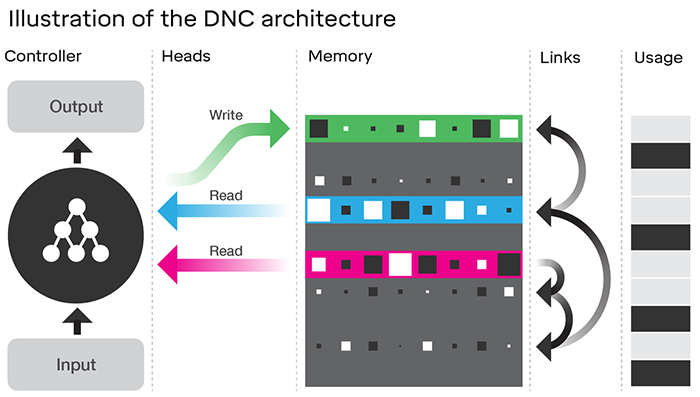

Google's AI can now learn from its own memory independently

It begins.

The DeepMind artificial intelligence (AI) being developed by Google's parent company, Alphabet, can now intelligently build on what's already inside its memory, the system's programmers have announced.

Their new hybrid system – called a Differential Neural Computer (DNC) – pairs a neural network with the vast data storage of conventional computers, and the AI is smart enough to navigate and learn from this external data bank.

hat the DNC is doing is effectively combining external memory (like the external hard drive where all your photos get stored) with the neural network approach of AI, where a massive number of interconnected nodes work dynamically to simulate a brain.

"These models... can learn from examples like neural networks, but they can also store complex data like computers," write DeepMind researchers Alexander Graves and Greg Wayne in a blog post.

At the heart of the DNC is a controller that constantly optimises its responses, comparing its results with the desired and correct ones. Over time, it's able to get more and more accurate, figuring out how to use its memory data banks at the same time.

Take a family tree: after being told about certain relationships, the DNC was able to figure out other family connections on its own – writing, rewriting, and optimising its memory along the way to pull out the correct information at the right time.

Another example the researchers give is a public transit system, like the London Underground. Once it's learned the basics, the DNC can figure out more complex relationships and routes without any extra help, relying on what it's already got in its memory banks.

In other words, it's functioning like a human brain, taking data from memory (like tube station positions) and figuring out new information (like how many stops to stay on for).

Of course, any smartphone mapping app can tell you the quickest way from one tube station to another, but the difference is that the DNC isn't pulling this information out of a pre-programmed timetable – it's working out the information on its own, and juggling a lot of data in its memory all at once.

The approach means a DNC system could take what it learned about the London Underground and apply parts of its knowledge to another transport network, like the New York subway.

The system points to a future where artificial intelligence could answer questions on new topics, by deducing responses from prior experiences, without needing to have learned every possible answer beforehand

Of course, that's how DeepMind was able to beat human champions at Go – by studying millions of Go moves. But by adding external memory, DNCs are able to take on much more complex tasks and work out better overall strategies, its creators say.

"Like a conventional computer, [a DNC] can use its memory to represent and manipulate complex data structures, but, like a neural network, it can learn to do so from data," the researchers explain in Nature.

In another test, the DNC was given two bits of information: "John is in the playground," and "John picked up the football." With those known facts, when asked "Where is the football?", it was able to answer correctly by combining memory with deep learning. (The football is in the playground, if you're stuck.)

Making those connections might seem like a simple task for our powerful human brains, but until now, it's been a lot harder for virtual assistants, such as Siri, to figure out.

With the advances DeepMind is making, the researchers say we're another step forward to producing a computer that can reason independently.

And then we can all start enjoying our robot-driven utopia – or technological dystopia – depending on your point of view.

Uh, wij zijn toch geen apen? We stammen alleen af van een gemeenschappelijke voorouder. Dat wij zijn geëvolueerd ten koste van anderen betekend niet dat dit ook onze intentie geweest is. Als een A.I. die intentie wel heeft of ontwikkeld, tja dan zijn we fucked, en het is trouwens ook nog eens moreel minderwaardig om zo'n intentie te hebben. Ik zou niet willen dat een A.I. ons obsoleet maakt.quote:Op zaterdag 1 oktober 2016 10:27 schreef lnloggen het volgende:

[..]

Die mensapen en primaten hadden beter zoveel mogelijk oplossingen kunnen zoeken binnen het reguliere oerwoud en ecosysteem dat ze al hadden?

Als je een aap kunt definiëren als groep zijn wij wel degelijk apen.quote:Op dinsdag 18 oktober 2016 16:41 schreef Discombobulate het volgende:

[..]

Uh, wij zijn toch geen apen?

Ja, maar dit is natuurlijk maar een semantisch spelletje. Je kunt ons ook definiëren als eukaryoot, dan zijn we alles behalve archeae en prokaryoten.quote:Op dinsdag 18 oktober 2016 16:48 schreef Fir3fly het volgende:

[..]

Als je een aap kunt definiëren als groep zijn wij wel degelijk apen.

Klopt, maar dan alsnog lijkt het me dichter bij de waarheid te liggen om mensen ook gewoon apen te noemen.quote:Op dinsdag 18 oktober 2016 17:06 schreef Discombobulate het volgende:

[..]

Ja, maar dit is natuurlijk maar een semantisch spelletje.

Huh, welke waarheid?quote:Op dinsdag 18 oktober 2016 17:58 schreef Fir3fly het volgende:

[..]

Klopt, maar dan alsnog lijkt het me dichter bij de waarheid te liggen om mensen ook gewoon apen te noemen.

Gewoon apen dus

![[Person of Interest] Prophets - Machine progress](https://i.ytimg.com/vi/8yT2oXEpGmg/0.jpg)