W&T Wetenschap & Technologie

Een plek om te discussiëren over wetenschappelijke onderwerpen, wetenschappelijke problemen, technologische projecten en grootse uitvindingen.

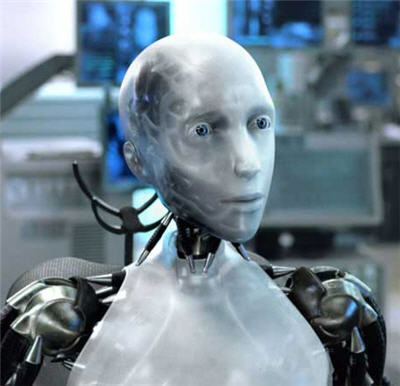

imagine a world 30 years into the future where intelligent robots have come into full

mission, more sophisticated, more intelligent...

And Man said, 'Let there be light'. And He was blessed by light, heat, magnetism, gravity,

and all the energies of the universe.

Na een bericht op Tweakers gelezen te hebben over een man die van scrap-parts

een robot had gemaakt welke naar zeggen huishoudelijke taken en gevaarlijk werk zou

kunnen doen, en deze in een noemer genoemd werd met commerciele robots die

bijvoorbeeld in Japan gemaakt worden werd ik nieuwschierig over hoever ze nu

al zijn met Robot's... Het laatste grote nieuws wat ik op dit vlak gehoord heb is dat

ze een robot echt konden laten rennen (dus op een moment beide voeten van de

vloer)...

Ik heb een video opgezocht dat bij het nieuwsbericht op tweakers hoort, maar vond

het een btje teleurstellend: Bij dit bericht zit een video fragment

Ik heb video's opgezocht van meer opzienbarende robots:

Humanoid Robots

Actroid Robot

Engelstalige robot

Japanstalige robot

Een skateboardende en rolschaatsende robot

Dansende Sony robots

Een fietsende robot:

Een bizarre robot op 4 benen die flink wat ballast kan tillen en zichzelf corrigeert als hij uit balans raakt:

http://nl.youtube.com/watch?v=lY__e391IRY

De Honda Robot die trappen loopt, rent en een geavanceerd zicht en herkenning heeft,

en veel taken kan uitvoeren...

Robot Dieren:

Robot vis (heel vet)

Robot Libelle

Robot Olifant

Robot zwemmende slang

kakkerlak robot

Robot pakken:

Cyberdine robot (was cyberdine ook niet in The Terminator de

maker van de robots?

Land Walker (btje lawaaig en langzaam wel)

Anyways, ik ben benieuwd over hoeveel tijd we op dit vlak zijn beland:

Of dit:

In hoeverre zal economie dan nog gebonden zijn aan menselijk handelen (denken, doen)...

Hoe komen we aan ons inkomen? Is dat nog nodig? En... Zijn we nog eigen baas?

Graag meningen, voor en tegenpunten, en eventuele nieuwtjes en toevoegingen...

mission, more sophisticated, more intelligent...

And Man said, 'Let there be light'. And He was blessed by light, heat, magnetism, gravity,

and all the energies of the universe.

Na een bericht op Tweakers gelezen te hebben over een man die van scrap-parts

een robot had gemaakt welke naar zeggen huishoudelijke taken en gevaarlijk werk zou

kunnen doen, en deze in een noemer genoemd werd met commerciele robots die

bijvoorbeeld in Japan gemaakt worden werd ik nieuwschierig over hoever ze nu

al zijn met Robot's... Het laatste grote nieuws wat ik op dit vlak gehoord heb is dat

ze een robot echt konden laten rennen (dus op een moment beide voeten van de

vloer)...

Ik heb een video opgezocht dat bij het nieuwsbericht op tweakers hoort, maar vond

het een btje teleurstellend: Bij dit bericht zit een video fragment

Ik heb video's opgezocht van meer opzienbarende robots:

Humanoid Robots

Actroid Robot

Engelstalige robot

Japanstalige robot

Een skateboardende en rolschaatsende robot

Dansende Sony robots

Een fietsende robot:

Een bizarre robot op 4 benen die flink wat ballast kan tillen en zichzelf corrigeert als hij uit balans raakt:

http://nl.youtube.com/watch?v=lY__e391IRY

De Honda Robot die trappen loopt, rent en een geavanceerd zicht en herkenning heeft,

en veel taken kan uitvoeren...

Robot Dieren:

Robot vis (heel vet)

Robot Libelle

Robot Olifant

Robot zwemmende slang

kakkerlak robot

Robot pakken:

Cyberdine robot (was cyberdine ook niet in The Terminator de

maker van de robots?

Land Walker (btje lawaaig en langzaam wel)

Anyways, ik ben benieuwd over hoeveel tijd we op dit vlak zijn beland:

Of dit:

In hoeverre zal economie dan nog gebonden zijn aan menselijk handelen (denken, doen)...

Hoe komen we aan ons inkomen? Is dat nog nodig? En... Zijn we nog eigen baas?

Graag meningen, voor en tegenpunten, en eventuele nieuwtjes en toevoegingen...

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

De grootste vraag is die de wetenschappers zich afvragen wat kan en gaat er gebeuren als we inderdaad het voorelkaar krijgen om Artificial intelligence te ontwikkelen?

Dit is nog steeds niet te voorspellen. Maar ga eens een boek lezen van Asimov, erg mooie boeken over dit onderwerp met goede verhalen.

Dit is nog steeds niet te voorspellen. Maar ga eens een boek lezen van Asimov, erg mooie boeken over dit onderwerp met goede verhalen.

Driving:

Mazda 626 Coupe GT 2.0i 16v

Mazda MX-6 GT 4WS 2.2i 12v turbo intercooled

Mazda MX-5 1.6i 16v

Mazda 626 Coupe GT 2.0i 16v

Mazda MX-6 GT 4WS 2.2i 12v turbo intercooled

Mazda MX-5 1.6i 16v

Heb k idd veel over gehoord, I robot was (nogal) losjes gebaseerd op zijn verhalenquote:Op dinsdag 9 oktober 2007 16:53 schreef casejunkie het volgende:

De grootste vraag is die de wetenschappers zich afvragen wat kan en gaat er gebeuren als we inderdaad het voorelkaar krijgen om Artificial intelligence te ontwikkelen?

Dit is nog steeds niet te voorspellen. Maar ga eens een boek lezen van Asimov, erg mooie boeken over dit onderwerp met goede verhalen.

geloof ik, ga k zeker doen!

Over AI:

De vraag daarin is denk ik niet als, maar wanneer... Er zijn ook tal van mensen in wetenschap en

andere gebieden die het samen proberen te ontwikkelen... Iemand die er voor leeft het te ontwikkelen

zal mijns inziens minder stilstaan bij de gevolgen, maar meer bezig zijn met de mogelijkheden...

Hier een stukje over kraaien in t echte leven, welke zich aanpassen aan omstandigheden

(wachten op t stoplicht FTW )

http://smart-machines.blo(...)are-smart-birds.html

Ik heb een paar jaar geleden een heel mooie docu gezien over Artificial Life, waarbij een man een

virtuele vogelzwerm liet vliegen waarbij ze via formules obstakels moesten ontwijken en tegelijkertijd

hun formatie in de zwerm moesten behouden... Na een paar keer hadden ze (de vogels, en

dus het programma) de formatie zo aangepast en waren zo op elkaar ingespeeld dat ze feiloos

om en door de opstakels gingen zonder elkaar in de weg te zitten...

Kortom, door echte situalties in simulaties met open en veranderlijke waarden te plaatsen

krijgen ze het voor elkaar het programma te laten leren...

Wanneer is iets bewust? Wordt er van een machine gevraagd zichzelf of een product

te verbeteren? Wordt er gevraagd je te begrijpen? Prioriteiten te stellen? Via functies en

alogaritmen kan enorm veel berekend worden als je waarden invoert die niet van

te voren vast staan maar op de situatie van toepassing zijn... Dit doen mensen in principe

ook, hier een leuk artikel over Adaptive Intelligence als

initiator van Artificial Intelligence...

Is het mogelijk dat een machine het logischerwijs negatief beredeneert / berekent

dat het schade word aangedaan? Schade dient logischerwijs vermeden te worden...

Een waarde hoeft niet zozeer uit een gevoel voort te komen maar kan ook uit

logica ontstaan...

Wat zou er gebeuren als je je ietwat intelligente huisrobot elke avond als je thuis komt

zijn arm afrukt, hem ermee voor z'n kop slaat, lacht, en hem deze zelf laat repareren?

Het doet misschien geen pijn, en het zal er misschien ook geen haat of iets door voelen,

maar zal hij het proberen te voorkomen? en hoe?

Kan een denkwijze die gebaseerd is op logische formules wel omgaan met menselijke

gekte en emoties? Is AI daarin 'trauma-bestendig' of trekt het conclusies? Zal het waarde

gaan hechten aan zijn bestaan, of aan iets of iemand?

En nog een vraagstuk... Kan er in AI een nieuwschierigheid vormen? Wellicht

extreme ideeen krijgen?

Dezelfde vragen in de OP zijn overigens van toepassing als we ons geen zorgen zouden

hoeven maken over AI... Als alles voor ons gedaan zou worden, hoe zou je leven er

dan uitzien? Wat zou je zelf nog leren? Zouden mensen nog wel zonder kunnen?

En waar zou je inkomen vandaan komen als vrijwel alles via robots zou werken?

[ Bericht 0% gewijzigd door B-FliP op 09-10-2007 23:04:33 ]

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

Hier nog een video van ASIMO op CES 07

(zet je trebble wel omlaag is een btje schel)

Hij is ondertussen verbeterd, en kan nu ook wireless via internet

info ophalen...

Hier nog een Commercial

(zet je trebble wel omlaag is een btje schel)

Hij is ondertussen verbeterd, en kan nu ook wireless via internet

info ophalen...

Hier nog een Commercial

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

De ontwikkeling van robots zal sneller gaan zodra er robotbouwende robots komen.

Robots die robots ontwerpen zullen dan een robotevolutie in gang zetten.

De mens moet dan goed oppassen dat ze dan de baas kunnen blijven.

De drie wetten van de robotica gaan dan in werking treden:

1) Een robot mag een mens geen letsel toebrengen, noch, door passief te blijven, een mens letsel laten overkomen.

2) Een robot moet door de mensen gegeven orders gehoorzamen behalve wanneer die orders in strijd zijn met de eerste wet.

3) Een robot moet zichzelf beschermen zolang of voor zover dat niet met de eerste of tweede wet in strijd is.

Robots die robots ontwerpen zullen dan een robotevolutie in gang zetten.

De mens moet dan goed oppassen dat ze dan de baas kunnen blijven.

De drie wetten van de robotica gaan dan in werking treden:

1) Een robot mag een mens geen letsel toebrengen, noch, door passief te blijven, een mens letsel laten overkomen.

2) Een robot moet door de mensen gegeven orders gehoorzamen behalve wanneer die orders in strijd zijn met de eerste wet.

3) Een robot moet zichzelf beschermen zolang of voor zover dat niet met de eerste of tweede wet in strijd is.

heheh, vertel dat ook ff aan de Zuid-Koreanen...quote:Op dinsdag 9 oktober 2007 22:25 schreef Swetsenegger het volgende:

Schonedal heeft ook Asimov gelezen....

De man schreef FICTIE he jongens.

Artikel uit maart 2007 waarin staat dat Zuid-Korea robot-wetten op wil stellen gebaseerd op

of iig geinspireerd door de robot-wetten van SF-schrijver Asimov:

Ethical code for robots in the works

En hier een artikel over de plannen die Zuid-Korea heeft met de robot markt:

South Korea set to build 'robot-land'

Ze zeggen in dit artikel in 2020 een Robot in elk huishouden te willen hebben... En in

dit artikel (2005) zeggen ze de slimste robot in de wereld te hebben welke

kan denken en leren (en welke opvallend veel lijkt op de Honda ASIMO alleen zeggen ze

in het artikel achter te lopen op de bewegingen van ASIMO) ...

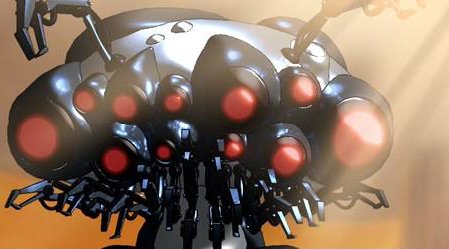

En hier een artikel met video over een militaire toepassing (bij welke die ethische regels

schijnbaar niet zullen gelden) uit 2006, het gaat hier om een sentry robot die zou moeten

waken... (zet bij t afspelen je volume wat zachter)...

SGR-A1

Vraag me af hoe lang t duurt voordat de SGR-A1 met zo'n ASIMO-achtige robot

gecombineerd gaat worden...

[ Bericht 11% gewijzigd door B-FliP op 10-10-2007 00:04:19 ]

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

Relevant nieuws item uit April 2007:

Robot future raises hard questions

In t stuk worden vragen gesteld, situaties geschetst die in een wereld met autonome

robots zeker zullen gaan voorkomen...

Nog ff een paar video fragmenten van robots die k gemist had in mn zoek-acties

welke zeker de moeite waard zijn om te kijken, sommige zijn echt ongelooflijk:

The Takanishi WE-4RII Humanoid Robot (zie k t nou goed en zijn zelfs longen gemaakt?)

Hanson Robot: Jules

Jules says goodbye before being turned of and shipped to England

Hanson Robot: Joey

Domo Indrukwekkend stukje video, zie hoe t mechanisch werkt en

zie op t laatst de code op de schermen voorbij schieten...

Domo robot Reaching to a Target

RDaneel

BabyRobot, learns movement like a human, from observing other humans

Robot show in Japan (Duits gesproken maar zeer indrukwekkend)

Japanse ontwikkelaar heeft een kopie van zichzelf gemaakt

[ Bericht 1% gewijzigd door B-FliP op 11-10-2007 14:59:39 ]

Robot future raises hard questions

In t stuk worden vragen gesteld, situaties geschetst die in een wereld met autonome

robots zeker zullen gaan voorkomen...

Nog ff een paar video fragmenten van robots die k gemist had in mn zoek-acties

welke zeker de moeite waard zijn om te kijken, sommige zijn echt ongelooflijk:

The Takanishi WE-4RII Humanoid Robot (zie k t nou goed en zijn zelfs longen gemaakt?)

Hanson Robot: Jules

Jules says goodbye before being turned of and shipped to England

Hanson Robot: Joey

Domo Indrukwekkend stukje video, zie hoe t mechanisch werkt en

zie op t laatst de code op de schermen voorbij schieten...

Domo robot Reaching to a Target

RDaneel

BabyRobot, learns movement like a human, from observing other humans

Robot show in Japan (Duits gesproken maar zeer indrukwekkend)

Japanse ontwikkelaar heeft een kopie van zichzelf gemaakt

[ Bericht 1% gewijzigd door B-FliP op 11-10-2007 14:59:39 ]

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

Misschien is dit een interessant topic voor je;quote:Op woensdag 10 oktober 2007 15:07 schreef B-FliP het volgende:

Relevant nieuws item uit April 2007:

~ Singularity

It is important to distinguish between a stupid person and a shit head. A stupid person simply can't process the information , a shit head is intelligent but his mind is full of garbage.

Vet filmpje:

Albert Einsteins hoofd met ontzettend veel gezichtsuitdrukkingen, spraak en zichtveld/coordinatie

op een ASIMO achtig robot lijf...

RoboRama

Het volgende filmpje is NIET ECHT, maar een impressie van een robotsoldaat in

de nabije toekomst...

Robot Soldier (beter kwaliteit filmpje dan een aantal minuten geleden )

[ Bericht 22% gewijzigd door B-FliP op 11-10-2007 13:16:48 ]

Albert Einsteins hoofd met ontzettend veel gezichtsuitdrukkingen, spraak en zichtveld/coordinatie

op een ASIMO achtig robot lijf...

RoboRama

Het volgende filmpje is NIET ECHT, maar een impressie van een robotsoldaat in

de nabije toekomst...

Robot Soldier (beter kwaliteit filmpje dan een aantal minuten geleden )

[ Bericht 22% gewijzigd door B-FliP op 11-10-2007 13:16:48 ]

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

Dit is wel echt het tijdperk waarin je binnekort miljoenen miljarden kunt verdienen met A.I. Binnen enkele jaren speeld dit zo`n enorme rol. Tevens tvp.

I remember little things you hardly ever do

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

ik hoop iig dat we als het zover komt slim genoeg te zijn robots niet, zoals God ons, naar ons evenbeeld te scheppen, want dat gaat de planeet niet overleven..

ook ben ik benieuwd of er een tijd komt waarin AI zn A verliest..

ook ben ik benieuwd of er een tijd komt waarin AI zn A verliest..

Ik denk niet dat die weggaat, want het blijft natuurlijkl altijd kunstmatig.quote:Op donderdag 11 oktober 2007 19:25 schreef Yorrit het volgende:

ik hoop iig dat we als het zover komt slim genoeg te zijn robots niet, zoals God ons, naar ons evenbeeld te scheppen, want dat gaat de planeet niet overleven..

ook ben ik benieuwd of er een tijd komt waarin AI zn A verliest..

I remember little things you hardly ever do

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

Ik denk dat mensen heb erin houden, omdat 'kunstmatig' aangeeft dat het toch niet 'echt' is. Als die intelligentie eenzelfde 'niveau' bereikt als het menselijke (of bepaalde dieren misschien) moeten ze misschien wel gezien worden als individuen met rechten. 'kunstmatig' geeft het toch een bepaalde lading die het lager stelt als 'echt' bewustzijn..quote:Op donderdag 11 oktober 2007 19:43 schreef The_Forcer het volgende:

[..]

Ik denk niet dat die weggaat, want het blijft natuurlijkl altijd kunstmatig.

Uh, kunstmatig geeft niet aan dat het niet 'echt' is, maar dat het kunstmatig gecreeerd is, dat heeft niets te maken met echt of onecht.quote:Op donderdag 11 oktober 2007 19:52 schreef Yorrit het volgende:

[..]

Ik denk dat mensen heb erin houden, omdat 'kunstmatig' aangeeft dat het toch niet 'echt' is. Als die intelligentie eenzelfde 'niveau' bereikt als het menselijke (of bepaalde dieren misschien) moeten ze misschien wel gezien worden als individuen met rechten. 'kunstmatig' geeft het toch een bepaalde lading die het lager stelt als 'echt' bewustzijn..

I remember little things you hardly ever do

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

Tell me why, I don't know why it's over

I remember shooting stars, the walk we took that night

I hope your wish came true, mine betrayed me

ik zie niet waarom kunstmatig automatisch staat tot lager dan 'echt'. Sterker nog ik zie niet hoe kunstmatig relevant met echt moet zijn.quote:Op donderdag 11 oktober 2007 19:52 schreef Yorrit het volgende:

[..]

Ik denk dat mensen heb erin houden, omdat 'kunstmatig' aangeeft dat het toch niet 'echt' is. Als die intelligentie eenzelfde 'niveau' bereikt als het menselijke (of bepaalde dieren misschien) moeten ze misschien wel gezien worden als individuen met rechten. 'kunstmatig' geeft het toch een bepaalde lading die het lager stelt als 'echt' bewustzijn..

Pcies... To an artificial mind, all reality is virtual...quote:Op donderdag 11 oktober 2007 22:41 schreef koffiegast het volgende:

ik zie niet waarom kunstmatig automatisch staat tot lager dan 'echt'. Sterker nog ik zie niet hoe kunstmatig relevant met echt moet zijn.

What you pay attention to, you become conscious of...

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

B-FliP Youtube Channel

Bionic - In on the Outside EP: 2-3-2012

wat bedoel je hiermee?quote:Op vrijdag 12 oktober 2007 13:18 schreef B-FliP het volgende:

[..]

Pcies... To an artificial mind, all reality is virtual...

kan een 'kunstmatige' intelligentie niet denken dat was hij denkt/waarneemt 'de echte' realiteit is

Eigenlijk moet je onderscheid maken tussen mechanische dingen als lopen, handen, 'echte' gezichten, etc en informatieverwerking als intelligentie, 'zien', 'praten', etc.

De eerste zijn leuk maar maken de robot niet meer menselijk dan bijvoorbeeld een auto.

De laatste zijn wel interressant want daarmee zouden ze werkelijk de mens kunnengaan domineren.

En mechanische dingen zijn daar niet voor noodzakelijk.

De eerste zijn leuk maar maken de robot niet meer menselijk dan bijvoorbeeld een auto.

De laatste zijn wel interressant want daarmee zouden ze werkelijk de mens kunnengaan domineren.

En mechanische dingen zijn daar niet voor noodzakelijk.

2147483647 angels can dance on the point of a needle.

Add one and they will all turn into devils.

Add one and they will all turn into devils.

En ze zijn nu net zo druk bezig met robots lief te maken.quote:Op vrijdag 12 oktober 2007 14:04 schreef Harajuku. het volgende:

Ik vind robots eng en wil ze niet. .

2147483647 angels can dance on the point of a needle.

Add one and they will all turn into devils.

Add one and they will all turn into devils.